简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

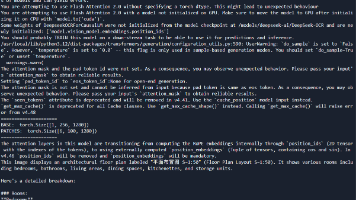

Cubesandbox是腾讯开源的代码沙箱运行时,兼容E2B的REST API,基于KVM MicroVM提供安全隔离的执行环境。本文介绍了在AL2023系统上的部署过程,包括环境准备、依赖安装和问题排查。安装过程中发现network-agent服务启动时序问题导致cubelet初始化失败,需调整服务启动顺序或超时配置。整体架构包含API链和数据链两条关键路径,适用于LLM Agent安全执行用户

Airflow 3.2.1 + AgentOperator 技术环境摘要 本文构建了一个基于Airflow 3.2.1的智能工作流编排系统,集成了AgentOperator、多种工具集(SQL/Hook/MCP)、MinIO对象存储和LiteLLM大语言模型代理。系统采用微服务架构,核心组件包括API Server、DAG Processor、Scheduler、Worker和Triggerer,

OpenSearch Observability Stack 是基于 OpenSearch 的一站式可观测性平台,支持 OTLP 协议和 OTel 规范,具备 AI Agent 追踪能力。其架构分为五层:应用层(埋点生成数据)、接收层(OTel Collector 处理)、处理层(Data Prepper 路由)、存储层(OpenSearch/Cortex 持久化)和展示层(Dashboards

摘要: OCR技术经历了从传统字符识别到多模态理解的演进。传统OCR(1.0)依赖CNN+LSTM结构,仅能提取文本,而现代OCR 2.0(如DeepSeek-OCR、Qwen-VL)结合视觉Transformer和多模态对齐技术,可解析文档结构(表格、公式)并生成Markdown/JSON。DeepSeek-OCR创新性采用"上下文光学压缩"和端到端框架,平衡效率与精度,支持

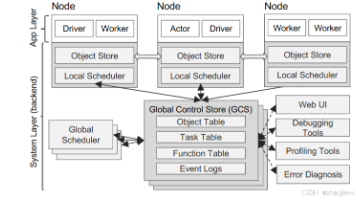

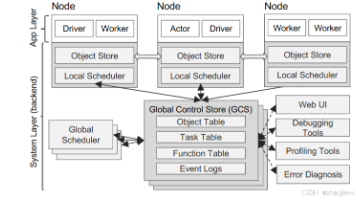

Ray 是一个分布式 Python 框架,核心抽象包括无状态 Task 和有状态 Actor。集群架构分为控制平面(GCS、Raylet、Dashboard 等)和数据平面(Driver、Worker)。资源调度通过声明式方式管理,支持 placement group 实现多卡协同。启动过程依次拉起 GCS、Object Store、Raylet 等组件,并自动配置监控系统。Dashboard 提

Ray 是一个分布式 Python 框架,核心抽象包括无状态 Task 和有状态 Actor。集群架构分为控制平面(GCS、Raylet、Dashboard 等)和数据平面(Driver、Worker)。资源调度通过声明式方式管理,支持 placement group 实现多卡协同。启动过程依次拉起 GCS、Object Store、Raylet 等组件,并自动配置监控系统。Dashboard 提

本文介绍了数据质量管理的关键概念和工具链,重点讲解了OpenMetadata与Great Expectations的集成方案。主要内容包括: 数据质量管理的基本方法:定义规则、自动检查和记录结果 OpenMetadata作为数据目录平台的功能定位,与Hive Metastore的协同关系 Great Expectations框架的核心概念和使用场景 系统集成架构和工作流程,包括数据库迁移、数据模型

本文详细介绍了构建端到端CDC数据管道的完整流程,涵盖PostgreSQL变更捕获、Kafka消息传输、Flink流处理及Paimon数据湖存储等关键环节。重点解析了CDC技术原理,包括基于日志的变更捕获方式、PostgreSQL逻辑复制机制(WAL、复制槽、pgoutput插件)以及Debezium的工作流程。同时对比了Kafka传统模式与KRaft模式的架构差异,并提供了单节点KRaft配置示

本文介绍了LinkedIn开源的数据治理平台DataHub的架构设计与部署实践。DataHub作为第三代数据目录平台,采用流式架构实现实时元数据管理,支持与AWS Glue和dbt等工具集成构建完整的数据血缘图谱。文章详细解析了DataHub的核心组件(GMS服务、Kafka消息总线、MySQL存储、OpenSearch索引)及其协同工作原理,并提供了基于Docker的部署指南和Glue元数据导入

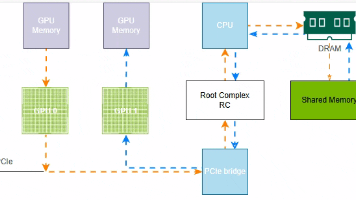

NVIDIA GPUDirect技术体系旨在优化GPU间数据传输效率,分为节点内和跨节点通信两类。节点内技术包括:1)共享内存方案(需CPU中转,兼容性好但性能低);2)P2P直连(通过PCIe直接传输,减少拷贝次数);3)GPUDirect Storage(实现GPU与存储设备的直接数据交换);4)NVLink/NVSwitch(提供超高带宽互联,最新第五代NVLink达1.8TB/s)。其中N