简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

决策树(decision tree)是一类常见的机器学习方法,是一种基于树结构的监督学习算法,广泛应用于分类和回归任务中。

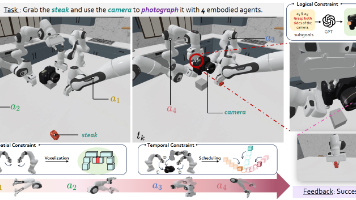

这篇文章提出了一种创新的框架,旨在通过引入组合约束来解决多智能体系统中的协作问题,并自动生成安全、高效的训练数据。文章的核心贡献在于设计了一种能够有效管理多智能体协作的框架——RoboFactory,该框架通过逻辑、空间和时间三个维度的约束,确保智能体在执行任务时的行为既安全又高效。RoboFactory框架包含两个核心模块:RoboBrain和RoboChecker。RoboBrain负责根据全

《机器学习》,又称西瓜书,是南京大学教授周志华教授编著的一本机器学习领域的经典教材。在接下来的日子里,我将每周精心打磨一章内容,全方位、多角度地为大家剖析书中精髓。

LLaVA,这个大型语言和视觉助手,以其卓越的多模态能力在人工智能领域脱颖而出。它不仅集成了视觉编码器和语言模型,还通过端到端训练的方式,实现了对视觉和语言信息的深度融合与理解,这在多模态交互领域是一个巨大的飞跃。LLaVA的核心优势在于其能够处理和理解复杂的视觉和语言数据,提供更为精准和丰富的信息处理能力。它的设计允许模型在保持高性能的同时,对高分辨率图像进行有效处理,这一点在LLaVA-1.5

这篇文章提出了一种基于离散扩散模型(DMs)的新型视觉语言模型(VLM),LaViDa,旨在解决现有自回归(AR)VLMs在推理速度和可控生成方面的局限性。文章详细介绍了LaViDa的设计、训练和推理过程,并通过一系列实验验证了其在多模态任务中的性能和优势。

Qwen2.5-VL,这是一个最先进的视觉语言模型系列,在多模态理解和交互方面取得了重大进展。Qwen2.5-VL增强了视觉识别、对象定位、文档解析和长视频理解能力,在静态和动态任务中都表现出色。其原生的动态分辨率处理和绝对时间编码能够稳健地处理各种输入,而Window Attention在不牺牲分辨率保真度的情况下降低了计算开销。Qwen2.5-VL迎合了从边缘AI到高性能计算的广泛应用。

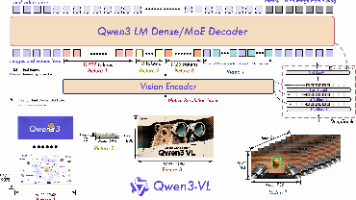

Qwen3-VL是阿里巴巴开发的新一代视觉语言模型,支持256K tokens的交错上下文处理,包含稠密型和混合专家型变体。其核心优势包括强大的文本理解能力、稳健的长上下文处理以及先进的多模态推理能力。模型通过增强型交错MRoPE、DeepStack集成和文本基视频时间对齐三大升级优化时空建模。训练采用四阶段预训练和SFT、知识蒸馏、RL后训练流程,在多模态任务中表现卓越。评估显示Qwen3-VL

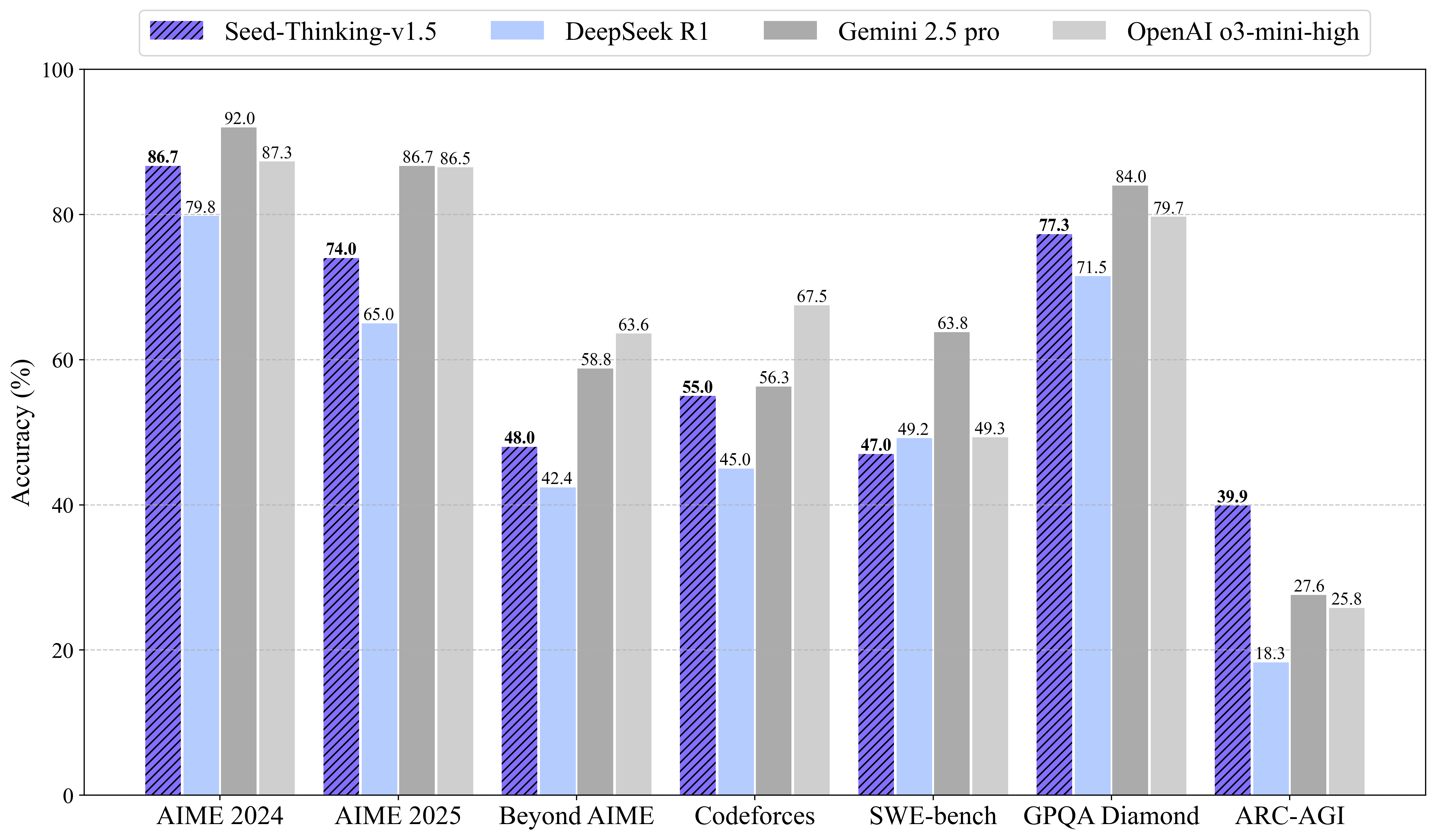

字节跳动旗下的豆包团队正式发布了其最新的推理模型——Seed-Thinking-v1.5,该模型在多个方面展现出了明显的技术优势。这一进展不仅推动了推理模型的发展,还引发了同行业内的高度关注,标志着AI技术在通用推理能力上的一个重要里程碑。

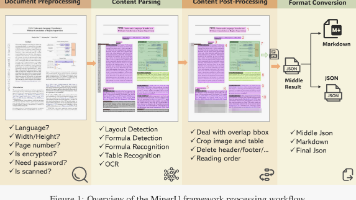

MinerU是一款由OpenDataLab开源的多模态文档智能解析工具链,旨在将PDF等非结构化文档转化为机器可读的结构化数据。MinerU支持多种输出格式(Markdown/LaTeX/HTML/JSON),可处理复杂版式文档,并针对重叠元素设计了智能后处理算法。该工具填补了开源社区在高精度文档理解基础设施方面的空白,为构建高质量大模型语料库提供了工业级解决方案。

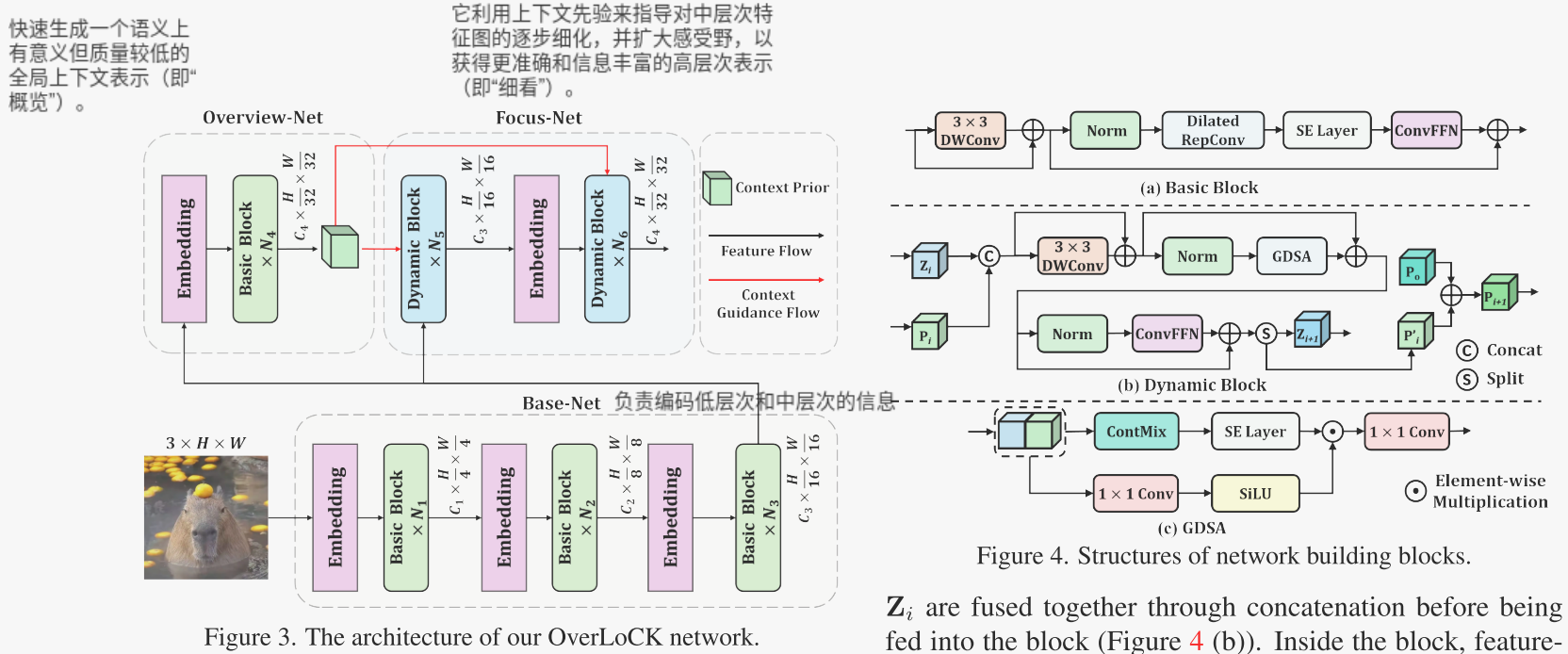

作者提出了一种深度阶段分解策略(Deep-stage Decomposition Strategy, DDS),该策略受人类视觉系统“先概览后细看”(Overview-first-Look-Closely-next)机制的启发,将卷积网络(ConvNet)分解为三个协同工作的子网络:Base-Net(基础网络)、Overview-Net(概览网络)和Focus-Net(聚焦网络)。这种设计旨在通过