简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

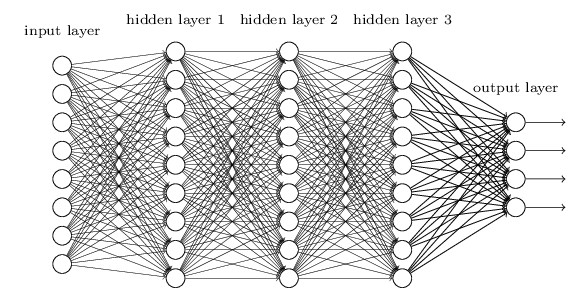

一、什么是梯度消失和梯度爆炸1. 梯度消失(gradient vanishing problem)我们知道神经网络在进行反向传播(BP)的时候会对参数W进行更新,梯度消失就是靠后面网络层(如layer3)能够正常的得到一个合理的偏导数,但是靠近输入层的网络层,计算的到的偏导数近乎零,W几乎无法得到更新。2. 梯度爆炸(gradient exploding problem)梯度爆炸的意思是,靠近输入

一、关于PEP 249PEP的全称是Python Enhancement Proposals,其中Enhancement是增强改进的意思,Proposals则可译为提案或建议书,所以合起来,比较常见的翻译是Python增强提案或Python改进建议书。在数据库这方面python有PEP 249 -- Python Database API Specification v2.0,...

HMM, MEMM, CRF

EM算法可以说是一个非常经典的算法,至今仍在广泛地被使用(如强化学习领域)EM算法要解决的问题EM 算法(全称为Expectation-Maximization algorithm)是一种对含有隐变量的问题的极大似然估计算法。参数估计方法可以参考 抽样分布和参数估计(极大似然估计)。准确来说,...

3. 什么是主成分分析?(Principle Component Analysis,PCA)设数据X=(x1,x2,..xn)X=(x_1,x_2,..x_n)X=(x1,x2,..xn)具有n个属性(还有很多其他命名,比如分量,指标),属性值分别是x1,x2,..xnx_1,x_2,..x_nx1,x2,..xn那么主成分分析就是把原来具有相关关系的多个指标(属性)简化为少数几个新的

一、简介基于skleran的决策树使用很简单,只要是使用DecisionTreeClassifier类即可进一步,我们希望将该树可视化出来,这是需要用到sklearn中tree.export_graphviz函数和graphviz模块.Graphviz是一个开源的图形可视化软件。图可视化是将结构信息表示为抽象图和网络图的一种方法。它在网络、生物信息学、软件工程、...

一、简介对于自己实现的决策树,我们可以使用matplotlib将其可视化,见下。其中create_plot可以生成最终的图,其中Tree是树结构,如果你的决策树直接用字典类型存储的化,可以适当修改其中的代码,大概的思路是不变的。retrieve_tree()函数是手工生成两棵树,以便测试查看。二、实现#%%import matplotlib.pypl...

一、模型定义keras中模型定义十分简便,主要通过add函数来添加layers,而这些layers包含比如卷积层Conv2D、池化层Pool,全连接层Dense, 激活函数层Activation等。下面是一个浅卷积网络的例子:from keras.models import Sequentialfrom keras.layers.convolutional import Co...

一、决策树(Decision Tree)介绍什么是决策树,其实字面意思挺简单的,就是通过样本的各个维度的数据来判断该样本的类别,比如下面这个就是决策树。图片来自周志华老师的西瓜书,这里的决策树通过西瓜的各个属性来判别是好瓜还是坏瓜。现在的任务就是构建这样一棵决策树:(一)应该先以哪个属性做判别?(找到令数据集区分的更好的属性)...