简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

我们已经详细探讨了如何赋予大模型“记忆(Memory)”和“手脚(Tool Use)”。然而,单纯的 Agent 依然面临一个致命缺陷:大模型的知识仅限于其训练数据,它不知道企业内部的私有规章制度、文档或最新的技术方案,这就会导致严重的“幻觉”。为了解决这个问题,ai-agent-rag 项目在 ai-agent-chat 的基础能力(记忆+触手)之上,引入了 RAG(检索增强生成) 技术。

我们已经详细探讨了如何赋予大模型“记忆(Memory)”和“手脚(Tool Use)”。然而,单纯的 Agent 依然面临一个致命缺陷:大模型的知识仅限于其训练数据,它不知道企业内部的私有规章制度、文档或最新的技术方案,这就会导致严重的“幻觉”。为了解决这个问题,ai-agent-rag 项目在 ai-agent-chat 的基础能力(记忆+触手)之上,引入了 RAG(检索增强生成) 技术。

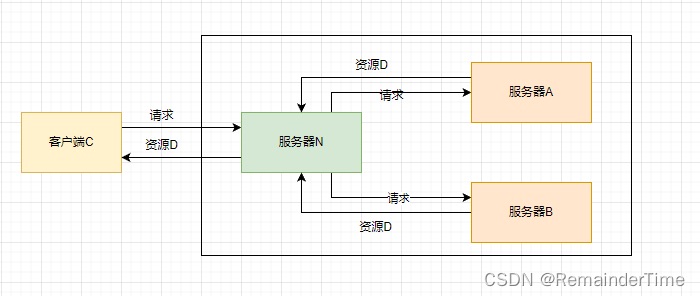

本文探讨了Nginx反向代理与SpringCloud Gateway在微服务架构中的差异化定位与应用场景。Nginx作为网络层网关,擅长静态资源分发和基础反向代理,但缺乏动态服务发现、鉴权限流等微服务特性支持;而SpringCloud Gateway专为微服务设计,具备动态路由、统一鉴权、灰度发布等应用层能力。文章指出,在微服务项目中错误地将Nginx作为单一网关会带来配置僵化、功能缺失等问题,建

Nginx[engine x]是一个免费开源Web服务器,是一个HTTP和反向代理服务器,邮件代理服务器, 和一个通用的 TCP/UDP 代理服务器,最初由俄罗斯软件工程师Igor Sysoev撰写。nginx专注于高性能、高并发性和低内存使用率。能够在高并发下给网站提供稳定的服务。

题外话博主使用ssh工具是electerm,一款开源免费的工具,个人感觉比xshell好用,感兴趣的童鞋可以下载试试,下载地址https//electerm.html5beta.com/在点击构建前,特别注意docker构建命令的映射端口是否和自己项目的端口一致,如果并不一致需要手动修改jenkinsfile文件。介于时间和文章篇幅的原因,到此本博文就暂时结束了,其中存在不足和疑惑的地方,欢迎大家

前言承接上一篇 Springboot 整合 阿里云消息队列RabbitMQ版服务,本篇实现对于 RocketMq版消息队列服务,至于为什么不继续使用阿里云服务,懂的都懂,rocketMq版消息队列在阿里云需要付费购买,而腾讯云 rocketMq版消息队列完全免费(看过上一篇自然明白),这次我想说腾讯云真香。准备工作首先的先注册腾讯云账户,并进入首页->搜索->并选择点击。2. 点击立即

作为一个开发者,学无止境是我们的座右铭,前面学习了docker相关基础操作,现在来学习kubernetes的相关基础操作。测试同事说这是要抢运维的饭碗呀,其实不然,了解学习当前行业热门或者前沿的技术无可厚非,更何况我们后端开发人员,更多的技术储备在这内卷严重的行业更是必不可少的。可参考博主另一篇文章进行安装docker:安装docker环境Kubectl使用Kubernetes API与集群进行交

在 AI 应用爆发的今天,市面上充斥着各种 Agent 工具。但作为技术人,我们不仅要会“用”,更要懂“如何集成到业务”。`ai-agent-chat` 项目正是为了带你从浅入深理解市面上 Agent 能力的底层原理。本文将基于实战,拆解一个具备“**大脑(LLM)**、**手脚(Tool Use / Function Calling)**、**记忆(Memory)**、**规划(Planning

在 AI 应用爆发的今天,市面上充斥着各种 Agent 工具。但作为技术人,我们不仅要会“用”,更要懂“如何集成到业务”。`ai-agent-chat` 项目正是为了带你从浅入深理解市面上 Agent 能力的底层原理。本文将基于实战,拆解一个具备“**大脑(LLM)**、**手脚(Tool Use / Function Calling)**、**记忆(Memory)**、**规划(Planning

本文介绍了在微服务架构下使用SpringDoc实现接口文档统一管理的方案。通过在网关服务配置多文档地址路由、放行访问路径,并在业务服务中引入公共文档配置类,实现了分散接口的集中展示。方案基于SpringBoot 3.3.5、SpringCloud 2023.0.1和JDK17,支持全局Token认证配置,最终可通过网关统一地址访问所有服务的Swagger文档界面,解决了微服务接口分散管理的问题。