简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Scalable Multi-Hop Relational Reasoning for Knowledge-Aware Question Answering将外部知识融入模型进行推理学习,在CommonsenseQA数据集中取得SOTA的效果。采用的外部知识为conceptNet代码分为5步:下载相关数据集对数据集进行预处理超参数搜索(可选)训练评估本部分主要讲解第2部分----数据集预处理 。上

语言模型语言模型计算一串句子的概率传统的语言模型:通常我们会以一个突破点为基础条件在尝试预测一个词之前 我们会尝试仅仅根据它前面的n个词语预测下一个词 这是使用传统的机器学习模型必要的 但却是错误的但是占用的内存较大 效率不好解决办法:RNN 从理论层面上来讲 我们可以根据所有前序字组来进行预测 如此一来 内存需求只会取决于字词的数量规模而不受我们想依据的序列长度的影响RNN语言模型主要思想:我们

全连接前馈神经网络缺点:参数太多、很难提取局部不变特征卷积神经网络如何实现局部连接和权重共享? 卷积 其中W_i称为滤波器或者卷积核举例:卷积扩展:是因为卷积的维度不够灵活 每次只能卷m-k+1维的数据( m为向量的总维数 k是滤波器的个数 ) 因此引入滑动步长S 零填充P 滑动步长为每隔s次个计算一下卷积 P如果想计算第一个的卷积在第一个卷积前进行填充足够k-1个零两维卷积卷积作为特征提取器 高

典型的卷积神经网络LeNet-5AlexNetInception网络Inception网络在卷积网络中,如何设置卷积层的卷积核大小是十分关键的问题 Inception网络尝试多种不同的卷积核 最后给堆叠起来使用多层的小卷积核来代替大的卷积核,以减少计算量和参数量残差网络 当时先用一个f(x)来拟合h(x) 但是发现恒等函数拟合效果不好 因此将目标函数拆分为两给部分 恒等函数和残差函数残差单元Ngr

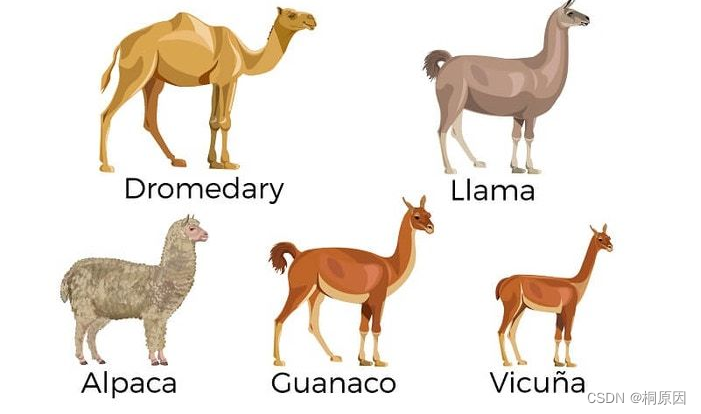

自从ChatGPT出世以来,各个大厂/研究院都纷纷推出自己的大模型,大模型领域发展一日千里。随着“百模大战”热度的降低,有必要梳理一下目前主流的大模型以及其变种模型,回顾一下。注:汇总开源模型。

深度学习训练流程是一套固定的模板optimizer定义,选择不同的optimizer,权重衰减,梯度更新。scheduler定义,选择不同的scheduler,进行学习率的更新。(可选,可不使用scheduler进行学习率更新,设为None,则学习率为恒定值)model初始化,选择使用GPU训练还是CPU训练loss选择优化函数,for epoch in range(epochs):# 训练几个e

但是,PaddlePaddle安装问题一直都困扰着我,什么````C++```报错了、什么不能使用多卡了,不同Linux环境安装后报错也各不相同。怎么样,才能让Paddle安装像torch那么丝滑,开箱即用,而不是陷入各种报错当中,在不断摸索的过程中,也渐渐看到了方向。某一天,在PaddleNLP文档上查看资料,看到PaddleCloud开源了基于Paddle的镜像,可开箱即用。出现了上面的结果,

需要重装nvidia驱动,因此需要卸载之前的版本。方法:查看安装的nvidia模块命令rpm -qa|grep -i nvid|sort删除相关模块yumremove kmod-nvidia-*在卸除驱动后一定记得重启sudo reboot

torch版本1.6