简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

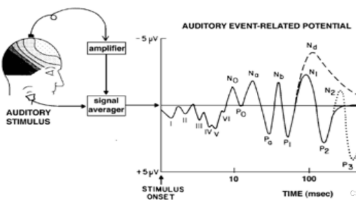

本文是基于《人工智能与脑认知》课程的复习纲要,主要涵盖人工智能、认知科学、脑电特征和事件相关电位等内容。课程介绍了智能的定义、认知过程、脑结构功能及ERP技术应用,包括视觉/听觉成分分析、实验范式(如Oddball、Go-Nogo范式)和脑机接口基础。重点阐述了P300、MMN等ERP成分的神经机制及其在认知研究中的意义,为脑机接口研究提供理论基础。课程强调跨学科整合,涉及心理学、神经科学和计算机

系统阐述了自然语言语义计算的理论体系与技术方法,围绕语义理解的核心任务,深入探讨了格语法、语义网络和概念依存三大理论模型,分别从语义角色、概念关系和动作基元的角度解析语言含义。在应用层面,详细分析了词义消歧、指代消解和语义角色标注等关键技术,特别关注了汉语特有的零指代和流水句等处理难点。通过整合经典理论(如真理条件语义学)与现代技术(如深度学习),构建了从词汇到篇章的多层次语义分析框架,为自然语言

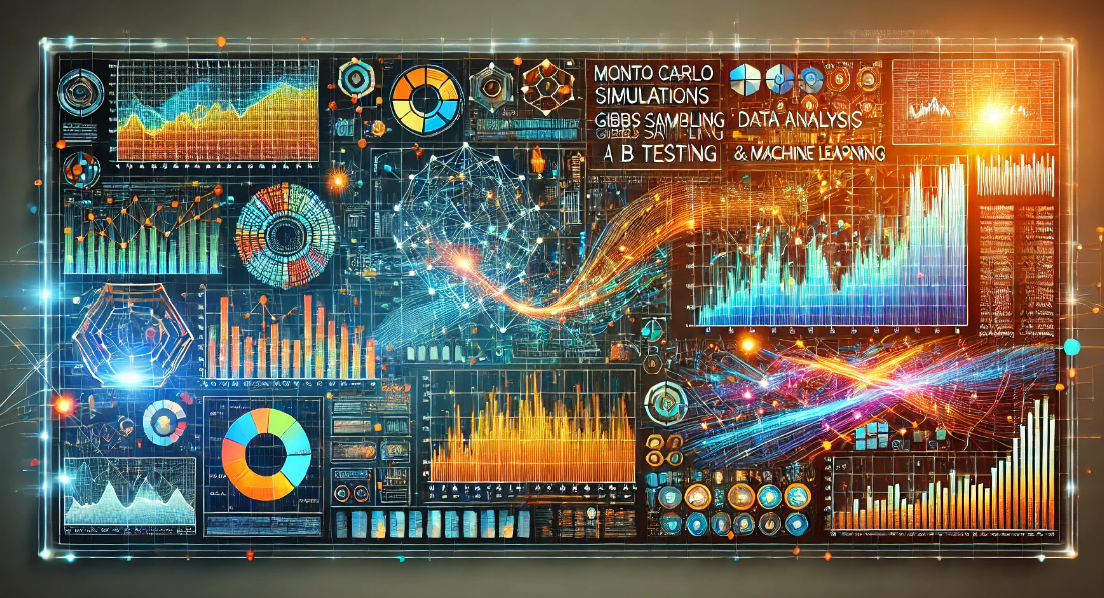

主要是数据分析岗位的一些面经,包括GMV、A/B测试、辛普森悖论、蒙特卡洛模拟、吉布斯采样,以及相关部分的一些具有实际意义的python代码。

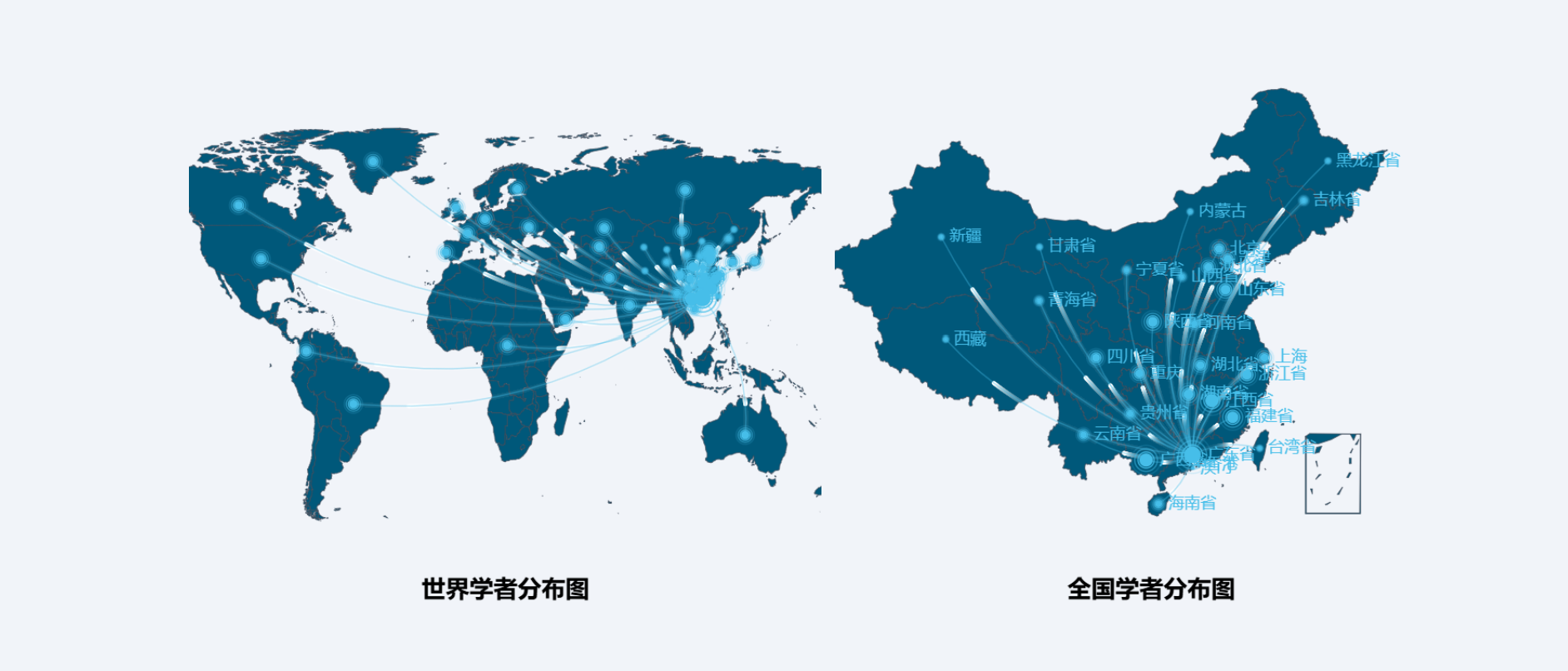

本文着重打造了一个解释性高的学者推荐系统--CCSCW全国计算机支持的协同工作学术会议2024协同智能大数据赛题

《智能控制(第四版)-刘金琨》课本例题和课后上机实验代码汇总(部分)

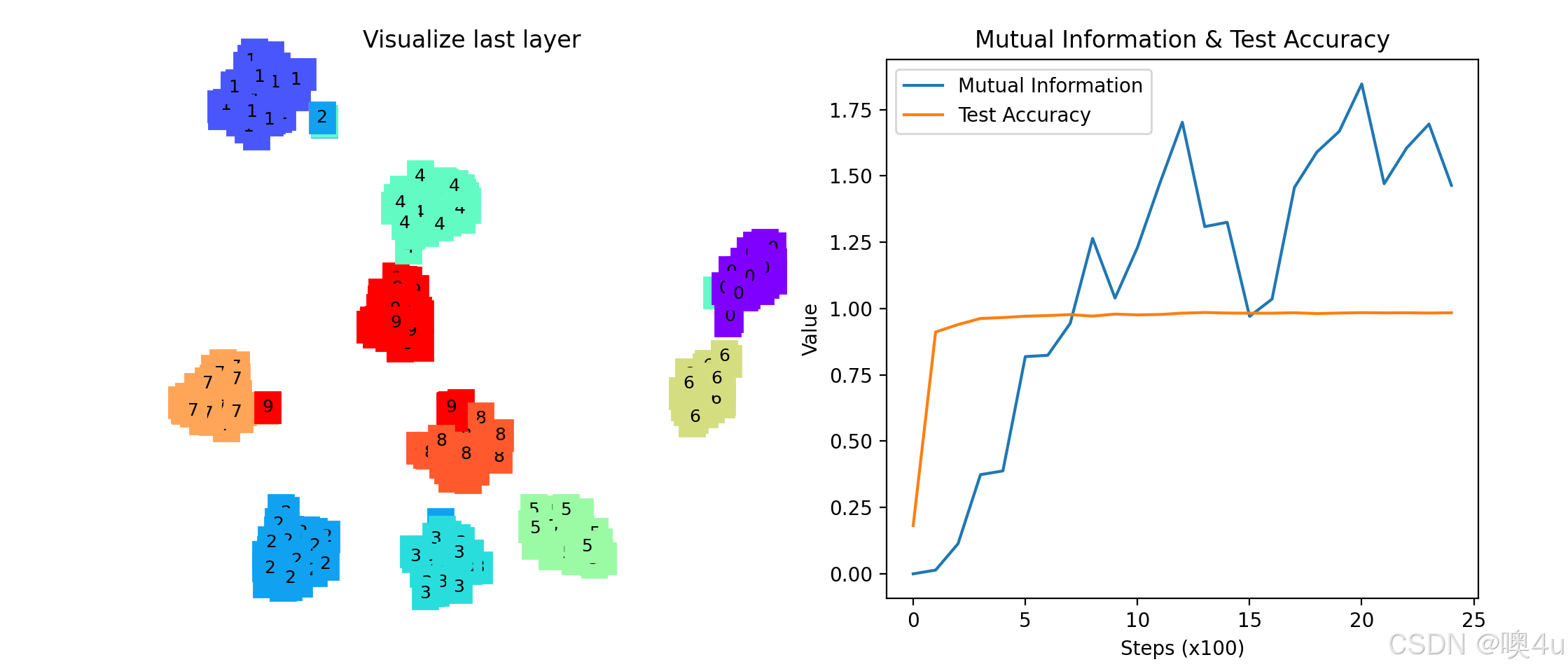

本文综述了信息论在深度学习中的关键应用,重点探讨了信息瓶颈理论、互信息估计和编码率减少原则三大方向。在信息瓶颈理论方面,研究表明深度网络训练呈现"拟合-压缩"两阶段动态,非线性激活函数能促进信息压缩以提升泛化能力,变分信息瓶颈(DVIB)框架可有效提高模型可解释性。互信息神经估计(MINE)方法通过Donsker-Varadhan表示实现了高维数据中的高效互信息估计。最大编码率

聚焦于pytorch框架下的cnn(含mnist识别手写数字集)、rnn和lstm、解码器编码器、自编码器模型(对MNIST数据集图像的降维和重建)。

深入解析:基础概念,动态规划、Q-learning、SARSA、DQN、ac、PD算法,Boltzmann、ϵ-greedy策略,优先级回放技术

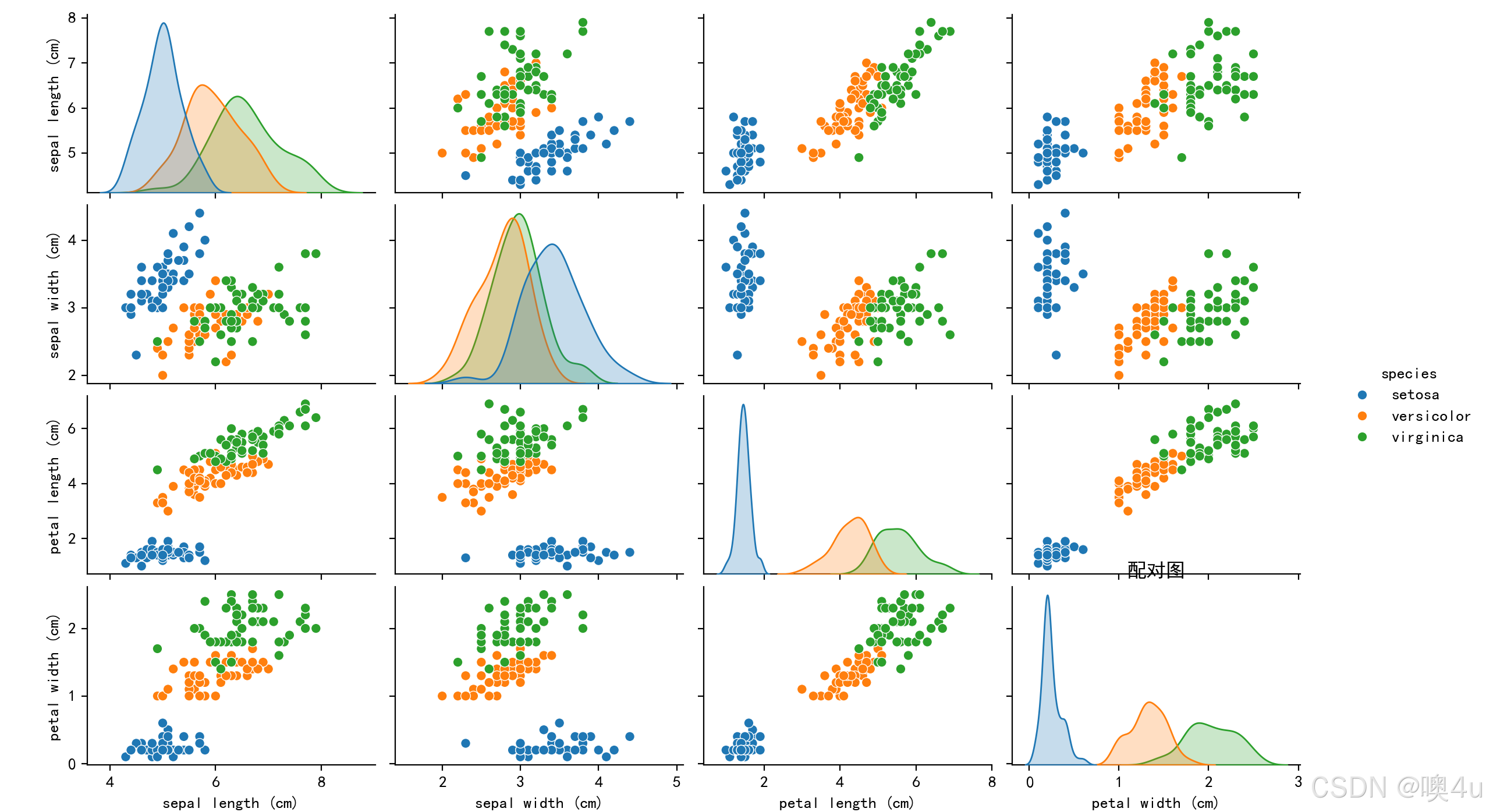

本文介绍了多种数据可视化方法,使用经典数据集如iris或伪数据为例,绘制了以下图表:核密度图、箱线图、小提琴图、气泡图、蜂群图、三维散点图、折线图、雷达图、散点图回归线、条形分布图、堆叠条形图、饼图、配对图、热力图、极坐标图、分面图、区域图、平行坐标图、漏斗图、瀑布图、树状图、甘特图、桑基图、旭日图、蜡烛图、地图,以及文字形式的词云图、网络图等。此外,还介绍了tensorboard的使用以及展示了

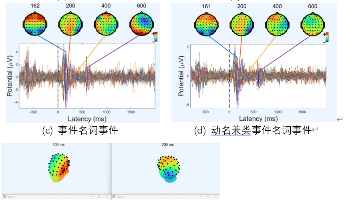

本实验利用EEGLAB分析视觉词性判断任务中的脑电数据,探讨名词、动词、事件名词及动名兼类事件名词在语义加工中的神经差异。实验通过滤波、重参考、ICA等预处理步骤,提取ERP成分及时频特征(ERSP、ITC)。结果显示,不同ERP成分在关键通道(Cz、F3、TP7)上的脑电特征存在显著差异,验证了词性判断过程中的多通道协同机制。实验揭示了词汇加工的时空动态,为视觉刺激任务的神经电生理反馈提供了证据