简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大模型处理文本的核心流程分为三个阶段:1)输入处理,将文本分词、嵌入为向量并添加位置编码;2)模型计算,通过多层Transformer结构进行上下文理解和推理;3)输出生成,将概率分布转换为文本并循环生成完整内容。整个过程实现了"文本→数字→计算→数字→文本"的转换,结合符号处理和神经网络计算,使模型能够理解和生成人类语言。

预训练模型是深度学习中的关键技术,通过在大规模数据上预先学习通用特征,再迁移到具体任务中进行微调。其核心原理包括特征迁移和自监督学习,典型架构如Transformer和卷积神经网络。与用户自训练模型、传统机器学习模型及无预训练深度模型相比,预训练模型在数据需求、训练成本、特征通用性和任务扩展性等方面具有显著优势。然而,它也存在领域偏差、计算成本高和可解释性差等局限性。预训练模型广泛应用于自然语言处

LLM Guard敏感词过滤系统实现分析 Ban Substrings Scanner采用两种匹配方式: STR模式:简单字符串包含检查 WORD模式:正则表达式单词边界匹配 支持大小写敏感配置和敏感词替换功能 Ban Topics Scanner基于零样本分类技术: 使用预训练Transformer模型(如RoBERTa)进行主题分类 通过概率分数与人工设定阈值比较判断敏感内容 支持替换为中文模

LLM Guard敏感词过滤系统实现分析 Ban Substrings Scanner采用两种匹配方式: STR模式:简单字符串包含检查 WORD模式:正则表达式单词边界匹配 支持大小写敏感配置和敏感词替换功能 Ban Topics Scanner基于零样本分类技术: 使用预训练Transformer模型(如RoBERTa)进行主题分类 通过概率分数与人工设定阈值比较判断敏感内容 支持替换为中文模

第一句是关于春节,中国家庭做饺子,长辈讲关于年兽的故事。这里要注意“make dumplings”翻译成“包饺子”比较合适,而“Nian”是年兽,应该音译为“年兽”或者“年兽”,但通常用“年兽”更常见。model="/home/xugq/qwen3-1.7b/",# 使用模型路径,如通过--served-model-name指定名称需与 vLLM 服务启动时指定的名称一致。:指定使用的推理解析器,

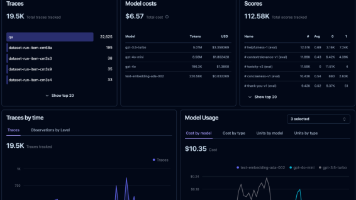

Langfuse是一个开源的LLM工程平台,旨在帮助团队协作调试、分析和优化LLM应用程序。它支持任何模型和框架,提供嵌套跟踪功能,能有效定位问题根源。平台特点包括完全开源、生产级优化、多语言SDK支持、主流框架集成以及多模态数据跟踪能力。 部署流程包括:1)通过Docker本地部署服务;2)创建项目获取API密钥;3)配置环境变量;4)安装依赖包;5)使用@observe装饰器自动跟踪应用。测试

该配置文件的作用是:使用已经 LoRA 微调好的LLaMA3-8B-Instruct 模型(包括 adapter),加载MMLU 测试集进行 5-shot 评估,结果保存到,每次评估处理 4 条样本。如果后续要评估其他任务(比如或cmmlu_test),只需要更改task字段即LoRA(Low-Rank Adaptation)是一种参数高效微调方法:它不改动原始大模型的参数。而是插入少量可训练的“

机器翻译模型部署详细步骤及api调用测试。

进入根目录和management/server/中执行。原因是宿主机和容器映射端口都被改成了6333。在已激活的 conda 环境中。