简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

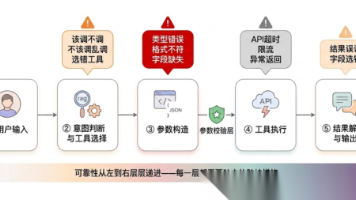

Function Calling 大概是 LLM 应用开发中最拧巴的一个环节——你让一个概率模型去做一件需要百分之百精确的事。模型生成的自然语言可以有措辞差异、可以有风格变化,用户多半不会在意,但一个工具调用的参数少了一个字段、日期格式从 `YYYY-MM-DD` 变成了 `DD/MM/YYYY`、或者枚举值 `pending` 拼成了 `Pending`,下游系统直接报错,整个 Agent 流程

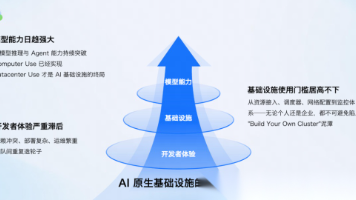

本文整理自 QCon 全球软件开发大会·2026(北京站)明星讲师蚂蚁集团操作系统研发经理谈鉴锋、高级开发工程师周天昱的演讲分享《From Computer Use to Datacenter Use for AI》。

这两年AI圈讨论最多的话题,就是从大模型到Agent(智能体)的进化。当大模型基础设施已经逐步完善,创业者们都在问:下一波机会在哪里?

Agent是以 LLM 为核心,具备规划(Planning)、记忆(Memory)和工具调用(Tool Use)能力,能够自主拆解复杂任务、循环执行、感知反馈并持续推进任务直到完成的计算实体,实现从“文本生成”到“任务自主执行”,不再只是被动响应指令,而是能像人类员工一样,自主实现任务闭环。

一个CTO在技术分享会上说:"我们花了两周搭了个Agent Demo,领导看了直拍大腿。推到生产环境第一周——幻觉、乱花钱、触发安全事件、完全不知道它在干嘛。"台下集体沉默了。

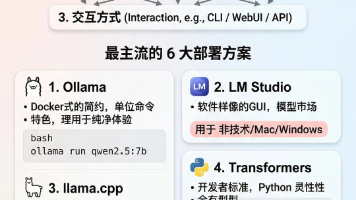

在本地部署大模型是一场非常有意思的探索,梳理了一份全面的指南,希望能帮你找到适合自己的方案。

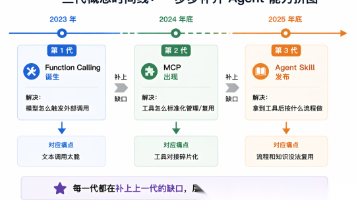

面试官:Function Calling、Skill、MCP 这三个概念有什么区别?🙋♂️我:这三个都是让模型调用外部工具的方式吧?Function Calling 是 OpenAI 的方案,MCP 是 Anthropic 的方案,Skill 也是 Anthropic 的方案,它们是不同时期搞出来的竞争方案。

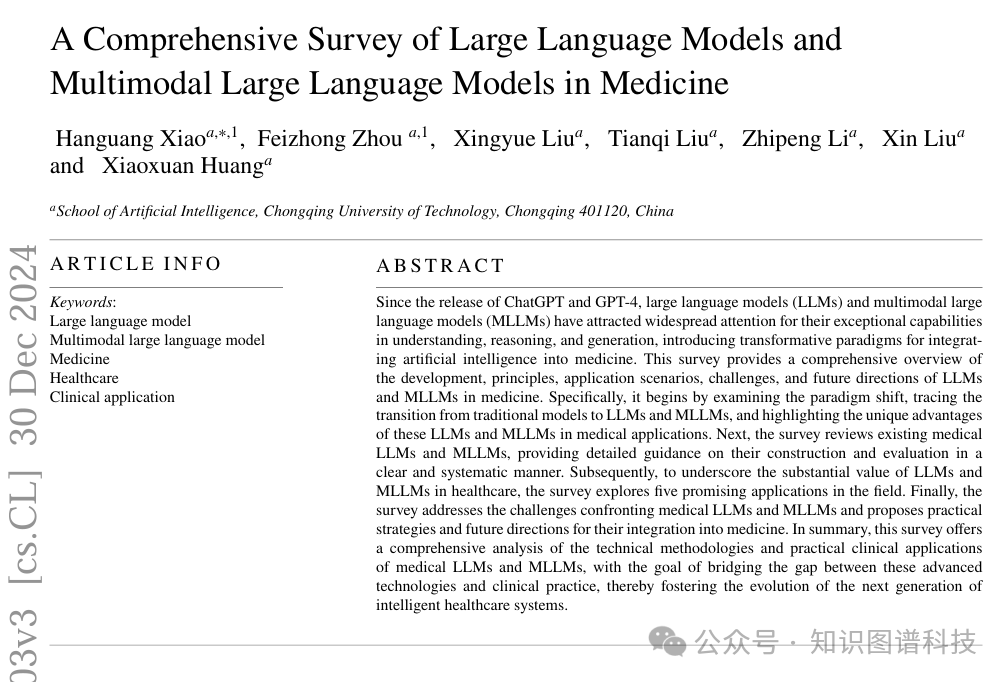

自ChatGPT和GPT-4发布以来,大型语言模型(LLMs)和多模态大型语言模型(MLLMs)因其在理解、推理和生成方面的卓越能力而受到广泛关注,为将人工智能整合到医学中引入了变革性范式。本调查全面概述了LLMs和MLLMs在医学中的发展、原理、应用场景、挑战和未来方向。具体而言,它首先考察了范式转变,追溯了从传统模型到LLMs和MLLMs的转变,并强调了这些LLMs和MLLMs在医学应用中的独

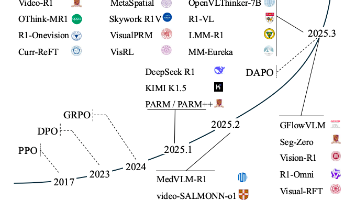

尽管多模态大型语言模型(Multimodal Large Language Models, **MLLMs**)显著扩展了LLMs以处理视觉、音频和视频等多种模态,但在多模态输入之间**实现稳健的推理**仍然是一个重大挑战。**华东师大&字节跳动**系统回顾了**基于强化学习的MLLMs推理**的最新进展,涵盖了关键的算法设计、奖励机制创新以及实际应用。

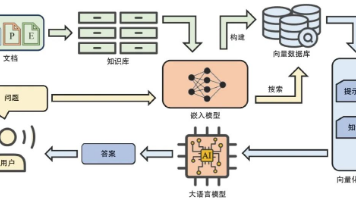

数字金融作为2023年中央金融工作会议提出的“五篇大文章”之一,其目标在于促进金融机构运用数字技术提升重点领域金融服务质效、提高“数实融合”水平,以及建设数字金融服务生态,以推动我国金融领域的高质量发展。基于此背景,交银金融科技有限公司(以下简称“交银金科”)聚焦智慧交易链平台的“蕴通易信”场景,融合多种人工智能技术,积极探索基于检索增强生成(RAG)架构的数字人智能客服应用。实践表明,基于RAG