简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

腾讯云国际站代理商的弹性MapReduce(EMR)服务凭借高性能、弹性伸缩和安全合规特性,结合本地化支持,为跨境企业提供海量数据处理解决方案。适用于跨境电商数据分析、游戏运营数据处理、智慧园区IoT运算、AI模型训练及互联网平台日志分析等场景。代理商提供本地合规、带宽优化及技术支持,配合EMR的弹性算力和多种计算框架,帮助企业实现全球业务数据的实时处理与深度分析,优化运营决策并提升用户体验。

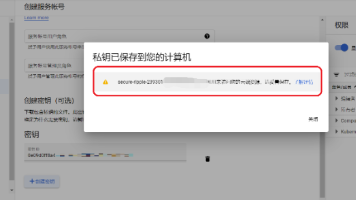

谷歌云服务账号是GCP项目中用于资源访问控制的专用账户。要获取项目ID,需登录GCP控制台,在"IAM和管理"→"设置"中查看。创建服务账号密钥时,需进入"服务账号"模块,填写基本信息后分配必要权限(至少包含"计算引擎-ComputerViewer"和"监控-监控查看者"),最后下载JSON格式的密

如果您的 CLB 是较早创建的,并且当前使用的是 CLB VIP 作为健康探测源 IP,强烈建议您将其切换到 100.64.0.0/10 网段,以确保未来 CLB 集群升级或变动时不会因为 VIP 变化导致健康检查失败。

免费 AI 神器:Google Colab 使用全攻略,轻松开启深度学习之旅

腾讯云在2025全球数字生态大会上发布两大技术升级:全球首款「卓越架构+Multi-Agent」AI治理平台和TCOPAI可观测平台。智能顾问平台通过多智能体协同,实现业务场景化治理,已服务超2万客户;可观测平台引入AI数字分身,向主动式运维进化。同时推出卓越架构师计划,加速技术实践与人才培养。这些创新以"Data+AI"为核心,推动企业高效用云。

火山引擎AI云原生套件全面升级,推出三大核心解决方案:AgentKit强化企业级智能体全流程开发能力,支持20行代码快速构建专业Agent;ServingKit针对AIGC场景优化视觉生成推理性能,最高提速百倍;TrainingKit推出veFusionX等加速框架,重点提升智驾、多模态等垂类模型的训练效率。本次升级实现了从模型训练、推理到智能体开发的全链路能力提升,助力企业高效构建AI应用。

华为云国际站代理商的CCE(云容器引擎)主要提供容器化应用的部署与管理服务。通过Kubernetes技术,支持自动化运维、弹性伸缩及跨云资源调度,适用于微服务架构和持续集成场景。CCE简化了容器集群的创建和管理流程,内置安全策略和监控工具,确保应用的高可用性。支持混合云和多云环境,便于企业实现业务全球化部署。该服务还提供DevOps工具链集成,加速应用开发与交付周期,降低运维成本。适用于AI、大数

Kubernetes(K8s)是Google基于Borg系统经验开发的容器集群管理系统,旨在简化容器化应用的部署和管理。其核心特点包括自动化、可移植性和可扩展性,提供自动部署、负载均衡等功能。Pod是K8s的最小操作单元,由共享网络和存储的多个容器组成,其中Pause根容器用于状态判断和资源共享。K8s已成为云原生计算的关键平台,支持微服务架构和大规模应用部署。

华为云GES图引擎服务为国际代理商提供八大高价值应用场景解决方案:跨境金融风控(千亿级关系秒级分析)、跨境电商智能运营(推荐转化提升10倍)、智慧城市/安防(极端环境适配)、跨境供应链协同(效率提升50%)、政企合规治理、跨境物流优化(分拣效率提升20%)、IT智能运维(故障恢复缩短80%)及医疗知识图谱(符合HIPAA/GDPR)。通过"GES+昇腾硬适配+本地化服务"打包方

华为云国际站代理商通过镜像管理服务(IMS)和图像识别服务(ImageRecognition)构建差异化服务能力。IMS提供批量部署、跨境迁移和合规镜像功能,可将部署效率提升80%;图像识别服务结合昇腾硬件,实现高精度视觉分析和定制化模型训练。代理商可打包"镜像/视觉+本地化+硬适配"方案,形成25%-50%的毛利提升,并通过合规认证、行业专属镜像等增值服务增强客户粘性。关键落