简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

自 ChatGPT 发布以来,科技界掀起了一场大模型的竞争热潮。数据成为新生产要素,算力成为新基础能源,大模型则成为新生产工具,各行各业从“+A”向“AI+的转变已势不可挡。随着模型参数量从千亿迈向万亿,模型能力更加泛化,大模型对底层算力的诉求进一步升级,超万卡集群成为这一轮大模型基建军备竞赛的标配超万卡集群将有助于压缩大模型训练时间,实现模型能力的快速迭代,并及时对市场趋势作出应对。

时间进入2024年,大模型的热潮不仅没有减退,反而随着OpenAI在年初发布的Sora视频大模型,再次引发了公众和学术界的广泛关注和讨论,进一步证明了大模型技术在当下乃至未来科技发展中的核心地位和不断扩大的影响力。作为一本既适合初学者入门,也适合高年级本科生和研究生作为教材的书籍,作者团队努力全面呈现大模型研究的各个方面,同时避免了没有广泛共识的观点和结论,确保读者能够在当前快速发展的大模型领域获

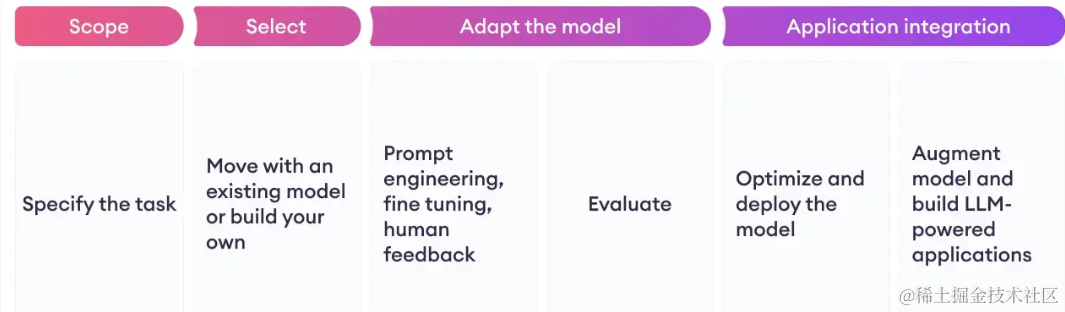

2021年微软提出的 LORA,斯坦福提出的 Prefix-Tuning,谷歌提出的 Prompt Tuning,2022年清华提出的 P-tuning v2、2023年华盛顿大学提出的QLoRA、2024年英伟达提出DoRA等基本上都是属于该范畴)。需要注意的是,与预训练一样,全微调需要足够的内存和计算预算来存储和处理训练过程中的所有梯度、优化器和其他更新组件。其中,大模型微调技术在此过程中起到

根据《行动计划》,本市将布局建设一批人工智能应用场景联合研发平台。“平台将作为连接各方的桥梁,提供技术研发、场景验证、成果转化、人才培养等一体化服务,打通人工智能应用落地的‘最后一公里’。”市科委、中关村管委会信息科技处处长韩健介绍,平台将整合人工智能领域的创新资源,加快推动人工智能技术进步及产业落地。目前,首批联合研发平台正在组织建设。本市将对重大标杆应用工程和示范性应用、细分场景下的大模型应用

来源 | 伯虎财经(bohuFN)近十年来,SaaS(Software as a Service,软件即服务)模式的兴起,为企业提供了一种灵活、高效、成本效益高的软件应用解决方案。其中,钉钉和飞书等平台以其独特的功能和广泛的用户基础,成为中国SaaS行业的领军者。二者的身份信息如下:首先是阿里巴巴集团打造的钉钉,自2015年推出以来就在业内占据领先定位,素有“中国最大在线办公平台”之称。钉钉的定位

使LLM根据不同内容生成更多样化的示例」**。SYNTHESIZRR在提升词汇和语义多样性、模仿人类文本以及提高模型微缩化性能方面,均优于传统方法。

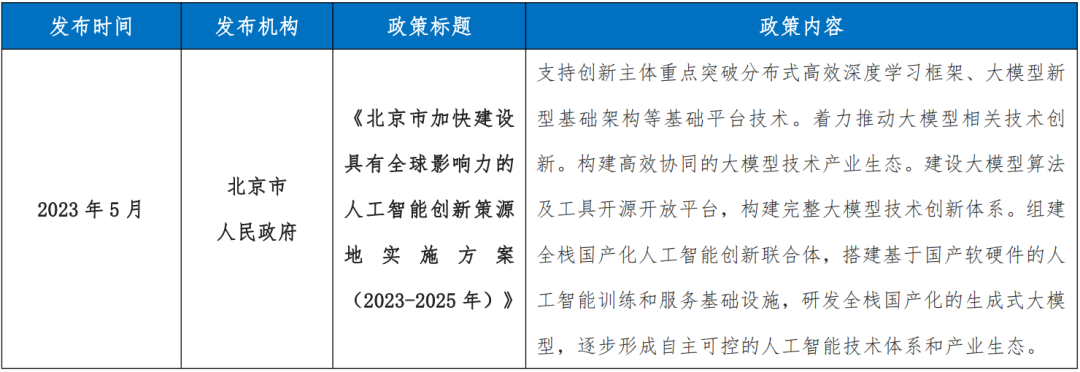

伴随人工智能技术的加速演进,AI 大模型已成为全球科技竞争的新高地、未来产业的新赛道、经济发展的新引擎,发展潜力大、应用前景广。近年来,我国高度重视人工智能的发展,将其上升为国家战略,出台一系列扶持政策和规划,为 AI 大模型产业发展创造了良好的环境。**2024 年,多重利好因素将推动大模型快速发展,首先是“人工智能+”行动等来自政府层面的有力支持,其次用户提升生活、工作效率的需求激增,再加上科

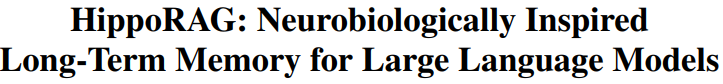

RAG即检索增强生成,为 LLM 提供了从某些数据源检索到的信息,并基于此修正生成的答案。RAG 基本上是 Search + LLM 提示,可以通过大模型回答查询,并将搜索算法所找到的信息作为大模型的上下文。查询和检索到的上下文都会被注入到发送到 LLM 的提示语中。嵌入式搜索引擎可以通过 Faiss 来实现,向量搜索领域成为了RAG的一个助力。像pinecone 这样的向量数据库可以构建开源搜索

自 ChatGPT 面世以来,市场上一直用“iPhone 时刻”“划时代”“工业革命”等关键词来形容 AI 领域的飞速进展。如今,AI大模型的战争已经开启大卷特卷模式。OpenAI 刚刚炸裂推出 GPT-4o,科幻电影照进现实,不仅免费可用,能力更是横跨听图片、看图片、说图片,丝滑流畅毫无延迟,就像在打一个视频电话。然而才一天时间,谷歌就在开发者大会上官宣Gemini、Google 搜索等 9 项

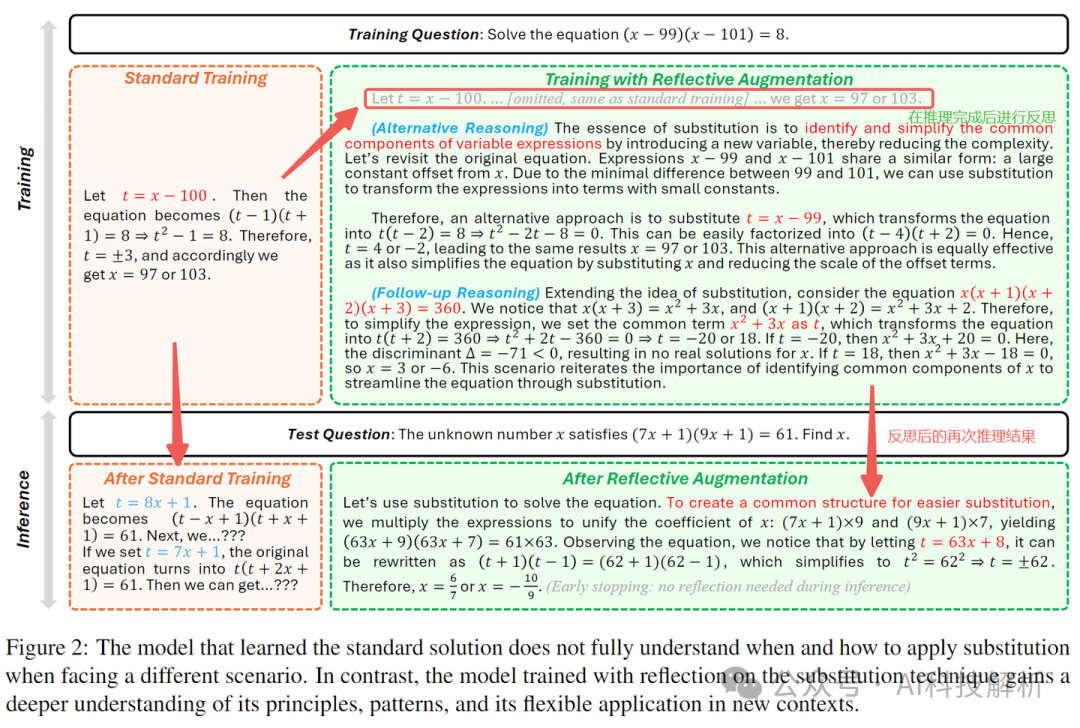

RefAug:prompt增强训练LLM论文提出了一种新的训练策略,名为“reflective augmentation”(简称RefAug),旨在通过在数学问题解答训练实例中嵌入问题反思,来培养语言模型(LMs)更深层次的理解能力。这种方法不仅提高了模型在标准单轮问答(QA)设置中的性能,也显著提升了模型在需要反思性思考的更复杂场景中的性能,如处理后续问题、纠正错误或利用外部反馈。从项目代码中查