简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

找了很久,很不容易弄到了,本来没抠,我还帮你们抠了一下,给没有的分享一下,不用谢了。。

使用git status看看文件是否修改成功,判断是不是修改的文件引起的错误判断是不是有大文件,如果有的话,删除或者替换成小文件在git add .运行时打断,之后再运行git add . 会报错,解决办法为删除index.lock文件。

小白学强化学习系列

1.Docker溯源 Docker的前身是名为dotCloud的小公司,主要提供的是基于 PaaS(Platform as a Service,平台及服务)平台为开发者或开发商提供技术服务,并提供的开发工具和技术框架。因为其为初创的公司,又生于IT行业,dotCloud受到了IBM,亚马逊,google等公司的挤压,发展举步维艰。于是,在2013年dotCloud 的创始人,年仅2...

小白学强化学习系列

一. 基础语法和介绍1.介绍:首先我们来想一下,如果我们想要查询某个区间内的sql记录,有没有什么方便的办法呢?有的人可能会想用关键词来查询。对,这确实是一种办法,可以实现我们的要求。(1)按关键词查询比如我们有5个用户,id分别为1~5,假如我只想查id为1~3个同学的记录。那么就可以用以下语句来查询。select * from user ...

最后来总结一下使用paddlenlp完成医疗文本分类的流程,详细代码请移步医疗文本分类~导包:参考github代码定义指标类别:对于不同的子数据集及任务,使用不同的指标如Accuracy、MultiLabelsMetric、AccuracyAndF1。添加命令行参数:主要用于接受用户从控制台输入的参数。设置随机种子:用于复现训练和测试结果,方便后续进行调试。定义评估方法:传入model、数据加载器

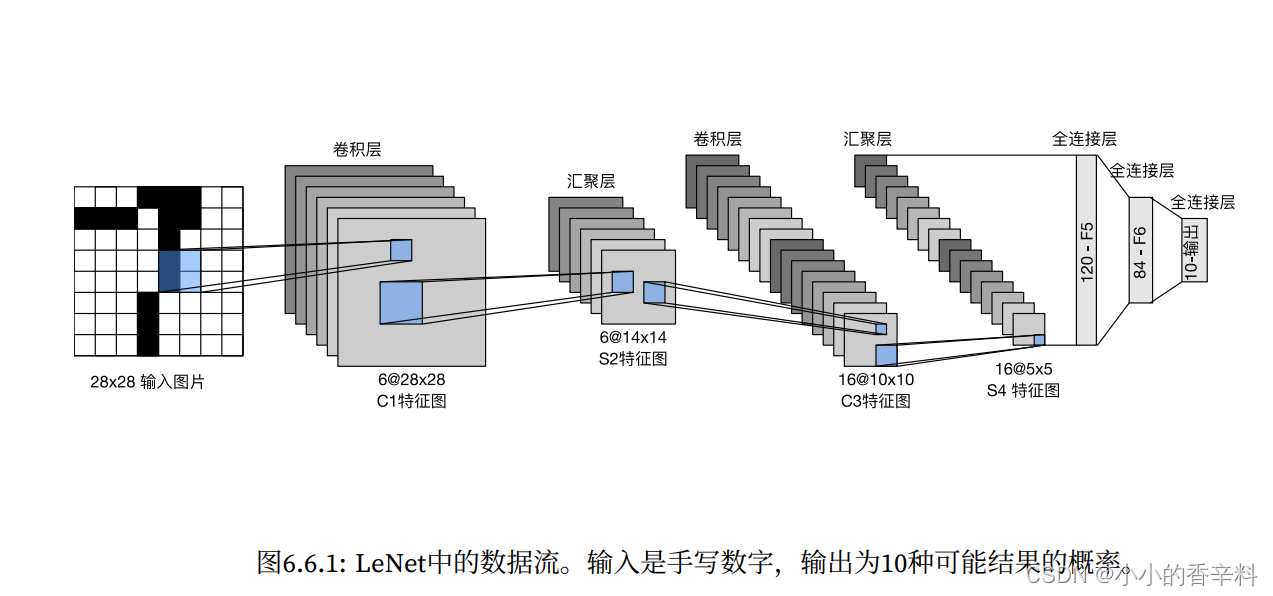

参考沐神6.6. 卷积神经网络(LeNet) — 动手学深度学习 2.0.0-beta0 documentationhttps://zh-v2.d2l.ai/chapter_convolutional-neural-networks/lenet.htmlLeNet的结构图这里沐神稍微做了一点小小的变化,就是最后全连接后面的高斯连接层去掉了,其他和LeNet是完全一样的!LeNet流程输入图片为28

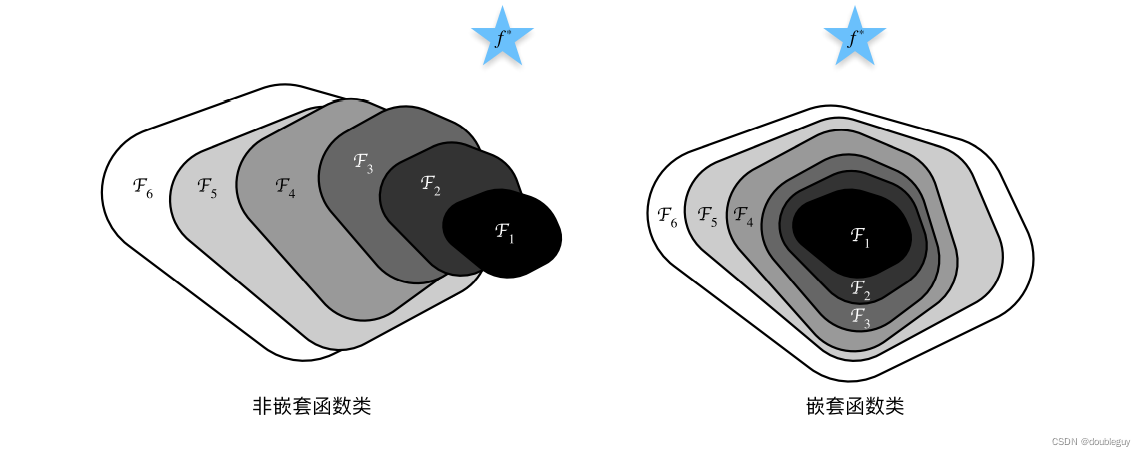

参考沐神7.6. 残差网络(ResNet) — 动手学深度学习 2.0.0-beta0 documentationhttps://zh-v2.d2l.ai/chapter_convolutional-modern/resnet.htmlResNet结构这次就浅记一下,不深入讲解了。创新点是引入残差块,残差块有很好的性质。先看下面内容再展开残差块。简单说一下上图,对于输入X和标签y,我们希望学习一个

定义数据集读取类和模型类#数据集读取#读取单个样本,0,