简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

【大模型】理论基础(4):通识扫盲,一文搞清楚大模型的分类、训练、微调、部署

摘要:本文系统介绍了大模型开发的核心流程和关键技术。首先阐述了预训练(获取基础能力)、微调(增强专项能力)和部署(模型服务化)的概念及相互关系。其次详细说明了基于HuggingFace标准的模型训练方法,包括代码库和可视化平台两种途径。然后列举了SFT、RLHF、DPO等主流微调技术,以及LORA、RAG等增强手段。最后对模型进行了系统分类,涵盖文本理解、生成、多模态等8大类典型任务,并指出虽然应

【ES数据可视化】kibana实现数据大屏

一文快速入门kibana数据可视化,用kibana来搭建数据大屏

数据结构(8)树形结构——B树、B+树(含完整建树过程)

B树、B+树的概念,完整的建树过程。

数据结构(5)树形结构——二叉搜索树(JAVA代码实现)

二叉搜索树的概念,用JAVA实现二叉搜索树的插入、查找、删除。

【大数据】Hadoop下载安装及伪分布式集群搭建教程

一文详解hadoop下载安装以及伪分布式集群搭建教程

【大数据】分布式文件系统HDFS

一文快速聊明白HDFS的核心概念

【大数据】分布式数据库HBase下载安装教程

一文详解HBase下载安装教程。

【大数据】LSM树,专为海量数据读写而生的数据结构

一文详聊LSM树这种专为海量数据读写而生的数据结构

【大模型】理论基础(3):transformer,模型架构的基座

本文概述了Transformer模型的核心机制。首先通过分词和词嵌入将输入转换为向量,并加入位置信息。关键在于自注意力机制:使用QKV矩阵计算词间关联,通过多头注意力整合上下文信息。编码器通过残差网络和归一化处理梯度消失问题,解码器则利用掩码和交叉注意力生成输出。最终将上下文向量投影到词汇空间,预测下一个词。Transformer通过这一系列操作实现语义理解与生成,每个步骤均保持512维向量不变。

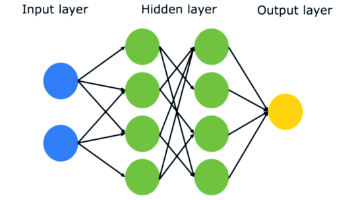

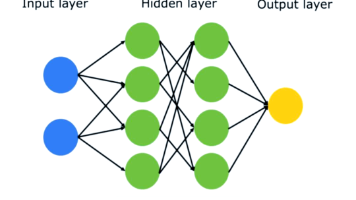

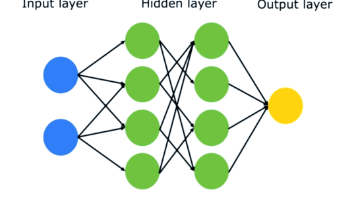

【大模型】理论基础(1):函数与神经网络

用小白都能懂的话,聊懂人工智能的理论基础