简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

文章全面介绍了AI大模型的基础概念、发展历程和革命性意义,详细阐述了多模态大模型的技术架构、训练方法以及如何提升AIGC能力。同时分析了大模型的高门槛(参数、数据、算力需求)并展望了多模态发展的未来趋势,为读者提供了从入门到精通的系统性学习路径。

大模型推理部署框架的选择应基于业务需求、硬件资源和未来扩展规划。vLLM和TensorRT-LLM在企业级高并发场景下表现最佳,SGLang在高吞吐量和多轮对话场景下具有明显优势,Ollama适合个人开发和快速原型验证,XInference和LightLLM则在分布式部署和边缘计算方面展现出潜力,LMDeploy和昇腾框架则在国产硬件适配上具有独特优势。如何学习AI大模型?“最先掌握AI的人,将会

又给自己开了个天坑要填,在给自己挖坑这件事儿上,我一直都很清新脱俗…求鼓励求建议,要不然感觉很难坚持下去了哈哈哈…如果对这个系列有什么想法和诉求,十分欢迎交流讨论!

前期介绍过很多语音合成的模型,比如ChatTTS,微软语音合成大模型,字节跳动自家发布的语音合成模型Seed-TTS。其模型随着技术的不断发展,模型说话的声音也越来越像人类,虽然 seed-tts 可以进行语音合成等功能,但是其模型并没有开源,本期介绍的MaskGCT文本转语音模型是一个开源的模型,不仅可以生成语音,还可以模仿任何人说话的声音,且可以进行语气的转换。大规模的文本转语音(TTS)系统

题目: 在一个15T Tokens的数据集上,基于1024张H100训练一个70B参数量的模型,预估需要几天时间?01大语言模型训练成本大型语言模型(LLM)是自然语言处理领域的一场革命。若要在项目中使用OpenAI等公司提供的LLM,我们需要支付高昂费用。于是问题来了:为何不从头开始训练自己的LLM,从而无需向其他公司付费?让我们来剖析从头训练LLM所需的成本。一般来说大模型的训练成本主要取决于

今天给大家介绍一篇关于大模型在时间序列应用探讨的工作。这篇文章质疑大语言模型在时间序列预测中是否有效,并对目前最先进的3个基于大语言模型的时间序列预测模型进行实验,发现。随着大语言模型的兴起,一些工作也将其应用到时间序列预测领域。这类方法一般基于预训练好的NLP领域的语言模型,将时间序列转换成文本形式输入其中,通过finetune大模型,产出预测结果。典型的代表工作包括OneFitsAll、Tim

续上一篇的内容第十一章:GraphRAG - 知识图谱增强检索11.1 传统RAG的局限性在前面章节中,我们使用的都是文本块(Chunk)检索的方式。虽然已经很强大,但在某些场景下仍有局限:场景1:多跳推理问题场景2:全局性总结问题11.2 GraphRAG核心思想GraphRAG通过知识图谱来组织信息,建立实体之间的显式关系:GraphRAG的优势:关系显式化:不再依赖文本相似度,而是通过图结构

近年来,随着深度学习技术的飞速发展,多模态学习逐渐成为人工智能领域的研究热点。与单一模态不同,多模态学习旨在利用不同模态数据(如文本、图像、音频等)之间的互补信息,构建更加全面、准确的智能模型。多模态融合是实现多模态学习的关键,其目标是在特征或决策层面实现不同模态表示的有效整合。然而,设计高效的多模态融合架构仍面临诸多挑战,如模态间的异构性、语义鸿沟、数据预处理与对齐等。针对这些挑战,学术界提出了

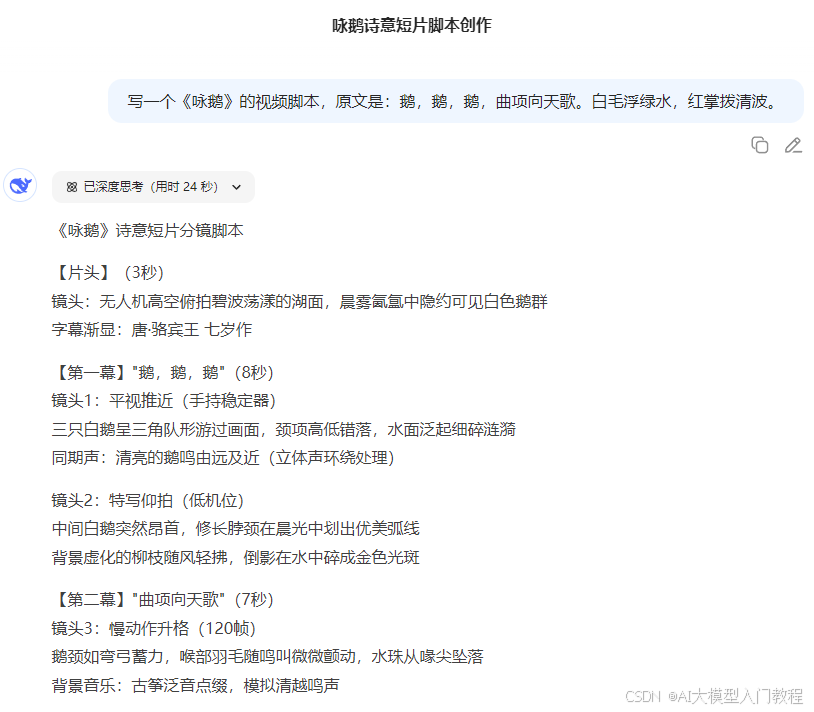

自从做了立夏短片之后,这个王炸组合我就一直在复用了:deepseek+即梦+Vidu。文章分为五大部分:一、脚本创作(deepseek)二、画面制作(即梦AI)三、视频制作(Vidu)四、剪映剪辑,时长01:01让我看看是谁,还不会用deepseek(免费)写脚本和关键词?打开网站,输入:写一个《咏鹅》的视频脚本,原文是:鹅,鹅,鹅,曲项向天歌。白毛浮绿水,红掌拨清波。(记得勾选深度思考)一会儿给

最近和智谱的哥们聊天,讨论到最近的一些大模型进展,包括o3等。跟哥们感叹说,现在搞大模型真是一个好时代,以前要做很多链路环节的技术架构,全部简化,直接利用大模型本身能力就好,多快好省的去做一些场景的落地。我说,确实是这样的,现在各家文本大模型基本都有免费版本了,要是多模态理解大模型也能有免部署的免费版本就好了。哥们说,你这找对人了,我们的GLM-4V-Flash前几天免费了,你去bigmodel里