简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

为什么鸿蒙开发人员的就业前景被广泛看好,以至于在招聘市场上引发了一场“人才争夺战”呢?

1、导入模块2、构造NotificationRequest对象,并发布通知。普通文本类型通知由标题、文本内容和附加信息三个字段组成,其中标题和文本内容是必填字段${3、运行效果如下图所示。

华为宣布,将在1月18日,在北京、上海、杭州、南京、成都、厦门、武汉、长沙 8 大城市同时召开大会。届时将揭秘鸿蒙生态和 HarmonyOS NEXT 进阶新篇章。简单的来说就是,纯血鸿蒙系统,即将彻底揭晓!!!鸿蒙系统自推出来以来,就一直再被质疑是Android套壳,正如余承东所言,鸿蒙生态经历了艰难的四年,但轻舟已过万重山。鸿蒙敢于迈出这一步,超7亿设备量、200多万开发者,就是底气。

恭喜!通过以上几步,你已经拥有了一个专属的星座运势助手。但通篇文章下来,我真正希望你带走的,不仅仅是这个能用的小工具,更不是其中几个插件的简单用法,而是搭建AI Agent的一种“工作流”思维。不知你是否还记得开头提到的"2030年90%普及率"?说不定当那一天到来时,AI Agent将像Word、Excel一样成为职场标配。

•通用语言模型智谱AI阿里云的共3种)•编程专用模型智谱AI深度寻的共3种)•创意生成模型智谱AI的共1种)•视频和多媒体生成模型智谱AI的共1种)•嵌入和音频处理模型:5 种(无中国大模型)我们经常使用的目前总共有32 种不同的大模型,其中中国的大模型数量为8 种,主要来自智谱AI阿里云深度寻等厂商。这些模型覆盖了语言理解、编程、创意生成以及视频多媒体等领域,可以为不同需求的用户提供支持。AI大

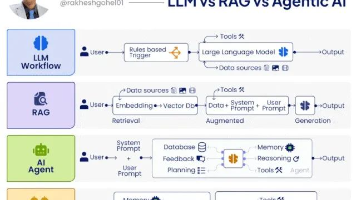

2025年作为Agent发展元年,Manus敲响了AI 应用大发展的号角,各种Agent应用层出不穷。这些智能体基本框架是怎样的,哪些更有前景?最近在海外看到一张「2025 年 AI Agent 技术趋势全景图」,觉得非常精彩,分享出来和大家交流。这张图是《Agentic AI:利用 AI 代理重塑商业与工作》作者拉凯什·戈赫尔所做,看趋势图之前,可以先看这张涵盖LLM Workflow、RAG、

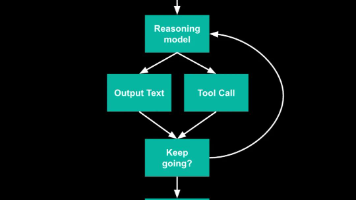

本文盘点了七款主流AI Agent开发框架:LangGraph、AutoGen、CrewAI、OpenAI Agents SDK、Google ADK、MetaGPT和PydanticAI。各框架特点鲜明:LangGraph专注于有状态工作流,AutoGen支持多智能体协作,CrewAI强调高性能与灵活性,OpenAI Agents SDK提供极简核心原语,Google ADK具备模块化设计,Me

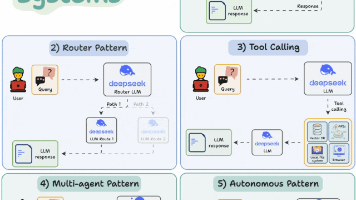

文章全面解析了AI Agent系统,包括其基本概念(大语言模型与工具的循环系统)、构建难点(确保LLM有合适上下文)、框架选型维度(工作流与代理、可预测性、门槛上限等)以及6种架构设计模式(路由分发、代理、微调缓存、目标导向、智能体组合和双重安全)。文章强调,构建可靠AI Agent的关键是控制LLM的上下文,并推荐使用LangGraph等框架同时支持工作流和AI Agent,以实现最佳可靠性和灵

这是一种针对大语言模型(LLM)应用,通过测试、评估、分析以及优化提示词和工具,系统性改进提示词的实践。是用自然语言进行编程!提示工程往往也是概念工程——确定模型预期行为,界定任务中“表现良好”的含义,传递清晰概念。清晰、明确、精准的文字表达以科学思维创建评估体系,持续开展测试产品思维——你的产品理想的模型行为是怎样的?了解大语言模型,知晓其特点与局限汇总并分析失效模式,思考修复办法考量边缘案例,

随着大数据时代的到来,向量数据库作为一种专门为存储和查询向量数据而设计的数据库系统,在机器学习和数据科学领域中发挥着重要作用。本文将介绍向量数据库的概念及其常见类别。