简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

方法适用场景复杂度适用于深度学习数学运算数值型特征低❌多项式特征数值型特征中❌One-Hot 交叉类别型特征高❌哈希交叉大规模类别型低❌Embedding 交叉类别型特征高✅树模型交叉类别 & 数值中✅自动化交叉所有特征高✅。

DeepFM 是一种结合 深度学习 (Deep Learning) 和 因子分解机 (Factorization Machine, FM) 的推荐系统模型。它能够同时学习 低阶特征交互(FM 部分) 和 高阶特征交互(DNN 部分)。在 召回阶段,UserCF(User-Based Collaborative Filtering,基于用户的协同过滤)需要计算用户相似度,以便推荐相似用户喜欢的物品。

最近实习步入正轨,也终于闲下来了,就想着总结一下上半年参与的比赛。今年上半年参加了不少的比赛也拿了些奖金,也靠着比赛经历获得了第一份实习,还算过的比较充实的,后续会陆续更新其他的比赛的代码。主要是总结总结,感觉每次比赛中会尝试很多方法但是比赛完又不总结,浪费太多时间了。

今天为了更新一下显卡驱动,下载使用一下了鲁大师,然后卸载。悲催的发现打开google浏览器却会弹出360的导航页。解决办法:打开Google浏览器设置,找到启动时,点击删除【打开特定网页】

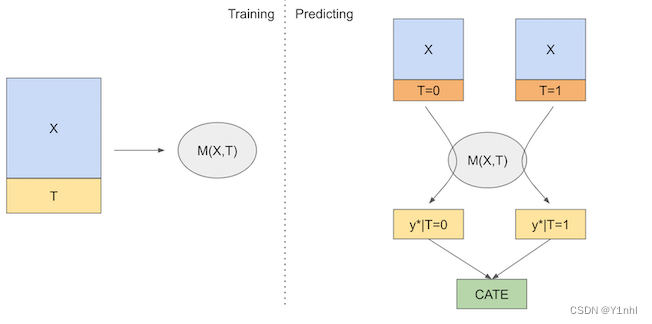

元学习器是利用一些现成的机器学习方法来进行因果推断的方法。也是相对来说最简单的进行因果推断的模型,在econml和causalml都有实现,调用也相对比较方便。

项目NCELoss本质分类任务(正 vs 负)Softmax 近似是否校正偏差❌ 否(拟合二分类目标)✅ 是(log 采样概率校正)推理一致性❌ 不一致✅ 一致(训练/推理)采样分布要求灵活需明确估计qyq(y)qyNCELoss 多用于 word2vec、representation learning 等 embedding 学习场景Sampled Softmax 多用于大规模分类任务、推荐系统

Triplet Loss 用于强化 anchor 和 positive 的距离比 anchor 和 negative 的距离更近,通常用于 embedding 学习。BPR Loss 是推荐召回中非常经典的pairwise ranking loss,目的是让正样本得分比负样本得分高。model.eval()# 设置为推理模式,使用moving统计量。model.train()# 设置为训练模式,使

模型名称低阶交互建模高阶交互建模需要人工特征工程共享 Embedding手工特征 (Wide)DNN (Deep)✅ 需要人工特征❌ 不共享WideFMFMDNN❌ 不需要人工特征❌ 不共享DeepFMFMDNN❌ 不需要人工特征✅ 共享xDeepFM(eXtreme Deep Factorization Machine) 是在 DeepFM 之后提出的一种推荐系统模型,主要用于 自动学习高阶特征

见【搜广推校招面经六、七、十一】nn.ReLU(),nn.ReLU(),# 输出层:FM 和 DNN 部分的输出拼接self.output_layer = nn.Linear(1 + 1, 1) # FM 输出与 DNN 输出拼接# FM 部分:计算特征的二阶交互# DNN 部分:通过嵌入层和神经网络计算高阶特征交互# 输出层:将 FM 和 DNN 的输出拼接起来# 示例n_features =