简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

之前咱不是说多模态大模型的效果不好吗?我又试了一下,应该是之前的设置有问题。

我们之前说过,在dify里配置ollama时,由于dify是在docker里,而ollama是在宿主机上,所以二者的网络需要一些技巧来打通。其中有一个办法,就是把ollama的IP暴露出来。这其实看似不安全,实则还挺危险的。当时,就一直想着,如果能用docker部署ollama就好了。

Ollama 的更新本质是二进制替换+服务重启,重点在于环境适配与配置继承。建议生产环境优先选择脚本自动更新,并关注官方GitHub的版本日志。遇到驱动或网络问题可参考离线方案,模型兼容性问题可通过重拉取解决。附:更新后性能测试工具推荐"prompt": "解释量子纠缠效应"}' # 测响应速度与完整性。

今天和同事聊天,聊到多模态大模型,感觉可以作为2025年的一个新的探索方向。希望和大家一起学习,一起进步。今天也是尝试了我能想到的最基本最快速地本地部署多模态大模型的方式,那便是使用ollama。ollama之前咱安装过,然后现在也是直接使用就好。

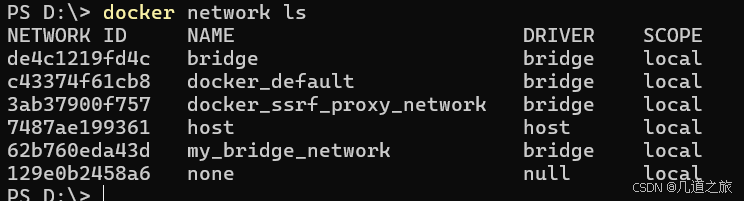

是 Docker 提供的一个命令,用于将现有的容器连接到一个指定的网络中。通过这个命令,用户可以让容器加入到不同的网络环境中,从而实现容器间的通信或者与外部网络的交互。一旦容器被连接到某个网络,它就能够与其他同处该网络中的容器进行直接通信,而无需依赖于主机的 IP 地址或端口映射。

这个错误表明Docker无法识别或加载支持GPU所需的设备驱动程序。以加载内核模块(常见于Ubuntu)。),手动安装后重启服务。

产生的原因是,在docker run时,不小心在命令最后加了个.为什么会错得这么离谱呢?—— 一个字符的偏差可能引发连锁故障。Docker 的命令行参数覆盖机制对新手不友好,多一个字符可能导致完全不同的行为。若开发环境中存在同名文件或目录(如当前目录下恰好有可执行文件。),错误可能被掩盖;命令包含特定字符),避免低级错误进入生产环境。可能被误解析为路径参数,导致脚本逻辑混乱。build的时候有点,

随着图数据库(Graph Database)的流行,越来越多的应用场景开始采用图数据库来处理复杂的关系数据。Neo4j作为领先的图数据库之一,提供了强大的图形查询语言Cypher、高效的存储结构和丰富的生态系统,使得它成为开发人员构建关联性数据分析应用的理想选择。本文将指导您如何使用Docker容器化技术快速部署Neo4j,并通过GraphRAG(Graph Retrieval and Gener

在VS Code中运行Python程序时,正确配置虚拟环境解释器是项目依赖管理的重要环节。以下是如何使用。

我们之前说过,在dify里配置ollama时,由于dify是在docker里,而ollama是在宿主机上,所以二者的网络需要一些技巧来打通。其中有一个办法,就是把ollama的IP暴露出来。这其实看似不安全,实则还挺危险的。当时,就一直想着,如果能用docker部署ollama就好了。