简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

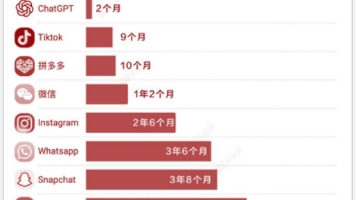

•在A I领域,美国长期以来通过垄断算力(即计算能力)来维持其主 导地位,但技术突破(如Deep Seek在算力效率上的创新)正在挑 战这种垄断 •具体来说,DeepSeek通过算法创新和算力优化,展示了如何用更 少的算力和更低的成本实现高效的A I模型训练和推理,这打破了美 国在AI算力上的垄断优势。日活奇迹:上线5 天超越Chat GP T 历史峰值,18天突破1600 万。技术突破(如算力效

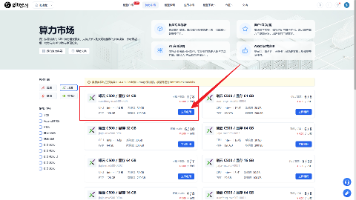

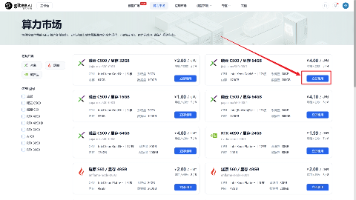

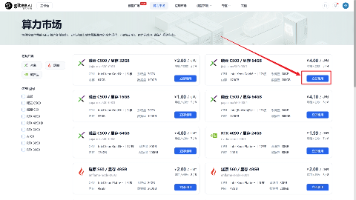

《OpenClaw实践指南》介绍了在模力方舟算力环境中快速部署OpenClaw的方法。主要内容包括:1)选择燧原S60或沐曦曦云C500算力并创建实例;2)通过Jupyter终端启动OpenClaw网关服务;3)在本地建立SSH隧道连接云端服务;4)访问WebUI界面并进行模型配置。指南建议将轻量级任务部署在云端,本地通过浏览器访问,实现"国产算力+国产模型"的低成本灵活应用。

《ComfyUI实操指南摘要》 ComfyUI是一款基于节点流程的生成式AI工具,支持文生图、图生视频等多模态创作,涵盖图像修复、扩图、高清放大等功能。指南介绍了快速启动方法:通过预置镜像创建实例,建立SSH隧道连接后访问Web界面。模型管理方面,支持本地模型上传和Moark云端模型调用。进阶功能包含RemoteNode服务,允许低算力环境使用云端资源执行复杂任务。平台提供完整工作流示例,适用于电

《ComfyUI实操指南摘要》 ComfyUI是一款基于节点流程的生成式AI工具,支持文生图、图生视频等多模态创作,涵盖图像修复、扩图、高清放大等功能。指南介绍了快速启动方法:通过预置镜像创建实例,建立SSH隧道连接后访问Web界面。模型管理方面,支持本地模型上传和Moark云端模型调用。进阶功能包含RemoteNode服务,允许低算力环境使用云端资源执行复杂任务。平台提供完整工作流示例,适用于电

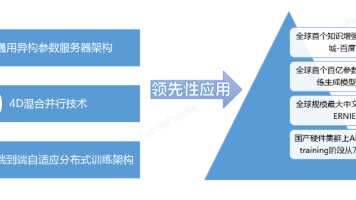

摘要:分布式训练技术已成为深度学习领域应对大规模数据和模型训练的关键解决方案。本文介绍了两种主要训练模式:集合通信模式适用于CV/NLP等稠密参数模型,通过数据并行、参数切片等技术实现高效训练;参数服务器模式则针对搜索推荐等稀疏参数场景,采用中心化参数管理方式。飞桨框架在此基础上研发了多项领先技术,包括4D混合并行、异构多云训练、通用参数服务器等,在MLPerf等基准测试中展现出卓越性能,支持了文

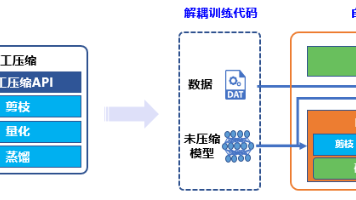

模型自动化压缩工具(ACT)通过量化、蒸馏、剪枝等技术实现深度学习模型的小型化,显著提升推理速度并降低资源消耗。相比传统手工压缩,ACT具有三大优势:解耦训练代码实现零代码修改,全流程自动优化简化操作流程,支持多种压缩算法灵活组合。实际测试显示,在MobileNetV1等模型上,压缩后精度损失小于0.1%,推理速度提升1.4-7.1倍。该工具支持飞桨和PyTorch框架,提供硬件感知优化和超参自动

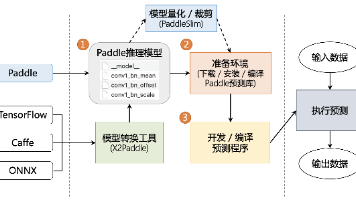

Paddle Inference 是飞桨的原生推理库, 作用于服务器端和云端,提供高性能的推理能力。由于能力直接基于飞桨的训练算子,因此 Paddle Inference 可以通用支持飞桨训练出的所有模型。Paddle Inference 功能特性丰富,性能优异,针对不同平台不同的应用场景进行了深度的适配优化,做到高吞吐、低时延,保证了飞桨模型在服务器端即训即用,快速部署。一些常见的文档链接如下:

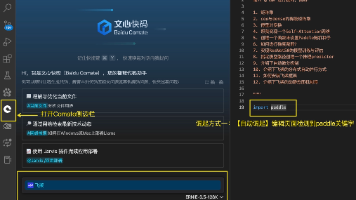

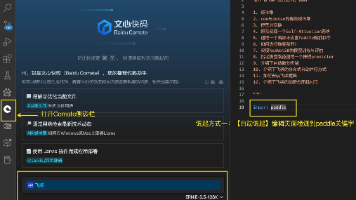

摘要:百度推出的文心快码(BaiduComate)基于文心大模型,为飞桨开发者提供AI编程助手功能。该工具支持自动/手动调起,具备五大核心能力:1)通用问答解决深度学习问题;2)智能代码补全;3)定制化飞桨代码生成;4)多框架代码转换(尤其优化PyTorch转换);5)专业代码解释。通过自动检测import paddle或输入指令即可使用,显著提升飞桨开发效率,支持从代码编写到迁移的全流程需求。

摘要:百度推出基于文心大模型的"飞桨AI编程助手",集成在文心快码(BaiduComate)中,为飞桨开发者提供智能编程支持。该助手提供五种核心功能:通用问答、代码补全、代码生成、跨框架代码转换(特别优化PyTorch转换)和代码解释,显著提升深度学习开发效率。用户可通过导入paddle自动触发或手动输入指令调起助手,支持文件级批量处理和交互式多轮对话,帮助开发者快速完成模型构

Ingress 是一个 API 对象,通常通过 HTTP 管理群集中对服务的外部访问,这是公开服务的。• 数据包到达 node2 的 eth0,然后返回 flannel0 进行解封装,然后将其发送回根网。• 再次将数据包转发到 Linux 网桥,以发出 ARP 请求,以找出属于 veth1 的 IP。• 因此,网桥将数据包发送到 flannel0,因为节点的路由表已配置了 flannel0。现在,