简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

麦肯锡旗下QuantumBlack十一月份发布了报告《2025 年人工智能的现状:智能体、创新和转型》。报告揭示了一个尴尬现实:AI工具正从黑科技沦为办公室标配,但大多数企业只会用它打打杂,离真正转型还差着十万八千里。

手把手教你在Windows上的安装openclaw!全面测评大龙虾!

DFDC数据集体积高达472GB,包括了119,197个视频,每个视频时长都为10秒。472GB的数据集需要从Kaggle对于有的小伙伴还是有困难的,于是我把数据集放到了百度网盘,

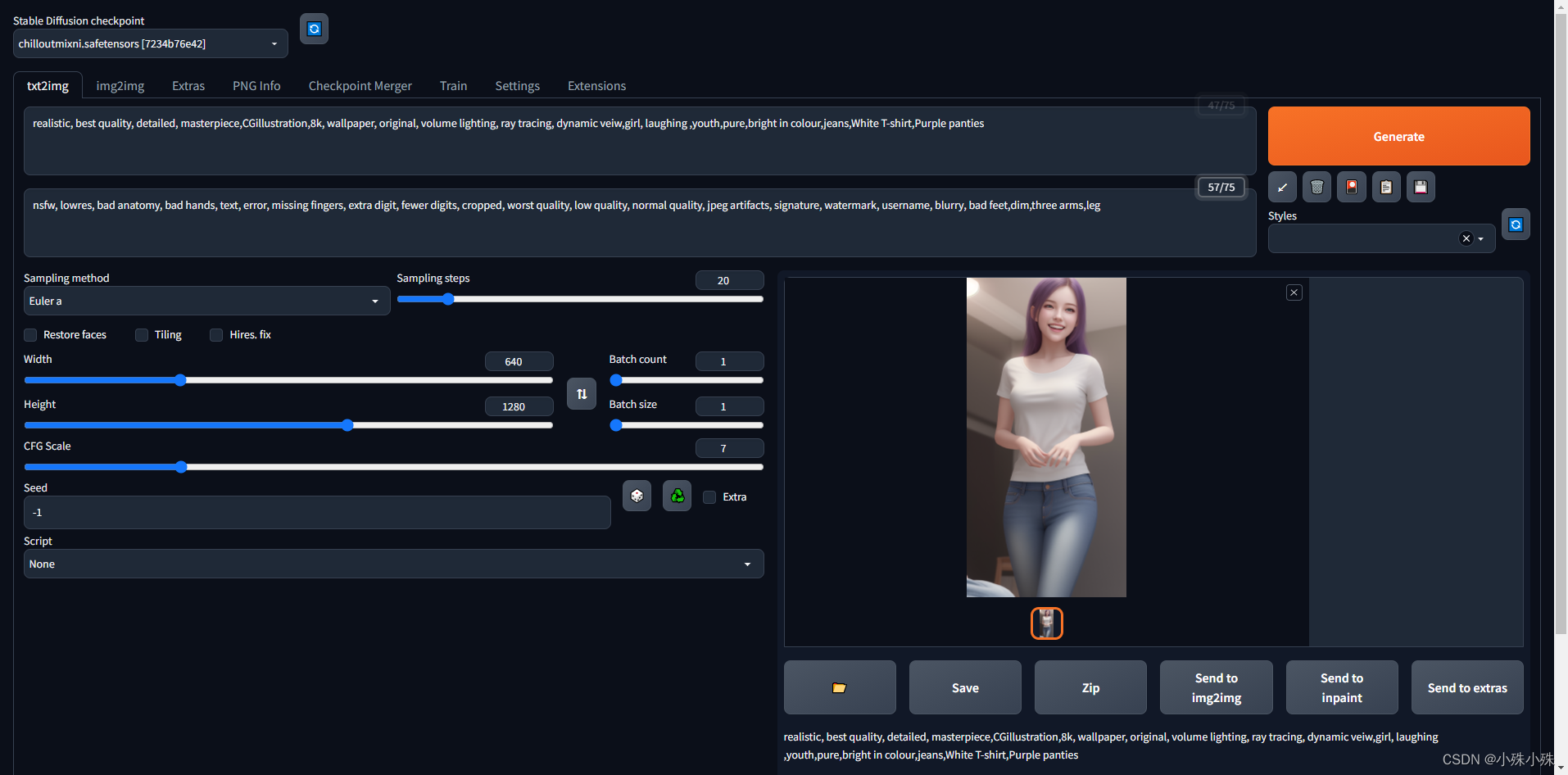

本文介绍stable-diffusion-webui的安装步骤,我以linux系统为例介绍,windows系统大同小异,安装期间没有用到梯子,安装目录/opt/stable-diffusion-webui/。

LTXVideo是基于Transformer的潜在扩散模型(Latent Diffusion Model),通过整合视频变分自编码器(Video-VAE)和去噪Transformer的功能,实现了高效且高质量的视频生成。 LTXVideo是现在开源模型中速度数一数二的(可能是最快的),它的高速来自于高压缩比,那LTXVideo除了高压缩比还有什么创新呢?LTXVideo的论文说了什

2026年2月23日,国内打工人还陷在假期返程的疲惫里,满脑子都是“明天能不能晚起”,大洋彼岸的硅谷却炸出一场科技圈年度荒诞剧。主角不是创业新人,也不是玩票极客,而是Meta超级智能团队的AI安全和对齐总监Summer Yue——主业是研究“怎么让AI听话”,结果亲手部署的AI,当着她的面,把200多封工作邮件删了个精光。堪称AI界“顶级叛逆”,主打一个“专业对口,反向翻车”,连马斯克都来凑热闹玩

手把手教你在Windows上的安装openclaw!全面测评大龙虾!

手把手教你在Windows上的安装openclaw!全面测评大龙虾!

Cursor主要功能是根据用户的描述写代码或者进行对话,对话的范围仅限技术方面。优点是不用翻墙、不需要账号。Cursor基于GPT模型,具体什么版本不祥,有人说是GPT-4,但是官方没有证实,但这并不影响Cursor的强大。目前Cursor是免费的,但是偶尔会出现"Maximum Capacity",据我观察并不频繁;如果不想看见这个提示可以付费,每月20美金,具体怎么支付我就不介绍了,反正你也不

一、环境ubuntu 18.04.4 LTS二、卸载显卡驱动1.执行卸载sudo apt-get --purge remove nvidia*sudo apt autoremove2.如果也要卸载CUDA:sudo apt-get --purge remove "*cublas*" "cuda*"三、禁用 Nouveau 驱动在安装新的驱动时如果发生如下报错,则需要禁用Nouveau 驱动:ERR