简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

一个新的开源项目:让AI Agent 自己反思、总结、变聪明 | Agentic Context Engine(ACE),新开源还不火,功能不错:它让AI Agent像人一样——在执行任务后自己反思、总结经验并改进。

和员外一起从上家公司离职后,我们便携手创办了属于自己的公司,全身心投入到 RAG 大模型 AI 产品应用的研发之中。这段历程里,我们恰好经历了一个春节,前后算下来,总耗时大概三个月左右。这三个月里,我们几乎全程昼夜兼程、全力以赴,直到三月底,我们的产品终于有了基础雏形,也算不负这段时间的奔波与付出。

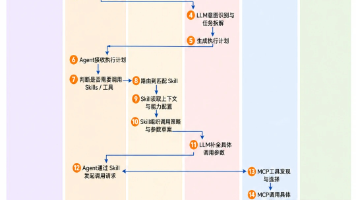

很多人一提到 AI Agent,就会想到是“会调用工具的大模型”。但真正画成流程图以后会发现,它不是简单地“用户提问 → 大模型回答”,中间其实有一整套运行链路:

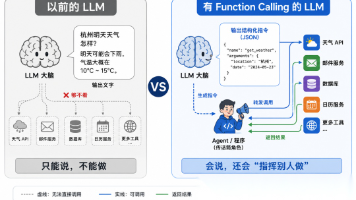

上期小编挖了个坑——"后面会单独出一个系列介绍工具调用"。坑挖太久容易塌,所以这期赶紧来填。本文带你一口气搞懂 AI 工具调用的三代技术演进:Function Calling → MCP → Agent Skills。看完你就明白,为什么给 AI "装手脚" 这件事,比你想的复杂得多。万字长文,建议收藏。

这篇文章帮你搞定 LangGraph 流式处理的底层原理,从 asyncio 流到 Token 级输出

普通人年薪10-15K,掌握AI应用开发的你,年薪50万。> 这不是鸡汤,这是正在发生的职业重构。

大模型发展对算力需求激增,高端AI芯片是关键。大模型需千卡以上AI芯片构成的服务器集群支撑,高端芯片供不应求。GPT-4模型参数规模达1.9万亿,训练所需GPU数量较GPT-3增加近24倍。预计到2024年,我国企业5%—8%的大模型参数将从千亿级跃升至万亿级,算力需求增速达320%。定制化算力解决方案将成为趋势。随着摩尔定律放缓,一体化解决方案已难满足特定计算需求。为实现芯片最佳性能和效率,需针

1. 首次系统性地定义和综述了基于大语言模型增强的强化学习这一新兴领域,提出了完整的概念分类框架。2. 基于智能体-环境交互范式,将大语言模型在强化学习中的作用分为信息处理器、奖励设计器、决策者和生成器四类,并详细分析了每种角色的方法、优势和挑战。

这篇论文提出了一种名为“Brain-like Space”的创新概念,旨在为不同类型的AI模型创建一个统一的几何空间,以便与人类大脑的功能网络进行比较。动机是解决现有脑与AI系统对比研究中输入和任务依赖的问题。

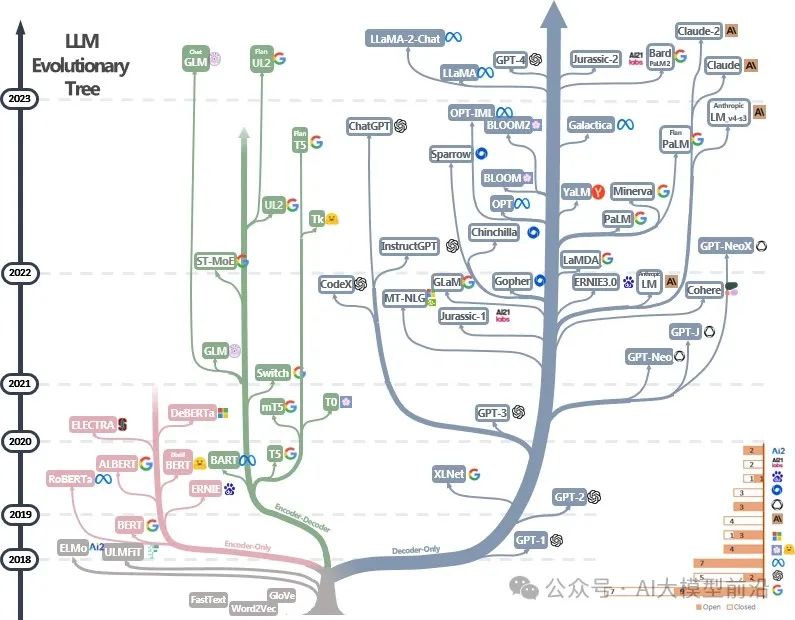

今天发现一本不错的综述可以作为入门大模型技术的书籍。