简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文主要让你更加的掌握LangChain4J,举例子,以及源代码,学习了什么是AiService以及基本应用,制作了一个用户可以指定字数和标题的作家应用,同时还研究了AiService的基本工作原理和源码,其中再次提到了ChatMemory,那么下篇内容我们就来介绍到底什么是ChatMemory。

AI辅助编码无疑为软件开发带来了革命性的变化。它提升了开发效率、提高了代码质量、促进了知识传承与学习,并激发了开发者的创造力和创新精神。然而,在使用过程中也需要保持谨慎和平衡的态度,充分发挥自己的智慧和判断力来确保代码的质量和可靠性。

在线与离线使用并非相互排斥,而是应根据具体的需求和场景来选择。如果注重便捷性和实时性,且对数据隐私要求不高,在线使用是个不错的选择;但如果处理敏感数据或对稳定性、响应速度有较高要求,那么离线使用更值得考虑。同时,这也促使我在未来的使用中,会更加细致地评估需求,权衡利弊,以实现效益的最大化。

让JAVA程序员更快的理解AI接入的LangChain4j

在线与离线使用并非相互排斥,而是应根据具体的需求和场景来选择。如果注重便捷性和实时性,且对数据隐私要求不高,在线使用是个不错的选择;但如果处理敏感数据或对稳定性、响应速度有较高要求,那么离线使用更值得考虑。同时,这也促使我在未来的使用中,会更加细致地评估需求,权衡利弊,以实现效益的最大化。

AI辅助编码无疑为软件开发带来了革命性的变化。它提升了开发效率、提高了代码质量、促进了知识传承与学习,并激发了开发者的创造力和创新精神。然而,在使用过程中也需要保持谨慎和平衡的态度,充分发挥自己的智慧和判断力来确保代码的质量和可靠性。

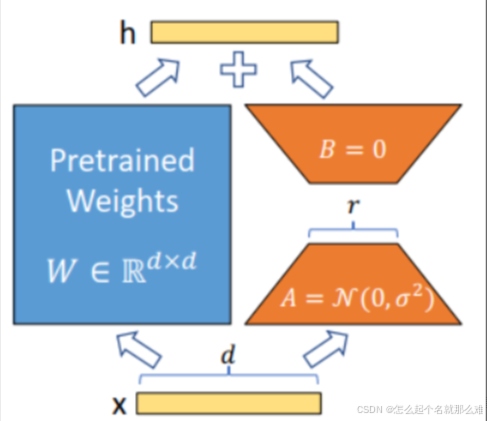

大模型的参数量很大,如果我们基于大模型进行全量的训练,那就需要很多的GPU资源,所以需要微调,而基于Lora的微调则更轻量

企业考虑成本和数据隐私问题,会特别希望能在企业内部部署一套大模型,在企业内部直接调用,这样就能成本可控,数据也不会泄露,所以开源大模型是非常有前景的,目前来说Meta开源的Llama3是开源大模型中性能表现最好的,所以这节课先带大家来尝试使用Ollama来部署Llama3和nomic模型。这样,ollama的服务端就启动了,就可以接收模型的请求调用了,不过可能ollama部署了多个模型,所以请求调

one-api接入了:●OpenAI ChatGPT 系列模型(支持 Azure OpenAI API)●Anthropic Claude 系列模型●Google PaLM2/Gemini 系列模型●Mistral 系列模型●百度文心一言系列模型●阿里通义千问系列模型●讯飞星火认知大模型●智谱 ChatGLM 系列模型●360 智脑●腾讯混元大模型●百川大模型●字节云雀大模型 (WIP)

机器学习就是让计算机来学习,学习如何识别图片、学习如何识别语音,学习的成果就是所谓的模型,学习的方式有很多种,目前主流的就是神经网络,或者叫深度学习。