简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

不需要一步到位。云主机起步 → 瓶颈出现时针对性优化 → 长期稳定后考虑托管降成本。不要在产品还没验证的时候花大量时间搞完美的基础设施方案。云主机跑起来,不行就关不心疼。跑通了再根据实际瓶颈——是IO不行了迁裸金属,是带宽贵了上CDN,是跨网慢了上动态加速——一次解决一个问题。够用就好。等真的需要了再升级,大部分时候你以为需要的比实际需要的多。有问题评论区聊。

摘要:AI编码工具的真实能力与局限 过去一周的实验显示,AI编码在特定场景下表现惊艳:快速生成绿地项目、高效处理重复代码、即时解决报错问题。然而,面对复杂业务逻辑、大规模遗留系统时,AI存在明显短板,如上下文理解不足、逻辑缺陷和无法处理模糊需求。短期内AI无法替代程序员,但会加速淘汰仅会写基础代码的开发者。未来程序员的核心价值将转向系统设计、业务理解和解决方案能力,AI将成为提升效率的强力助手而非

这篇文章比较了三款主流AI编程助手(Cursor、Windsurf和GitHub Copilot)的优缺点。作者通过一个月深度使用后认为:Cursor在新项目开发和多文件重构方面表现突出(Composer功能强大),但价格较贵且偶有错误;Copilot代码补全稳定可靠,适合日常开发但缺乏高级功能;Windsurf目前免费但存在较多问题,尚不成熟。作者建议根据需求组合使用(如Cursor+Copil

摘要: IDC正从卖机柜向卖算力进化,但不会完全等同于水电基础设施。虽然算力需求刚性化、建设标准化、政策推动等趋势明显,但算力的代际差异、场景适配性、软件生态依赖及供需结构性错配等特性使其与水电本质不同。更接近的类比是"电网",需调度能力、技术迭代与绿色整合。未来IDC核心竞争力将转向算力优化与调度,单纯卖空间的模式难以为继,而用户需更关注如何高效匹配算力需求。这一转型或将在2025-2026年迎

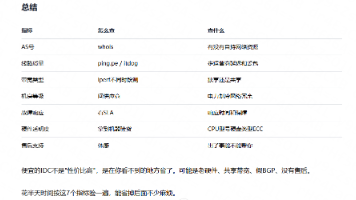

摘要: 选择IDC服务商时,仅看配置和价格容易踩坑。本文提供7个可自行验证的指标:1)查AS号判断网络自主权;2)通过ping.pe多节点测试线路质量;3)不同时段iperf测试区分独享/共享带宽;4)询问机房等级和冗余配置;5)确认书面SLA和故障响应机制;6)验货确保硬件透明;7)评估售后技术支持。这些方法能有效识别IDC的真实服务水平,避免因信息不对称导致的后续问题。核心建议:网络质量和硬件

IPv6在国内的落地现状比大多数人想象的更快。运营商层面,移动网络已基本实现IPv6双栈,家庭宽带多数光猫支持但需手动开启。主流APP和网站后端已悄然支持IPv6,用户无感知使用。IDC行业中云服务器普遍支持IPv6,但物理服务器受限于机房设备。IPv4地址成本飙升正加速IPv6采用。开发者应检查代码中的IPv4硬编码、调整数据库字段长度、配置IPv6防火墙规则,并通过CDN实现平滑过渡。新项目建

摘要: 客户反馈服务器访问延迟从5ms飙升至300ms。排查发现服务器状态正常,但联通用户跨网访问异常。通过traceroute和mtr定位到电信联通互联节点延迟高达245ms,确认是运营商割接导致。临时方案为服务器添加联通IP并配置DNS分运营商解析,将联通用户延迟降至15ms。后续优化包括部署CDN和HTTPDNS,并评估BGP多线方案。关键经验:需从用户网络测试、善用ping.pe和mtr工

AI对不同职业的冲击程度差异显著。翻译(9/10)、基础财务(8/10)和模板化设计(8/10)最危险,因其工作高度标准化;医生(3/10)和资深程序员(3/10)较安全,因涉及复杂决策和低容错率。关键规律:执行层工作易被替代,决策层和人际互动类工作更保值。建议从业者聚焦AI难以替代的创意、业务理解和决策能力,从执行者转型为策略制定者。职业风险取决于工作内容的标准化程度、容错率和创意需求。

摘要:TCP三次握手和四次挥手是网络通信的基础,但仅能回答面试问题并不代表真正理解。本文通过抓包分析详细拆解每个状态的含义,重点解析了TIME_WAIT和CLOSE_WAIT这两个生产环境常见问题。TIME_WAIT出现在主动关闭方,用于确保可靠关闭;CLOSE_WAIT堆积则通常表明程序未正确关闭连接。文章还澄清了常见误区,如tcp_tw_recycle已被弃用的原因,并提供了实际排查方法和优化

摘要: 服务器带宽100M但传输速度仅30M,排查发现是Linux默认的CUBIC TCP拥塞控制算法在高延迟场景下效率低下。切换为Google开发的BBR算法后,速度提升至99.5M。BBR通过测量带宽和延迟动态调整速率,相比依赖丢包判断的CUBIC,在高延迟(>20ms)和跨网传输场景下性能提升显著(2-5倍)。切换方法:加载BBR模块并修改内核参数,建议配合fq队列调度器使用。注意:内网低延