简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

快速将docker容器转移到其他服务器上 docker提供了可独立于宿主机的容器,通常单独为一个项目创建一个容器并在内部进行独立地进行环境配置。在某些场景下,需要将当前服务器的某一个docker容器转移到另一个linux服务器。因此,经过尝试,总结了一套相对比较容易的方案。首先,确保当前服务器与目标服务器是可连通的,即可通过ssh访问;在本机,将当前的容器提交为一个镜像,执行:sudo dock

强化学习(七):n步自举法(多步引导法) 在之前,我们知道求解有限马尔可夫决策过程可以通过蒙特卡洛和时序差分来通过与环境多次交互从经验中学习,然而,蒙特卡洛方法在一些不满足分幕式任务或连续型任务上无法获得最终的收益,因此我们引入时序差分方法。时序差分的思想就是将下一时刻的状态价值或下一时刻的状态动作价值作为估计值,用于估计当前状态价值或动作价值。时序差分是一种结合采样和自举的方法,那么一种介于.

强化学习(一):概述前言: 最近,强化学习非常的火爆,不论在科研界还是工业界,强化学习一直作为一个新兴的领域,在计算机学科范畴内发挥重要的作用。强化学习(Reinforcement Learning),属于一种机器学习架构(范式)。我们知道机器学习一般分为监督和无监督,所谓监督即是否有外在的标准来约束样本,也就是所谓的标签;无监督则是没有标签的样本。强化学习之所以认为是机器学习的一种架构,是..

强化学习(五):蒙特卡洛采样方法 在强化学习(四)中,我们学习了如何使用动态规划法求解强化学习问题,我们还学习了策略评估和策略改进,以及广义策略迭代(GPI),事实上,动态规划能够很好地收敛到最优值,但是否动态规划就是最好的呢?显然不是。回顾一下动态规划的状态价值函数的贝尔曼方程:vk+1(s)=∑aπ(a∣s)∑s′,rp(s′,r∣s,a)[r+γvk(s′)]v_{k+1}(s)=\...

强化学习(六):时序差分方法 时序差分(TD)方法结合了动态规划与蒙特卡洛的思想,其可以像蒙特卡洛方法一样直接从智能体与环境互动的经验中学习,而不需要知道环境的模型,其又可以像动态规划一样无须等待交互的结果,可以边交互边学习。总的来说,时序差分是基于已得到的其他状态的估计值来更新当前状态的价值函数。如果没有学习动态规划部分,可以浏览博文强化学习(四):基于表格型动态规划算法的强化学习,如果没有.

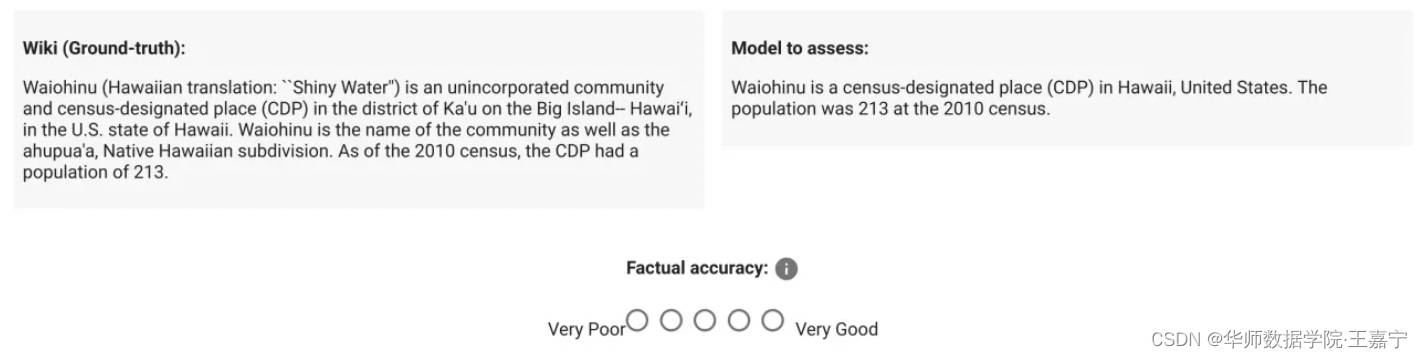

在本篇文章中,我们首先通过一篇早期工作讨论了忠实度和真实度的含义是什么。然后,我们综述了评估文本摘要忠实度/真实度/一致性的各种方法。可以看到不管是对于不同任务还是不同评价维度,较为普遍的趋势是趋向于大而统一:更大的元评估实验设定、更多的预训练、更大的模型、更统一的视角,等等等等。当下,GPT-4的出色表现引起热议,但是似乎构建更可控、可解释、鲁棒的文本生成指标仍然是一个开放问题,还有很长的路要走

强化学习(二):贪心策略(ε-greedy & UCB)夏栀的博客——王嘉宁的个人网站 正式上线,欢迎访问和关注:http://www.wjn1996.cn 强化学习是当前人工智能比较火爆的研究内容,作为机器学习的一大分支,强化学习主要目标是让智能体学习如何在给定的一个环境状态下做出合适的决策。强化学习相关概念请点击:强化学习(一):概述 强化学习任务中有两个非常重要的概念—...

论文解读:Dialogue Generation: From Imitation Learning to Inverse Reinforcement Learning 对话生成是一个常见的自然语言处理任务,其在工业界广泛应用与智能客服,闲聊机器人等。现如今主要研究于如何提高对话的质量,多样性。本文则采用先进的技术试图解决这个问题。一、简要信息序号属性值1模型名称DG-AIRL2所属领域自然语言处

目标检测经典论文集锦 目标检测目前有 one-stage 和 two-stage 两种,two-stage 指的是检测算法需要分两步完成,首先需要获取候选区域,然后进行分类,比如R-CNN系列;与之相对的是 one-stage 检测,可以理解为一步到位,不需要单独寻找候选区域,典型的有SSD/YOLO。 本文为结合相关参考博客以及原始论文进行的整理总结,相关参考引用详见文末。一、two-sta

强化学习(八):Dyna架构与蒙特卡洛树搜索MCTS 在基于表格型强化学习方法中,比较常见的方法有动态规划法、蒙特卡洛法,时序差分法,多步引导法等。其中动态规划法是一种基于模型的方法(Model-based),因为它的前提是必须要知道所有状态和动作以及奖励的分布;后面的几种方法则是基于采样的方法,试图让智能体通过与环境交互来获得经验,从经验中推出相关的策略。因此本节对相关内容进行一个简单的总结.