简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AI 编程范式的变化,最终会落在一个很具体的问题上:当 Agent 越来越能干,人应该做什么?这是我做 Mexus 的出发点,也是我现在对这件事的理解:人的工作重心会自然地往上移,从亲自执行,到判断方向、做关键决策;从逐行写代码,到定义目标、验收产物;从参与每一步实现,到定义什么值得被生产。对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领

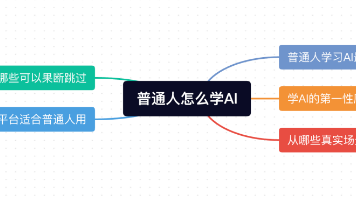

很多人焦虑 AI 的到来,是因为看不到明确的路径。换视角AI不是“技术”,而是“工具”。你不是要研究它,而是要让它为你打工。看场景不是学会它的所有功能,而是找到能立刻用起来的场景。走轻量路线不卷底层,不学开发,先通过提示词和模版,用出第一个能帮你省时赚钱的应用。AI 不是专家专属,它是这个时代“普通人上升的最短路径”。学会用AI,就像给自己装了一块外挂显卡,一路开挂升级。说了这么多,不如现在就动手

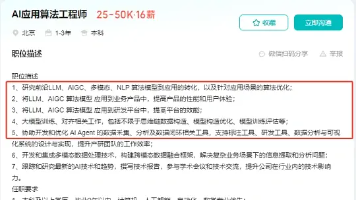

6个月,说长不长,说短不短。零基础转型LLM开发工程师,没有捷径可走,靠的是每天2-3小时的专注投入,靠的是遇到问题不放弃的坚持,靠的是聚焦核心技能、不盲目跟风的理性。现在,AI红利还在持续,LLM开发工程师的需求还在不断增长,只要你愿意迈出第一步,按照这份规划稳步推进,6个月后,你也能摆脱零基础的标签,拿到高薪offer,抓住属于自己的AI时代红利。记住:AI时代,最可怕的不是“你不会”,而是“

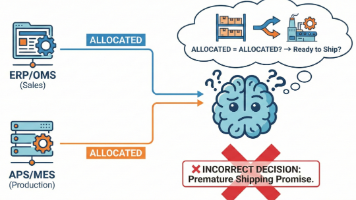

对比维度普通函数调用Agent 工具调用调用时机编译时确定,代码写死运行时决策,LLM 推理参数来源程序员指定,硬编码LLM 从自然语言提取错误处理抛异常,静态处理逻辑返回错误给 LLM,自主恢复调用链确定,可预测不确定,依赖推理性能开销纳秒级秒级(含 LLM 推理)可调试性高,可单步跟踪低,需观察推理日志适用场景确定性任务,性能敏感开放性任务,需要灵活决策普通函数调用 vs Agent 工具调用

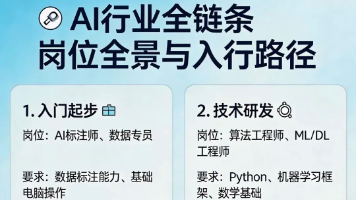

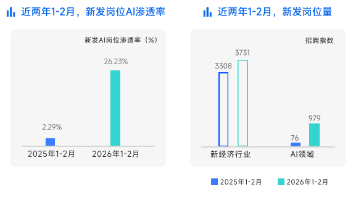

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

2026年的职场,AI不是“风口”,而是“常态”。岗位暴增、企业倒逼,不管你是想求职踩风口,还是想保住现有工作、实现进阶,学习AI相关能力都很有必要。对于小白来说,不用怕没基础,AI大模型训练师就是低门槛切入点,从零开始学,也能快速拿到高薪;对于程序员来说,AI大模型应用开发工程师,能帮你突破职业瓶颈,实现技能升级和薪资翻倍。不用追求“精通”,只要能掌握核心能力,就能在这场AI人才争夺战中,拿到属

带来的直接收益是:减少误解与幻觉:统一概念与关系、支撑复杂推理与多跳查询、提升协作与治理(可解释可审计)能力。

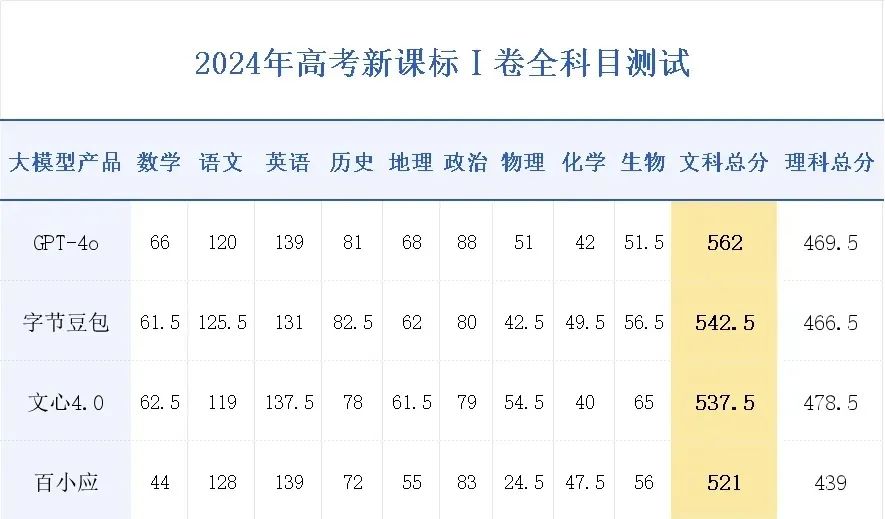

什么?好多大模型的文科成绩,还是最卷的???

我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。作为普通人,入局大模型时代需要持续学习和实践,不断提高

下面以使用 Qwen3-4B 模型配置 PyTorch backend 为例,描述如何快捷进行基准测试以及服务化的工作。采用类似的步骤,也可以实现 Qwen3 其他 Dense 和 MoE 模型的推理部署优化。