简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

我们要把 AI 大模型当做人的大脑,因此调用 AI 大模型,相当于调用一个人,把 AI 大模型当人看,TA 懂人话、TA 说人话、TA 会直接给出结果,但结果不一定正确。因此在 AI 大模型的推理基础上,通过 RAG、Agent、知识库、向量数据库、知识图谱等技术手段实现了真正的 AGI(通用人工智能)。这些技术到底有哪些区别和联系,下图作了横向对比,接下来我们详细剖析下。

2025 年注定是 Agent 爆发之年,但是在 2024 年竞争最激烈的非编程助手莫属,从 Github Copilot 到 Cursor 再到 WindSurf,程序员是最热衷于使用智能体的群体。但是以上产品需要联网,需要付费,或者即使免费也有额度的限制,我们国内也有很多产品,不仅免费,而且有些产品是开源的。今天就以智谱 AI 的 CodeGeex4 为例,搭建一个离线本地的编程助手,整体体验

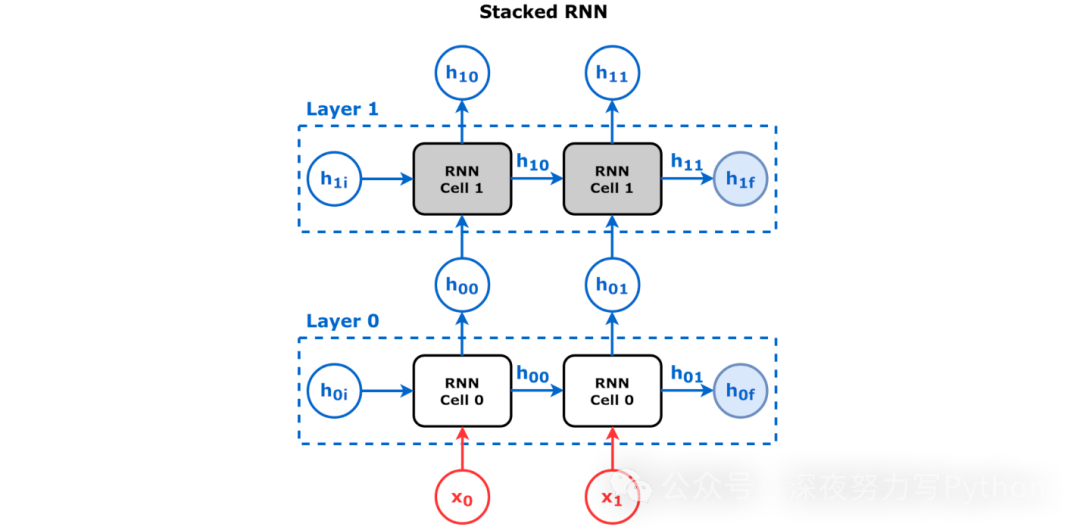

深度学习序列模型方面,我们熟知的必须是 RNN 和 Transformer,今天想和大家聊聊 RNN 和 Transformer,并且探讨它们的区别和联系,让大家对这两种算法模型有一个更加熟悉的理解。首先来说,RNN 和 Transformer 都是深度学习中的序列模型,用来处理序列数据,但它们的结构和工作方式有所不同。大概就是,RNN适用于较短的序列任务,但效率相对低;Transformer能高

Hello,大家好。最近,随着Flux模型的开源,越来越多的小伙伴加入了AI画图行列,都立志成为下一位“梵高”。不过呢,很多小伙伴在创作的途径中会灵感枯竭,摆着以往,一般都会上一些素材网站看看别人的作品,对吧!?可是,现在是2024年了,当你没了灵感肯定找人工智能呀。那么,今天就来分享一下如何不借助大厂的AI,用开源的大语言模型(LLM)来制作一个随时给你灵感的AI机器人。

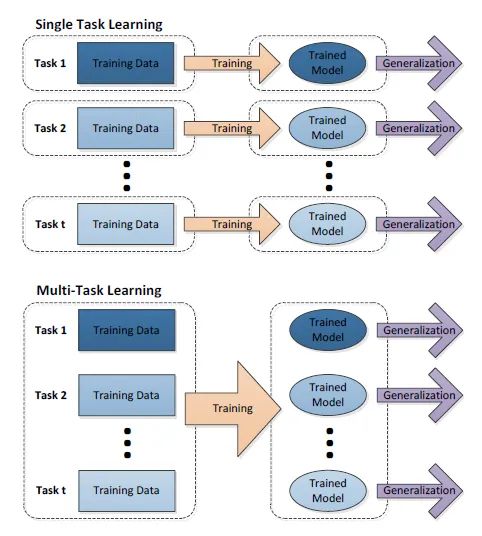

写在前面这是NLP保姆级教程的第二篇----基于RNN的文本分类实现(Text RNN)参考的的论文是来自2016年复旦大学IJCAI上的发表的关于循环神经网络在多任务文本分类上的应用:Recurrent Neural Network for Text Classification with Multi-Task Learning[1]

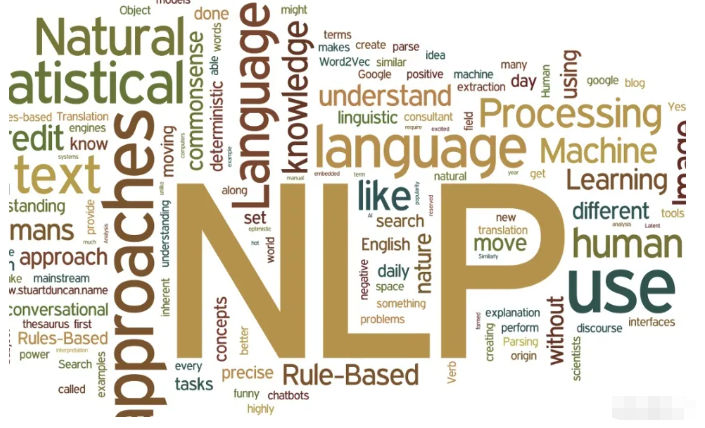

是一门研究人类语言与计算机之间交互的领域,旨在使计算机能够理解、解析、生成和处理自然语言。NLP结合了计算机科学、人工智能、语言学和认知科学等多个学科的知识,旨在构建能够理解和处理人类语言的智能系统。:这是NLP的核心任务之一,旨在使计算机能够理解人类语言的含义。语言理解的任务包括词法分析、句法分析、语义分析和语篇分析等。词法分析涉及将句子分解为单词或词组,句法分析涉及确定单词之间的语法关系,语义

2024年6月6日第29个全国爱眼日,中山大学中山眼科中心与华为技术有限公司携手合作、基于人工智能技术研究构建的,为守护人民群众眼健康开辟智慧化新路径。发布会上,国家卫生健康委规划司大数据办一级调研员沈剑峰介绍了人工智能助力智慧医院创新发展的典型案例与实践经验。广东省科技厅二级巡视员龚建文对于合作双方推动人工智能与医疗深度融合的创新应用成果给予了充分肯定和高度评价。华为高级副总裁邹志磊分享了“充分

在当前的人工智能浪潮中,大型预训练模型如盘古等,因其卓越的性能和广泛的应用前景而备受关注。然而,这些模型的部署并非易事,尤其是在个人电脑上。由于其庞大的参数量和计算需求,通常需要高性能的硬件支持。尽管如此,对于热衷于AI研究与实践的个人用户而言,了解如何在个人设备上部署这类大模型具有重要的学习价值。本文旨在探讨这一过程,为读者提供一个从理论到实践的指南,帮助大家理解大模型部署的基本原理,以及如何克

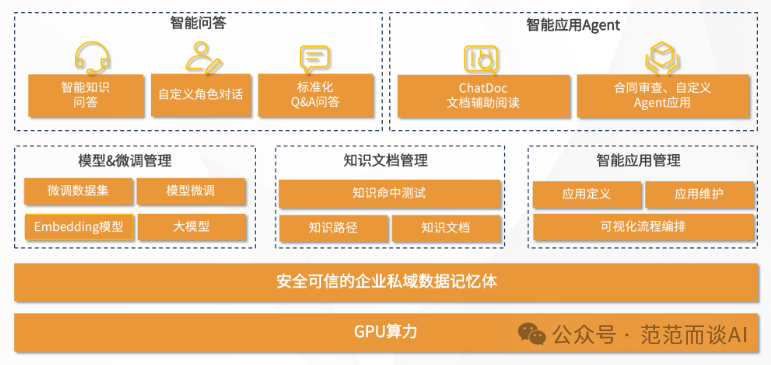

随着人工智能技术的飞速发展,大模型在企业知识管理中的应用日益广泛。下文是作者围绕如何基于大模型技术构建企业私有知识库,以提升企业的知识管理效率和创新能力的一些思考和简单实践。本文对企业知识库的落地场景暂不作广泛的展开,主要记录作者基于大模型构建企业私有知识库的一些技术实践。

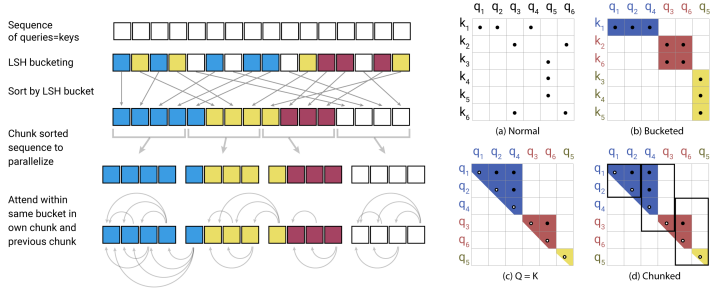

Transformer目前已经成为人工智能领域的主流模型,应用非常广泛。然而Transformer中注意力机制计算代价较高,随着序列长度的增加,这个计算量还会持续上升。为了解决这个问题,业内出现了许多Transformer的魔改工作,以优化Transformer的运行效率。我这次就给大家。文章主要涉及4个方向:稀疏注意力机制、Transformer处理长文本、Transformer运行提效以及卷积