简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

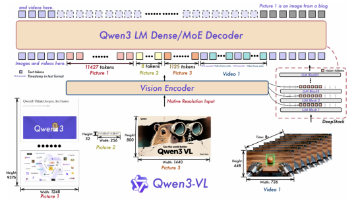

本文系统梳理了多模态大语言模型的演进历程,将其归纳为三条互补技术路线:CLIP模型通过对比学习建立跨模态表征空间;生成模型采用"组装+轻对齐"策略融合视觉与语言能力;Data Agent系统实现自监督迭代与智能体进化。从静态表征对齐到动态行为协同,多模态大模型正从"感知对齐"迈向"行为协同"与"自主进化",为通用人工智能在多模态世界中的落地奠定基础。

你这情况,绝对不是个例。现在整个后端圈子,尤其是干了五六年往上的,基本都你这心态:往前一步是 P7/架构师,感觉自己火候差点意思,项目里也没那么多复杂场景给你练手;原地踏步吧,又看着一波波新人卷生卷死,心里发慌。想转 AI,发现水又深又混,网上的教程十个有九个是“从入门到放弃”,还有一个是“从入门到调包”。

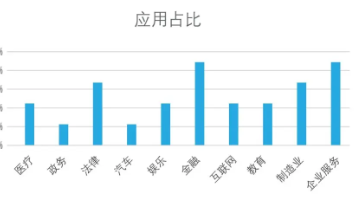

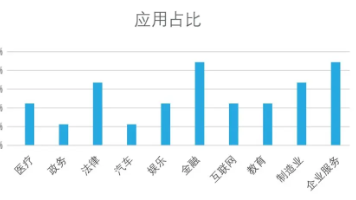

本期给大家分享的是利用AI 做副业的一些方法,大家可以挑选适合自己的赛道去搞钱现在是人工智能时代,利用好AI 工具,可以降低普通人做副业的门槛,同时也能提高工作效率, 因此AI 赚钱的副业还是挺多的,今天拿20个普通人也能尝试的AI搞钱副业分享给大家 ,包括每个副业的名称、做法以及案例。这些副业的案例和做法亲测有效,并且提出了一些建议来加强和改进这些副业。1.副业创业】AI+剧本项目:AI技术接手

在人工智能领域,“大模型”和“大语言模型”这两个词经常被提及,很多人甚至把它们当成了同义词。其实,这两者之间存在本质的区别。今天,我就带你深入剖析什么是大模型,什么是大语言模型(LLM),它们的区别在哪里,以及如何利用这些模型提升你的项目效率。文章干货满满,适合AI爱好者、开发者和企业决策者阅读!🚀

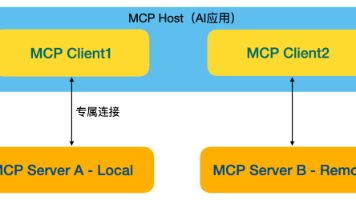

MCP(Model Context Protocol)是AI应用连接外部数据源和工具的标准接口,类似AI应用的"TypeC接口"。本文详细解析了MCP的架构设计(Client-Server)、三种基本类型(Tools、Resources、Prompts)以及传输协议(JSON-RPC 2.0,支持Stdio和Streamable HTTP)。MCP与Function Calling的区别、安全机制

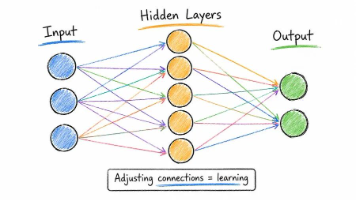

本文以通俗易懂的方式解释了AI大模型的基本原理和工作方式,涵盖了神经网络、分词、嵌入、注意力机制、Transformer架构、LLM训练、上下文窗口、温度调节、幻觉问题、提示词工程等20个关键概念。文章详细介绍了AI模型如何通过迁移学习和微调变得专业,以及RLHF和LoRA等技术如何提升模型性能和效率。此外,还探讨了RAG、向量数据库、AI智能体、思维链和扩散模型等实际应用场景,帮助读者全面理解A

本文介绍了MCP(模型上下文协议)的概念及其重要性,解释了MCP如何作为AI连接外部软件的通用插座和沟通规则。文章详细阐述了MCP中的七个关键术语:MCP、协议、服务器、客户端、工具、连接器、权限,并说明了它们如何协同工作以实现AI与外部软件的稳定连接。通过这些解释,文章强调了MCP在使AI应用连接外部能力时的标准化和可管理性,以及在实际应用中需要注意的关键问题,如工具的边界、权限控制等。

本文介绍了MCP(模型上下文协议)的概念及其重要性,解释了MCP如何作为AI连接外部软件的通用插座和沟通规则。文章详细阐述了MCP中的七个关键术语:MCP、协议、服务器、客户端、工具、连接器、权限,并说明了它们如何协同工作以实现AI与外部软件的稳定连接。通过这些解释,文章强调了MCP在使AI应用连接外部能力时的标准化和可管理性,以及在实际应用中需要注意的关键问题,如工具的边界、权限控制等。

本文系统梳理了检索增强生成(RAG)技术的主流路线,从基础分块(如Simple RAG、语义感知切块)到进阶增强(如Hierarchical RAG、Self-RAG),再到前沿探索(如跨模态RAG、Agent-RAG),详细解读了各方案的核心思路、实现难度与应用场景。文章强调根据知识库规模和需求选择合适的技术路线,并提供方案选型参考,旨在帮助开发者快速理解和应用RAG技术,提升大模型问答系统的性

本文介绍了9种RAG(检索增强生成)架构,从基础到高级,帮助开发者构建可靠的生产级AI系统。内容涵盖标准RAG、对话式RAG、纠正性RAG、自适应RAG、自反RAG、融合RAG、HyDE、智能体RAG和图RAG,每种架构都有详细的工作原理、优缺点和实际案例。文章强调从标准RAG开始,根据实际需求逐步增加复杂性,并提供了一个决策框架来帮助开发者选择合适的架构。最后,文章还列出了杀死项目的红旗,提醒开