简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

一、内容Simpleaudio:支持numpy数组播放sounddevice 和 soundfile:支持播放和录制包含音频信号的 NumPy 数组pydub:必须预先安装至少一个来自(simpleaudio、pyaudio、ffplay 和 avplay)的音频播放包。可以查看音频信息(时长,分贝)pyaudio 和 wave:录制和连续音频流二、pyaudio录音和播放。三、pydub调整音量

网上有很多报错的是因为Host文件 或者 Setting.xml配置问题导致,这里是因为Java版本与Maven版本不匹配的问题Maven – Maven Releases History官方文档查看Java 8可以兼容Java 7 对应Maven,但Java17会出错。在更换阿里镜像后,Indexed Maven Repositories 进行Update时出现Error提示不需要下载索引仓库的

Knox方法基于临界空间和时间距离量化时空相互作用。测试统计量X是那些相距小于临界空间和时间距离的案例对的计数。当存在交互时,成对的案例将彼此接近,并且测试统计将很大。Knox设计了这种方法来考虑潜伏期。潜伏期是从暴露到症状出现之间的时间。如果你怀疑一种潜伏期为3天的疾病,将时间临界距离设置得足够长,以允许症状出现,比如4天或5天。ST-DBSCAN 以地理位置距离作为半径,时间范围作为高,在空间

边缘计算着重要解决的问题,是传统云计算(或者说是中央计算)模式下存在的高延迟、网络不稳定和低带宽问题。边缘计算起源于广域网内搭建虚拟网络的需求,运营商们需要一个简单的、类似于云计算的管理平台,于是微缩板的云计算管理平台开始进入了市场,从这一点来看,边缘计算其实是脱胎于云计算的。)的不断发展,人们发现这一平台有着管理成千上万边缘节点的能力,且能满足多样化的场景需求,经过不同厂商对这一平台不断改良,并

Project Gradient Descent(PGD)是一种迭代攻击算法,相比于普通的FGM 仅做一次迭代,PGD是做多次迭代,每次走一小步,每次迭代都会将扰动投射到规定范围内。在保存模型或者评估模型时,会利用影子权重进行评估,如果效果比当前效果好,则保存影子权重的参数,但是之后在继续训练的时候会还原之前的参数进行训练。双向的LSTM后面接softmax,但此时输出标签之间是没有关系的,加了C

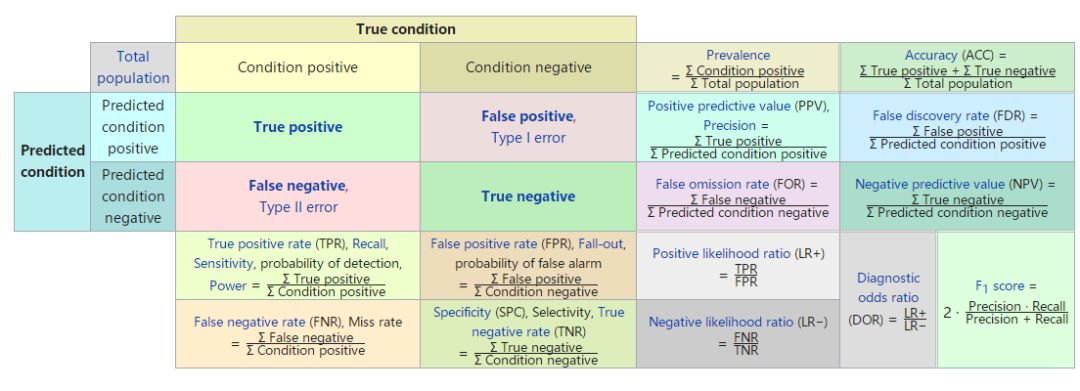

Ⅰ. 分类问题常用精度 Accuracy混淆矩阵查准率(准确率)查全率(召回率)PR曲线与AP、mAPF值ROC曲线与AUC值Ⅱ. 回归拟合R2决定系数平均绝对误差(MAE mean absolute error)均方误差(MSE mean squared error)均方根误差(RMSE root mean squared error)Ⅲ. 聚类模型评估1. 簇内误差平方和SSE....

推荐模型如何进行推荐将取决于您拥有的数据类型。如果您只拥有过去发生的交互数据,您可能有兴趣使用协作过滤。如果您有描述用户及其与之交互过的物品的数据(例如,用户的年龄、餐厅的菜系、电影的平均评价),您可以通过添加内容和上下文过滤,对当前给定这些属性下新交互的可能性进行建模。推荐系统中最为主流与经典的技术之一是(Collaborative Filtering),它是基于这样的假设:用户如果在过去对某些

异常检测实际案例:网络安全中的攻击检测,金融交易欺诈检测,疾病侦测,和噪声数据过滤等。时间序列的异常又分为点异常和模式异常。对于一个新观测值进行判断:离群点检测: 训练数据包含离群点,即远离其它内围点。离群点检测估计器会尝试拟合出训练数据中内围点聚集的区域, 会忽略有偏离的观测值。新奇点检测: 训练数据未被离群点污染,我们对新观测值是否为离群点感兴趣。在这个语境下,离群点被认为是新奇点。离群点检测

将假的和真的数据都给判别器,优化判别模型。然后训练生成器,具体做法就是固定判别器的参数,通过反向传播优化生成器的参数,希望它得到数据在经过判别器后结果尽可能地接近1,这时只需要通过调整损失函数就可以了。可以自己去构造隐藏向量,生成任意图片,只需要给它一个标准正态分布的随机隐含向量,通过解码器就能够生成想要的图片,而不需要给它一个原始的图片。到一个编码,再通过一个神经网络去解码得到一个与输入原始数据