简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

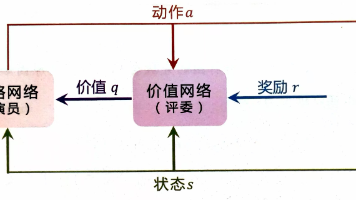

但是二者训练方法类似,都可以用n-step TD算法来更新网络参数。4. 用奖励执行TD算法更新Critic network的参数。Critic network和DQN完全不同。2. 根据现有策略做决策的随机采样,得决策。5. 将Critic network的输出。更新actor network的参数。上图来自王树森老师的《深度强化学习》

虽然我这里使用CMake,但是它只是一个用于编译生成可执行文件的工具,完全不影响将工具换成g++,gcc等,这套配置是完全通用的右上角一键编译运行的内部流程task.json格式概述launch.json格式概述CMake格式概述攒起来,组合成通用开发环境举例},},task.json中,在方括号中的,每一组用{ }括起来“东西”,都是一个task,也是这个文件真正要去执行的事。

创建一个符合Gymnasium规范的env类,继承自gym.Env,在构造函数中实现:p.connect()连接到pybullet,设置物理参数:重力方向、大小、仿真步长加载地面加载robot的URDF,并设置初始位置和方向定义 action_space和observation_space,设置随机种子至少实现方法observation / reward / reset / step在 reset

Adam算法结合了动量法(Momentum)和RMSProp的思想,能够自适应调整每个参数的学习率。通过动态调整每个参数的学习率,在非平稳目标(如深度神经网络的损失函数)中表现优异。

基于MXNet框架的softmax图像分类从零实现

上述提到的变量uwTickFreq(值来自宏HAL_TICK_FREQ_1KHZ==1),即让SysTick每1ms溢出一次。各种算法需要的采样时间、外设模块需要的延时时间、测试所需的延时时间等,都可以使用SysTick。我们也可以直接调用SysTick->LOAD和SysTick->VAL,来。使滴答定时器正好1s把SystemCoreClock计完,然后溢出。HAL_Delay()函数会调用滴

Adam算法结合了动量法(Momentum)和RMSProp的思想,能够自适应调整每个参数的学习率。通过动态调整每个参数的学习率,在非平稳目标(如深度神经网络的损失函数)中表现优异。

我的其他两篇博客,分别介绍了外推法和内推法,本文将二者汇总起来,形成可复用的算法参考自craig的《机器人学导论》

我的其他两篇博客,分别介绍了外推法和内推法,本文将二者汇总起来,形成可复用的算法参考自craig的《机器人学导论》

借鉴Craig 的《机器人学导论》第六章(动力学)牛顿-欧拉(Newton-Euler)内推法本文主要是为了梳理一下那个又长角标又多的内推公式到底在做什么。