简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在添加车厢页面,选择所属车次,填写车厢编号、车厢类型、载重能力、状态等信息,点击“添加”按钮,系统将车厢信息保存到数据库中,并跳转到铁路运输资源列表页面。在添加车厢页面,选择所属车次,填写车厢编号、车厢类型、载重能力、状态等信息,点击“添加”按钮,系统将车厢信息保存到数据库中,并跳转到铁路运输资源列表页面。在添加用户页面,填写用户名、密码、角色等信息,点击“添加”按钮,系统将验证用户名是否已存在,

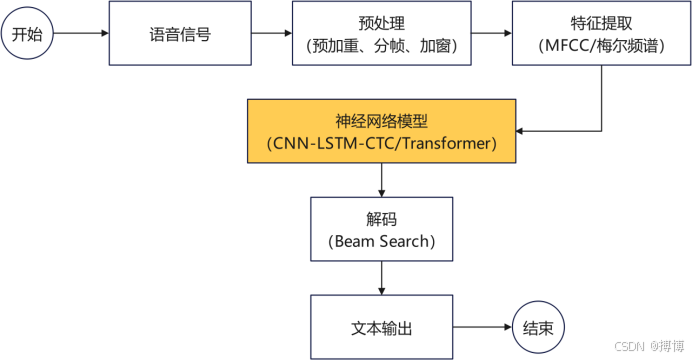

从实验室的算法验证到工业界的大规模部署,从单一模态识别到多模态融合分析,这一领域的进步不仅推动着人工智能的实用化,更深刻改变着人类与机器交互的方式 —— 让机器“看懂”“听懂”世界,最终实现更智能的人机协同。通过一阶高通滤波器(公式:y(t) = x(t) - αx(t-1),α通常取0.97)增强高频分量,弥补声音传播中的高频衰减,提升辅音等高频信息的区分度。其中 x_i^a 为锚样本,x_i^

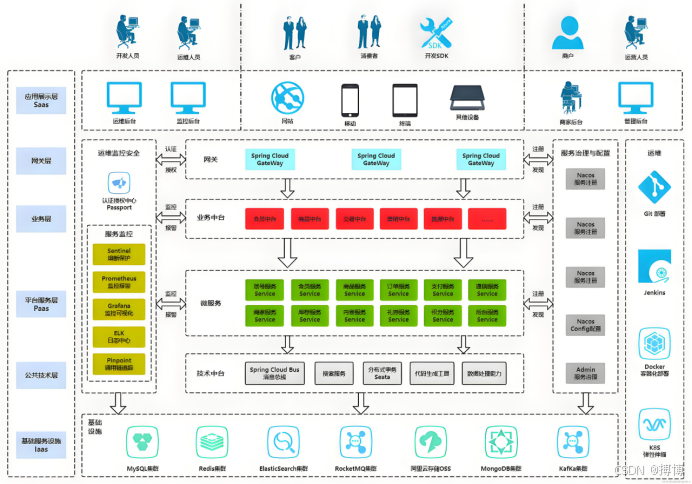

软件危机的本质是软件的复杂性与人类认知能力、工程方法的滞后性之间的矛盾。未来,随着人工智能、区块链等新技术的融入,软件工程将进一步与DevOps、低代码开发、形式化验证等深度结合,推动软件产业向更高效、更可靠的方向演进。软件工程是将工程原理应用于软件的开发、运行和维护,以系统化、规范化、数量化的方法解决软件危机,目标是在合理的时间和成本范围内交付高质量的软件产品。:某银行开发新一代核心系统,处理账

为了更好的比较五种方法的区别,统一案例为手写数字识别,预处理数据,分别实现五种方法。本文对五种机器学习方法进行深度比较,并在同一个案例下区分它们,这里选择手写数字识别作为案例,因为它直观且适合多种方法演示,再用Python代码实现。:通过统计学习像素模式,能泛化未见过的图像,准确率随数据量和模型复杂度提升(如 CNN 可到 99%)。(如清晰的 0),泛化能力差,需完善领域理论(如添加更多数字的几

这种学习方式如同学生在教师的明确指导下学习,训练数据中的标签(如分类类别、回归目标值)相当于教师提供的“标准答案”,模型通过分析这些“例题”与“答案”的对应关系,掌握解决问题的能力。指导式学习作为机器学习的基石,其理论和方法将持续演进,与无监督学习、强化学习深度融合,推动人工智能从“有监督的专项智能”向“自主学习的通用智能”迈进。4)数据集划分:将数据分为训练集(80%)、验证集(10%)、测试集

梯度爆炸问题对神经网络训练的影响是显著的。当梯度爆炸发生时,网络的权重更新可能会变得异常大,导致网络的参数值迅速膨胀。梯度爆炸问题通常发生在深度神经网络中,是深度神经网络的结构和训练过程中的一些固有特性,特别是当网络的层数较多、网络结构复杂时,或者使用了不合适的激活函数、初始化方法或优化算法时,随着网络层数的增加,梯度爆炸(Gradient Explosion)是神经网络训练过程中常见的一个问题,

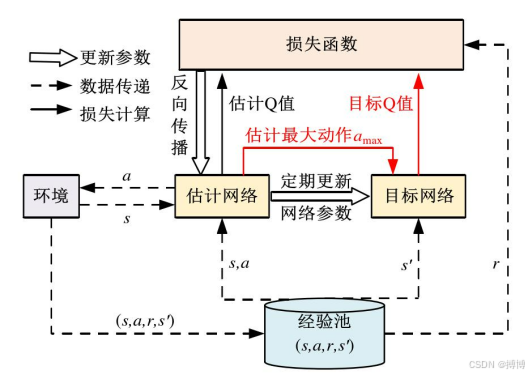

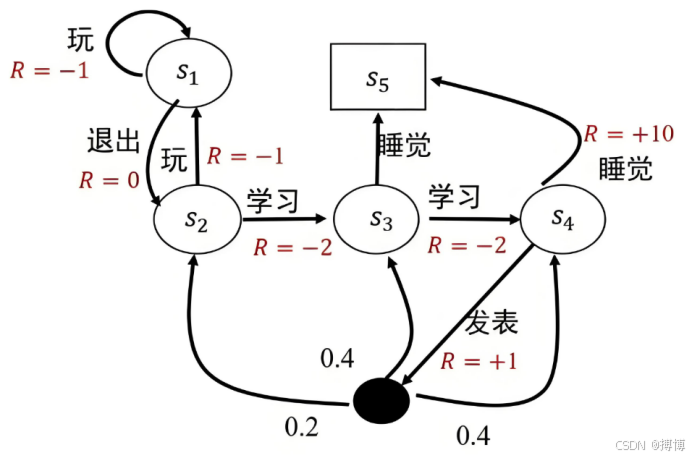

马尔可夫决策过程(MDP)是强化学习的数学框架,由五元组〈S, A, P, R, γ〉定义:其中S是所有可能状态的集合(状态空间),A是智能体可执行动作的集合(动作空间),P是状态转移概率函数(表示在状态s执行动作a后转移到状态s'的概率,即P(s'|s,a)),R是奖励函数(给出在状态s执行动作a并转移到状态s'后获得的即时奖励,即R(s,a,s')),γ是折扣因子(取值范围0≤γ<1,用于权衡

Python的GUI库生态系统提供了多样化的选择,从简单的标准库到功能强大的第三方框架。对于大多数情况,PyQt5 和 Tkinter 是最常用的选择,前者适合复杂应用,后者适合快速原型。随着 Web 技术的发展,Web 集成方案(如 Remi)也逐渐受到关注,成为跨平台开发的新选择。python有哪些GUI库,分别是什么,各自有什么特点和具体的应用场景,以及各个库的主要组成结构是什么?Pytho

例如,在机器人控制中,先在仿真环境中训练PPO模型,再通过域随机化(Domain Randomization)迁移到真实环境。理论上,当ϵ较小时,PPO的截断操作近似于TRPO的信任区域约束,但计算复杂度显著降低。(因策略更新需保证数据来自相近策略),而是将每个周期收集的轨迹分割为多个小批量(Mini-Batch),在每个小批量上进行多次更新,以模拟SGD的效果,减少内存占用。替代TRPO的信任区

特别的,在分类任务中,全连接层的输出结果通过softmax激活函数映射为各个类别的得分或概率,通过比较不同类别的得分或概率,可以实现分类决策。全连接层中的每个连接都对应一个权重参数,由于全连接层的参数数量很大,因此在实际应用中,通常会采用一些方法(如反向传播算法)来优化和学习这些参数。卷积神经网络(CNN)中的全连接层(Fully Connected Layer,FC层)是神经网络的一种基本层结构