简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

来源| 腾讯科技ID |qqtech2023年6月9日的北京智源大会上开幕式上,机器学习三巨头之一杨立昆(Yann Lecun)进行了远程致辞,发表了名为《朝向能学习, 思考和计划的机器进发》( Towards Machines that can Learn, Reason, and Plan)的演讲。作为一个从ChatGPT诞生之日起就对它嘲讽连连,认为它没有什么新意。在今天的讲座中,身处凌晨4

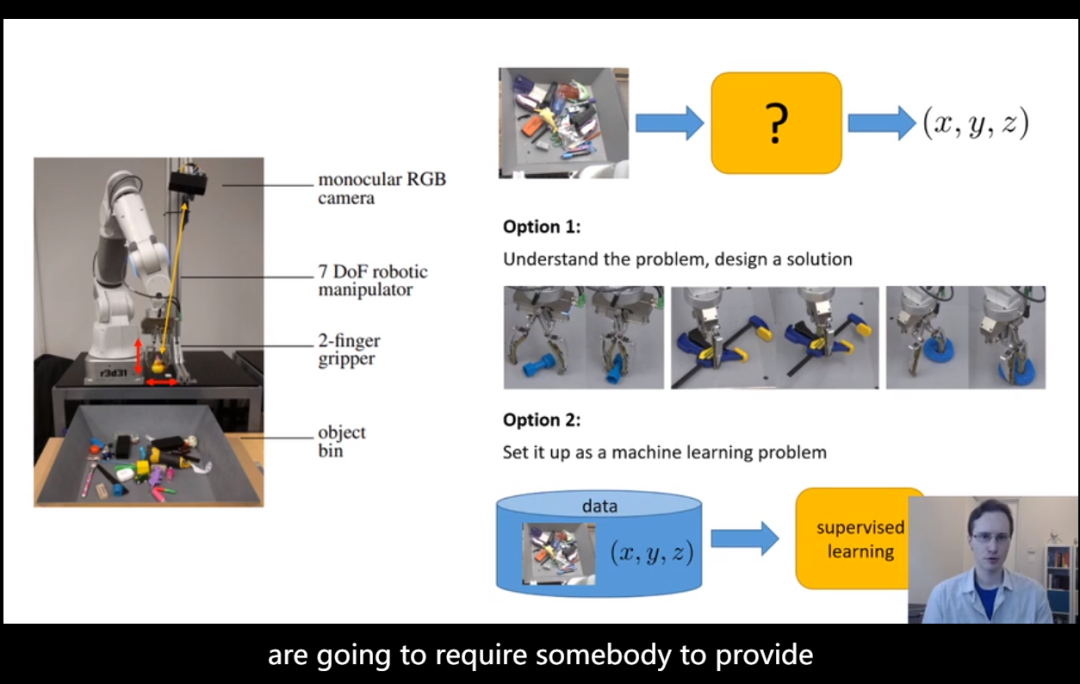

MIT最近放出了一套关于深度学习与自动驾驶应用的课程,主讲人Lex Fridman,MIT的一名博士后,主要半自动驾驶、场景感知、运动控制和规划等方向。这门课程介绍了深度学习相关知识,以自动驾驶为载体,详细介绍了深度学习技术在自动驾驶中的应用。非常适合初学者学习,课程主要面向那些刚接触机器学习、自动驾驶、深度学习的人,但同时也适用于深度学习、自动驾驶领域的高级研究人员,帮助学习者够深入了解

https://basicmi.github.io/Deep-Learning-Processor-List/获取更多深度学习最新资讯快速通道:获取最新消息快速通道- lqfarmer的博客 - CSDN博客Nvidia公司GPU· Nvidia的最新版GPU可以使用其最新的Tensor核心架构,即16位TF或120TFlops,这是

之前给介绍了牛逼的CNN(ConvolutionalNeural Network)和深度学习加速神器BNN(Binarizedneural network),感兴趣的同学可以添加微信公众号“深度学习与NLP”,回复关键词“CNN”或“BNN”获取对应文章链接。今天给大家介绍深度学习模型中最淘气的模型:在游戏中学习的对偶学习(duallearning)。对偶学习之发表在去年的NIP

最近在整理深度学习中用到的算法、常见的模型和优化技巧,于是,决定整理成一个深度学习模型和一个深度学习优化算法单元,大家一起学习,有什么问题可以在微信群里讨论,同时也热烈欢迎大家加入微信群“深度学习与NLP”,入群方式可以看公众号右下角。下面给出模型单元的目录:1、CNN:ConvolutionalNeural Network2、GAN:GenerativeAdversa

来源 | 量子位ID | QbitAI与传统的MLP架构截然不同,且能用更少的参数在数学、物理问题上取得更高精度。比如,200个参数的KANs,就能复现DeepMind用30万参数的MLPs发现数学定理研究。不仅准确性更高,并且还发现了新的公式。要知道后者可是登上Nature封面的研究啊~在函数拟合、偏微分方程求解,甚至处理凝聚态物理方面的任务都比MLP效果要好。而在大模型问题的解决上,KAN天然

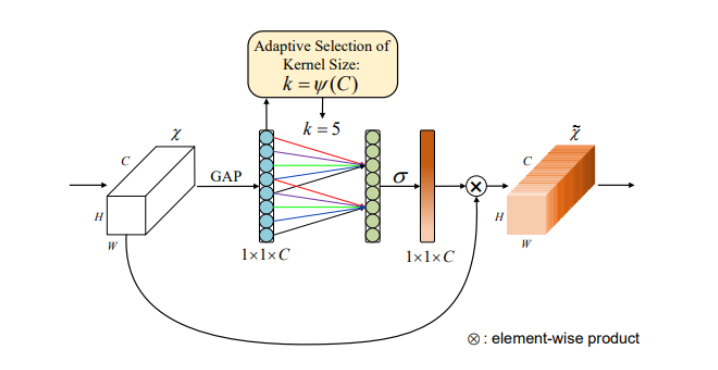

最近在读论文的时候会发现一个问题,有时候论文核心思想非常简单,核心代码可能也就十几行。但是打开作者release的源码时,却发现提出的模块嵌入到分类、检测、分割等代码框架中,导致代码比较冗余,对于特定任务框架不熟悉的我,很难找到核心代码,导致在论文和网络思想的理解上会有一定困难。因此,作为【论文复现项目】的补充,本项目的宗旨也是让世界上没有难读的论文。

本文整理了图神经网络模型(Graph Neural Network,GNN)在自然语言处理领域的各个任务中使用的一些论文。涉及GNN在文本分类、信息抽取、问答、可视化问答、文本生成、知识图谱和文本错误检测相关的应用;还整理了自然语言各个顶会ACL、EMNLP、KDD、NAACL中GNN应用于NLP的一些论文。本资源整理自网络,源地址:https://github.com/I...

推荐一门由深度学习泰斗,Yann LeCun主讲的深度学习基础课程,纽约大学2020深度学习新课-《深度学习(pytorch)》。本课程涉及深度学习和表示学习的最新技术,重点讲解有监督和无监督学习相关的深度学习技术和模型,涉及embedding向量化方法,度metric学习,卷积和递归网络等等,并应用于计算机视觉,自然语言理解和语音识别等领域。期望学生最好有一定的数据...

课程介绍本课程主要讲解深度强化学习相关的基础知识,基础模型;还设计迁移学习、多任务学习和元学习。bjhq:Sergey Levine-伯克利《深度强化学习2020》课程视频及ppt分享课程主页http://rail.eecs.berkeley.edu/deeprlcourse/课程大纲课程主讲人课程视频截图bkhq:Sergey Levine-伯克利《深度强化学习2020》课程视频及ppt分享..