简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了AI智能体开发三个层次的核心工具:LangChain作为框架提供抽象能力,LangGraph作为运行时确保系统稳定性,DeepAgents作为工具集实现开箱即用。三者构成从底层到应用层的完整开发体系,帮助开发者从零构建到部署稳定AI智能体的全流程,代表了AI开发向成熟分层发展的趋势。。当然,目前在业界,这三个概念之间的界限尚不明确。框架、运行时以及工具集之间仍旧存在着模糊的区域和重叠部分

在人工智能技术加速渗透各行业的当下,不少Java开发工程师将目光投向AI领域。Java开发者深耕后端架构、软件工程全流程(需求分析、系统设计、开发测试等)的经验是转型的重要基石,但AI工程更聚焦数据驱动的算法设计与模型落地,核心在于补足数学基础、工具链能力与领域知识的差距。多项行业调研显示,成功转型的关键在于系统性构建AI技能体系,而非零散学习工具。

收藏备用!6大主流AI智能体框架全解析,助你高效选型少踩坑

一图看懂Agentic AI:8层架构与5大等级, 打造下一代自主智能体系统

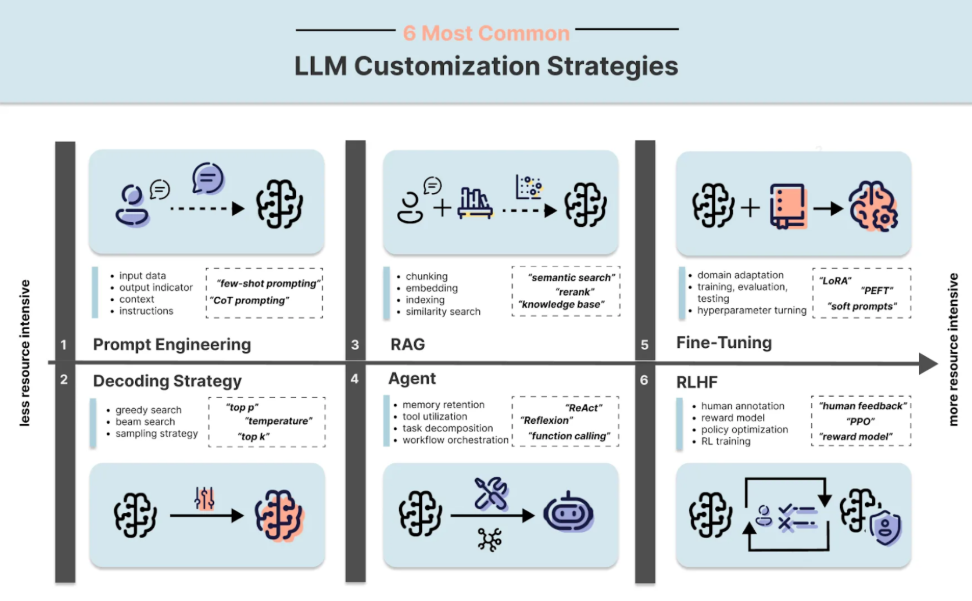

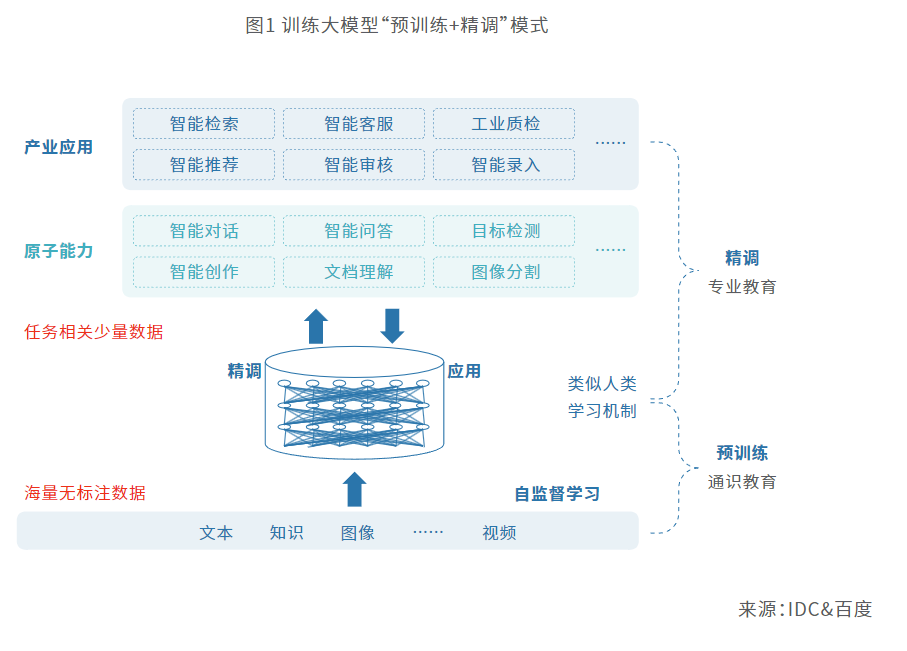

大语言模型(LLM)是基于自监督学习预训练的深度学习模型,训练数据量庞大、训练时间长,并且包含大量的参数。LLM在过去两年中彻底改变了自然语言处理领域,展现了在理解和生成类人文本方面的卓越能力。然而,这些通用模型的开箱即用性能并由于从零开始训练一个LLM模型需要大量的训练数据和资源,这对于中小型团队来说基本不可行。因此,近年来开发了多种LLM定制策略,以便针对需要专业知识的不同场景调优模型。

今天我们来讲述的是人工智能中最核心深度学习能力——大模型。大模型是人工智能领域的一种超大规模深度学习模型,它通过海量数据训练和千亿级参数实现对复杂信息的理解与创造。随着我们学习的深入,通过主角“大模型”的叙述,了解人工智能深度学习背后的故事。

AI大模型是“大数据+大算力+强算法”结合的产物,是一种能够利用大数据和神经网络来模拟人类思维和创造力的人工智能算法。它利用海量的数据和深度学习技术来理解、生成和预测新内容,通常情况下有数百亿乃至数万亿个参数,可以在不同的领域和任务中表现出智能。比如,可在各种场景中生成高质量的文本、图像和音视频等内容。

在人工智能生成内容(AIGC)迅速发展的今天,如何有效地与AI大模型沟通,让它们产出我们真正需要的内容,已经成为一项重要技能。而这项技能的核心,就是本文要深入探讨的"提示词工程"(Prompt Engineering)。

这段时间各种AI名词一波接一波的冲击着我的屏幕,Agent,MCP,FunctionCalling,RAG,它们都是什么东西有人说Agent是智能体,那智能体又是什么呢?有人说MCP是AI时代的USB协议,那么它可以接U盘吗?它们到底都是什么意思?

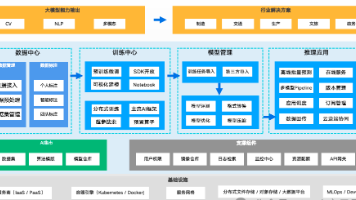

什么是大模型,相信每个人都能说上一个一二三点来。比如:OpenAI、ChatGPT、DeepSeek、豆包、Manus等。也知道大模型需要做训练与推理。但是如果稍微深入一点,可能就无法再回答上来。这篇文章,我从系统性角度来讲讲大模型。