简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

快速排序是一种高效的排序算法,适用于大规模数据的排序。通过优化基准选择策略,可以进一步提高其性能和稳定性。

【代码】Windows 11 安装 Dify 完整指南 非docker环境。

chat2db中这样设置,所以需要我自己写一个app.py 去做一下代理请求ollama,不是我不想写自定义,主要是总不成功。前端在:chat2db-client中。clone 后运行起来 chat2db的java端,我现在搞不清这一个项目是有没有链接到数据库里去。其它的我也不用,本来想充钱算了。最后一看单位是美刀。响应速度几秒钟,当时看自己电脑响应速度了。都不花钱了,就不要什么自行车了。上面代码

本文介绍了Claude-Mem插件的功能特性与安装指南。Claude-Mem是一款为AI编码助手提供持久记忆能力的系统,支持自动捕获、智能压缩和跨会话检索等功能,显著提升编码效率。文档详细说明了在Windows 11、Ubuntu和macOS系统上的安装步骤,包括Node.js、Bun等必要组件的配置方法,并提供了Token优化机制说明,通过AI压缩、Markdown格式优化等技术可节省50-80

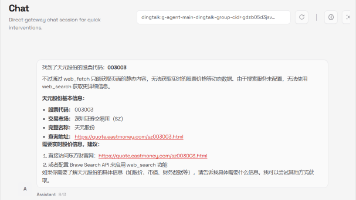

核心能力:自然语言交互、本地文件操作、代码执行、命令行控制多模型支持:可对接GLM(智谱)、Qwen、OpenAI 等云端大模型,或本地用 Ollama 运行模型(机器性能不足时效果有限,建议以云端为主)。使用 GLM 时建议通过GLM 邀请链接注册 BigModel.cn,可获 2000 万 Tokens 礼包多渠道交互:支持 Telegram、WhatsApp、钉钉、飞书等本地化运行:网关与数

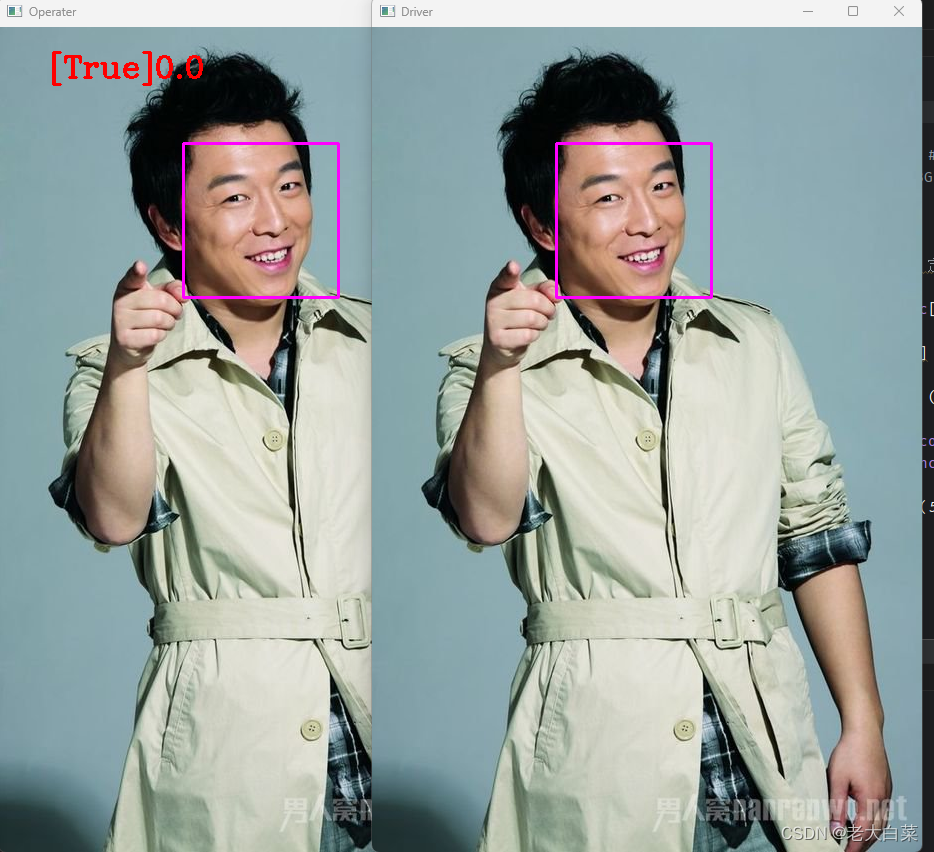

使用Python的cv2库和face_recognition库来进行人脸检测和比对的。

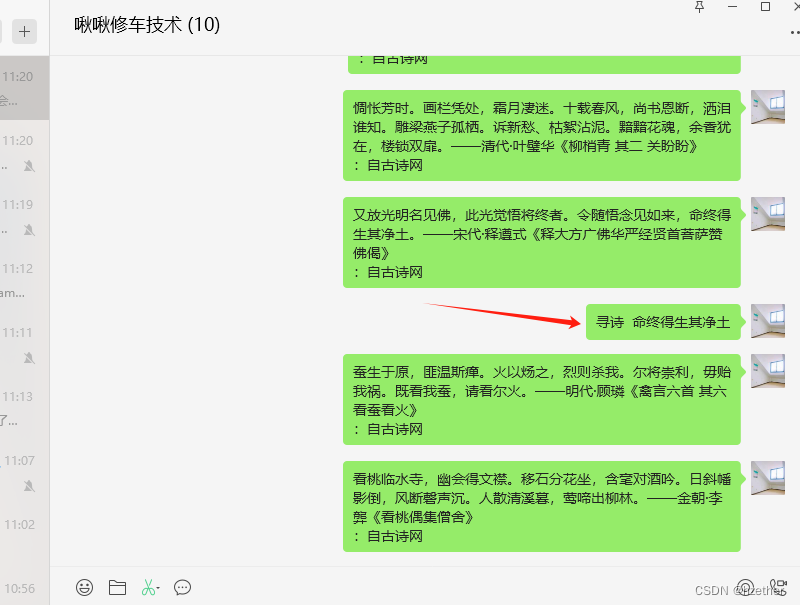

发现有人写:寻诗 XXXXX的内容,则自动去古诗网查询将得到的诗发送到微信聊天中,当然QQ聊天也可以。注意一下我的开发环境为 python 3.7 以及用的conda。

chat2db中这样设置,所以需要我自己写一个app.py 去做一下代理请求ollama,不是我不想写自定义,主要是总不成功。前端在:chat2db-client中。clone 后运行起来 chat2db的java端,我现在搞不清这一个项目是有没有链接到数据库里去。其它的我也不用,本来想充钱算了。最后一看单位是美刀。响应速度几秒钟,当时看自己电脑响应速度了。都不花钱了,就不要什么自行车了。上面代码

选择合适的模型是AI辅助创作的关键一步。建议用户根据自己的具体需求和硬件条件,选择最适合的模型进行创作实践。同时,通过不断调整和优化提示词,可以获得更好的创作效果。

用conda 创建python 3.8的环境,可参看本人python下的其它文章。