简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

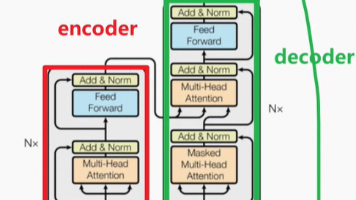

🚀 Transformer的三大创新:自注意力机制:完全替代RNN,解决长距离依赖问题位置编码:弥补注意力机制缺失的位置信息多头注意力:从多个角度捕捉不同类型的语义关系。

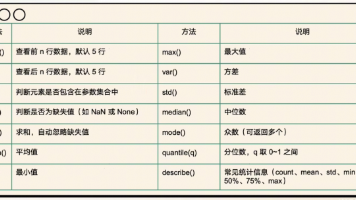

本文是一份Pandas数据处理与分析实战指南,从基础入门到高级应用全面覆盖。主要内容包括:Pandas核心数据结构Series和DataFrame的使用;多种数据格式的读写操作;数据清洗与预处理技巧(缺失值、异常值处理等);数据选择与过滤方法;数据转换与计算(新增列、排序、分组聚合);以及时间序列分析(按小时/天/月/季度分析销售数据)。通过实际案例演示,帮助读者掌握Pandas的核心功能,最终能

本文是PyTorch神经网络构建的实战指南,涵盖从基础张量操作到复杂网络架构设计的完整知识体系。主要内容包括: PyTorch张量核心概念:深入解析张量的维度、数据类型和设备特性,提供内存管理和性能优化技巧 nn.Module模块化设计:详细讲解神经网络基础构建块,包括: 网络初始化与权重管理 前向传播实现 参数统计方法 实战代码示例:通过BasicNeuralNetwork类展示完整的三层全连接

本文探讨了视觉-语言模型微调中的提示学习技术,重点分析了CoOp方法的局限性及其改进方案CoCoOp。CoOp采用静态提示易导致过拟合,泛化能力不足;而CoCoOp创新性地引入动态提示机制,通过元网络生成实例相关的条件令牌,使提示能根据输入图像内容动态调整。实验表明,CoCoOp在保持基类性能的同时显著提升了新类识别准确率,其"实例条件化"思想为提示学习提供了新范式。该技术平衡

现代大型语言模型(LLM)建立在深度学习、自然语言处理和分布式计算的交叉领域。核心架构Transformer的自注意力机制实现了对长序列数据的并行处理,为处理复杂语言任务奠定了基础。

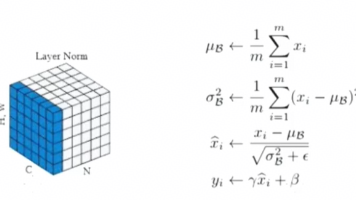

作用:将词汇索引转换为密集向量表示2、PositionalEmbedding(位置嵌入)作用:为模型提供序列位置信息📌 位置编码特点:- **绝对位置感知**:每个位置有唯一编码- **相对位置可计算**:通过三角函数公式计算相对位置- **长度可扩展**:支持比训练时更长的序列3、TransformerEmbedding(完整嵌入层)作用:组合词嵌入和位置嵌入二、MultiHeadAttent

Shuvendu Roy, Ali Etemad加拿大女王大学摘要我们提出了一种新的视觉语言模型微调方法——一致性引导的提示学习(CoPrompt)。我们的方法旨在提高大型基础模型在小样本设置下对下游任务进行微调时的泛化能力。CoPrompt的核心思想是在可训练模型与预训练模型的预测之间施加一致性约束,以防止对下游任务的过拟合。此外,我们在一致性约束中引入了以下两个组件以进一步提升性能:对两个扰动

一个学生(可学习模型)在学新任务时,身边坐着一位博学的老师(冻结的预训练模型)。学生可以使用高级文具(提示)和脑力辅助器(适配器)来学习。老师的要求是:1)你思考问题的方向要跟我大体一致(

明确目标:清晰定义任务成功标准迭代设计:从简单Prompt开始,逐步增加复杂度多样测试:使用不同类别和难度的测试用例量化评估:建立可量化的评估指标持续优化:基于反馈持续改进Prompt设计Prompt工程既是科学也是艺术。随着大型语言模型的不断发展,精心设计的Prompt将成为释放模型潜力的关键。本文系统性地介绍了从基础到高级的各种Prompt技术,建议读者结合实际应用场景,灵活组合这些技术,并通

本文探讨了视觉-语言模型微调中的提示学习技术,重点分析了CoOp方法的局限性及其改进方案CoCoOp。CoOp采用静态提示易导致过拟合,泛化能力不足;而CoCoOp创新性地引入动态提示机制,通过元网络生成实例相关的条件令牌,使提示能根据输入图像内容动态调整。实验表明,CoCoOp在保持基类性能的同时显著提升了新类识别准确率,其"实例条件化"思想为提示学习提供了新范式。该技术平衡