简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

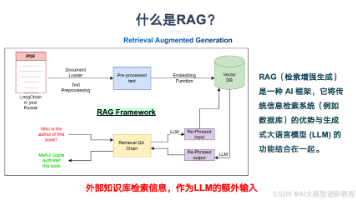

**RAG(Retrieval-Augmented Generation,检索增强生成) 是一种结合了信息检索技术与语言生成模型的人工智能技术。****该技术通过从外部知识库中检索相关信息,并将其作为提示(Prompt)输入给大型语言模型(LLMs)****,以增强模型处理知识密集型任务的能力,如问答、文本摘要、内容生成等。RAG模型由Facebook AI Research(FAIR)团队于20

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!点击领取:2025最新最全AI大模型资料包:学习路线+书籍+视频+实战+案例…

“ 算力准备是大模型私有化部署的必要前提,那什么是算力?大模型算力芯片的种类有哪些?”无论是大模型训练阶段还是推理阶段都需要强大的算力支撑,什么是“算力”?大模型所需要的算力有何特点?

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!点击领取:2025最新最全AI大模型资料包:学习路线+书

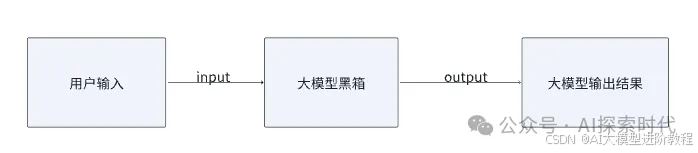

在对大模型的了解和应用过程中发现一个问题,就是很多人对大模型抱着神秘和高大上的想法;认为搞大模型的都是技术大拿或者高学历的精英人才,甚至有些人会认为大模型无所不能。但事实上,大模型没有大家想象中的那么神秘和复杂;大模型也有自己的能力边界,它也无法做到超出它能力范围的事;而且现在大模型也存在各种各样的问题,否则大模型技术就不再需要发展了。

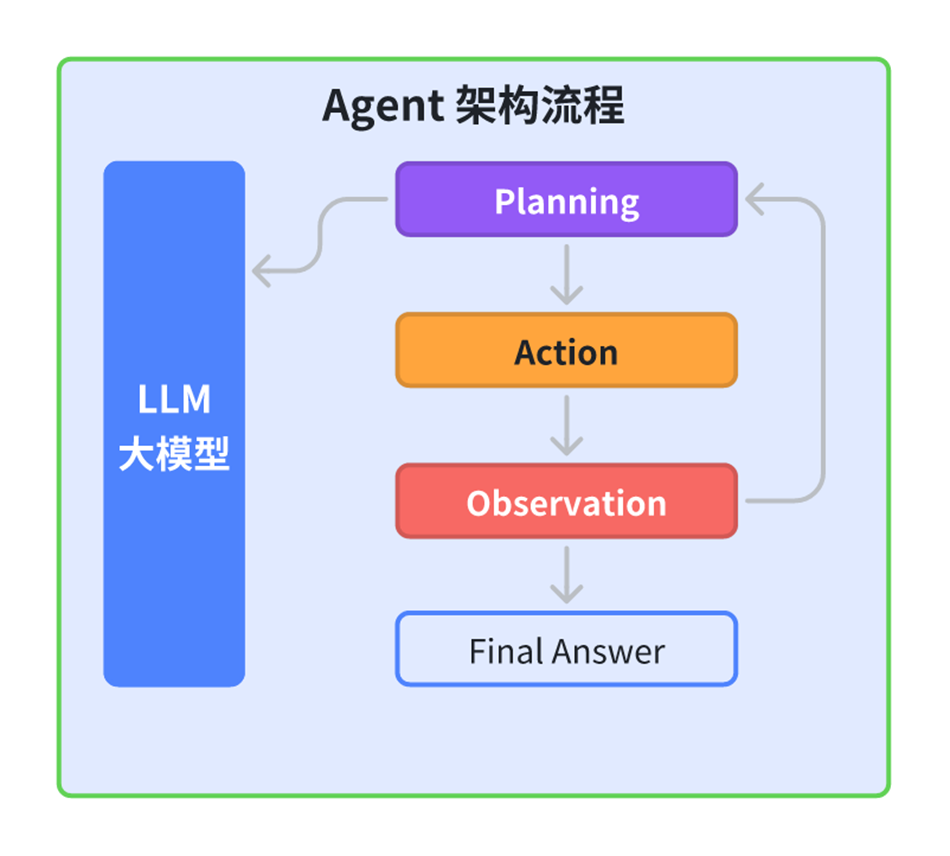

从去年到今年,大模型、chatGPT等概念和技术越来越火,但是像笔者一样的技术小白一直对大模型是一种似懂非懂的状态。鉴于最近在做基于大模型和Agent的上层AI应用,如若不了解底层概念,始终还是会限制产品层的能力,因此,最近2周零散时间读完了这本由复旦团队出版的《大规模语言模型:从理论到实践》,基本涉及到了大模型入门所需的核心框架内容,适合扫盲看。

本文提供了Python微调LLM的完整指南,使用Unsloth工具和Google Colab,以Phi-3 Mini为基础模型,通过LoRA技术高效微调。详细介绍了从数据收集、模型加载、训练到通过Ollama在本地运行的九大步骤,帮助开发者将通用大模型转变为领域专家,实现隐私安全、定制化的本地AI应用。

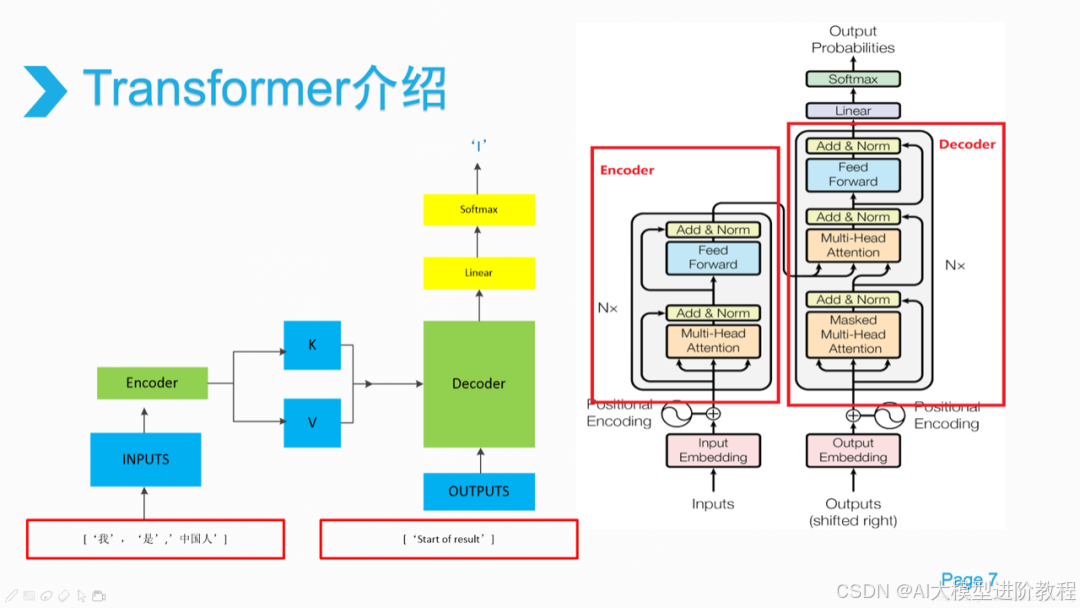

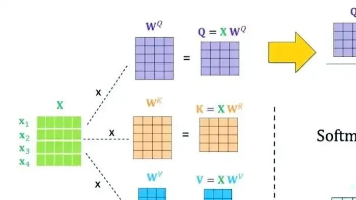

在深度学习的璀璨星空中,Transformer架构无疑是最为耀眼的明星之一。自2017年被提出以来,Transformer以其卓越的性能和强大的表现力,迅速席卷了自然语言处理、计算机视觉等多个领域,成为了众多前沿研究和应用的基石。

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

为什么下一波人工智能浪潮并非只属于技术人员?想象一下,一年之后,从人工智能中赚取最多收入的人不再只是那些常见的程序员、营销人员或销售专家。不,真正的赢家是那些决定掌握一些关键人工智能技能的普通人。你猜怎么着?你无需成为技术专家也能加入他们。