简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

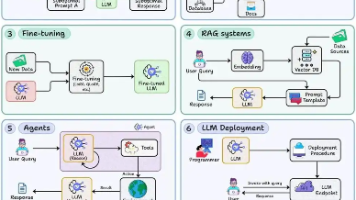

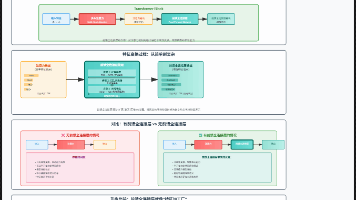

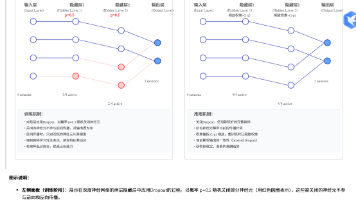

本文深入解析了Transformer架构中的前馈神经网络(FFN)模块,揭示其核心作用与实现原理。FFN位于Transformer层后半部分,采用"升维-激活-降维"的三步结构(线性变换→GELU激活→线性变换),负责深层语义理解。在Transformer中,FFN与注意力机制协同工作:注意力层捕捉词间关系,FFN则进行深度语义加工。关键优势体现在三个方面:实现非线性语义挖掘、

一,创建子进程fork函数 pid_t fork(void);创建成果返回打于0 ,失败返回 小于0二,exec函数exec函数族一般规律exec函数一旦调用成功即执行新的程序,不返回。只有失败才返回,错误值-1。所以通常我们直接在exec函数调用后直接调用perror()和exit(),无需if判断。(list)命令行参数列表p (path)

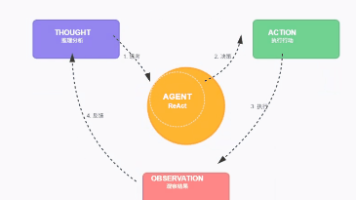

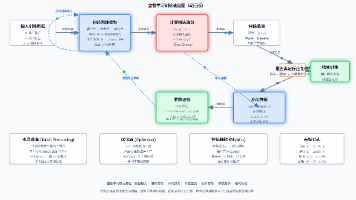

摘要 ReAct是一种智能体经典范式,将推理(Reasoning)与行动(Acting)紧密结合,形成"思考-行动-观察"循环。该范式通过特殊提示工程引导模型,使每一步输出遵循固定轨迹:思考当前情况→采取具体行动→观察反馈结果,直至获得最终答案。ReAct特别适合需要外部知识、精确计算或API交互的任务。文章介绍了ReAct的工作流程、系统提示词模板,并提供了Python代码实

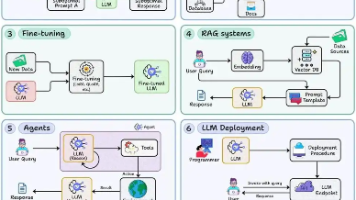

词元和嵌入向量是人工智能生成内容(AIGC)中使用LLM的两个核心概念。

最近在Google 出Gemini3.0 、马斯克团队出了Grok-4.1,OpenAI连夜出ChatGPT-5。

zWTXbzWTXbzw1∗x1w2∗x2b神经元{z = w_1*x_1 +w_2*x_2 + ... + b(神经元)}zw1∗x1w2∗x2...b神经元AI、ML、LLM和AIGC算法应用及其探索项目地址:https://chensongpoixs.github.io/LLMSAPP/

我使用google的gamma3 , 帮我规划学习大模型底层, 从工程路线,学习Transformer、到大模型、多模态, 分析业界哪些框架可以帮我从底层学习路线综合分析并给出结论。然后对gamma3给出的结论, 放到gpt中让gpt结合业界分析这个结论怎么样啊 帮我分析一下 给出流程和结论,并给打分 不及格是低于60分, 及格是60 ,良好是75到85 分, 优秀 85到95分 , 满分100分

Transformer架构中注意力机制已经应用到各种深度学习模型当前去提高细节关注AIGC、LLM大模型项目:https://chensongpoixs.github.io/LLMSAPP/

词元和嵌入向量是人工智能生成内容(AIGC)中使用LLM的两个核心概念。

最近在Google 出Gemini3.0 、马斯克团队出了Grok-4.1,OpenAI连夜出ChatGPT-5。