简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

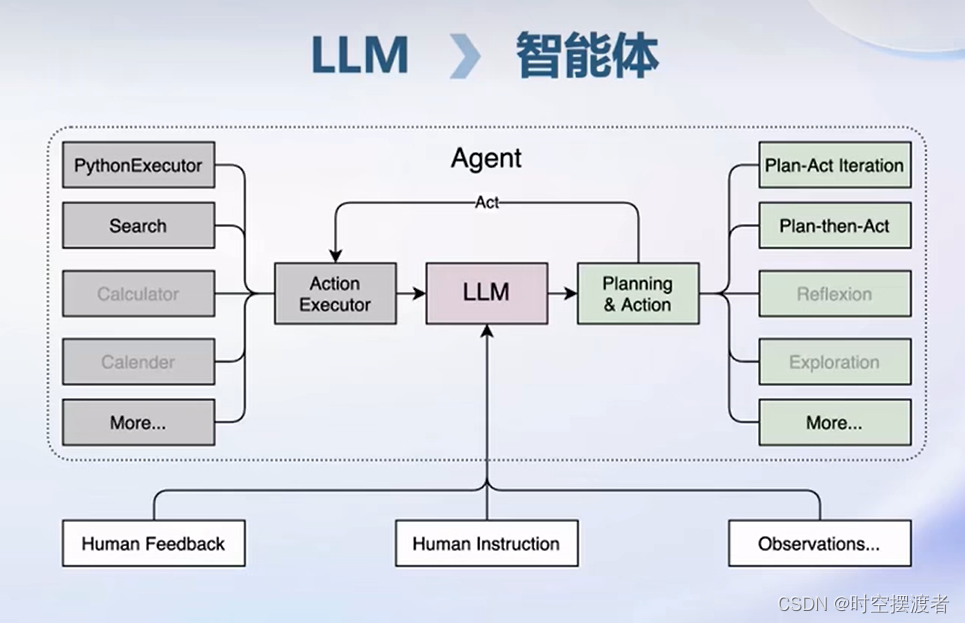

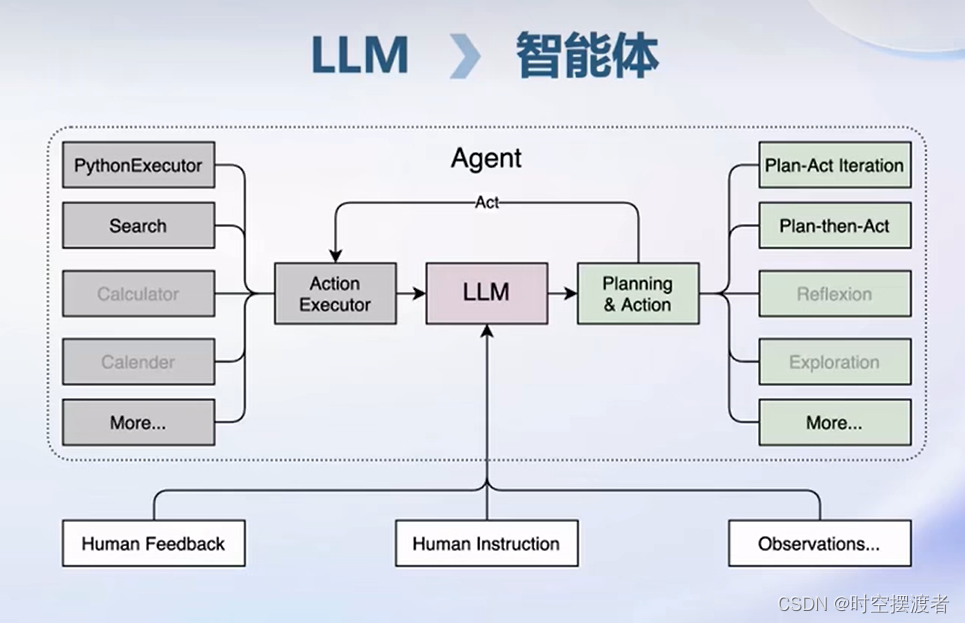

大型语言模型(LLM)的训练流程主要包括预训练、监督微调(SFT)和强化学习对齐(RLHF)三个阶段。预训练赋予模型海量知识和推理能力;SFT通过指令微调使模型理解用户指令,而非针对具体任务微调;RLHF则通过人类反馈优化模型输出。奖励模型(RM)作为RLHF的核心组件,通过人类标注的偏好数据(如排序式标注)训练,对模型输出进行评分。强化学习采用PPO算法,结合策略模型和参考模型,利用优势函数优化

本文是源于Datawhale8月集成学习第一章数学基础的高等数学小节,增加了一些概念的解释链接和部分代码的注释,希望对大家有所帮助

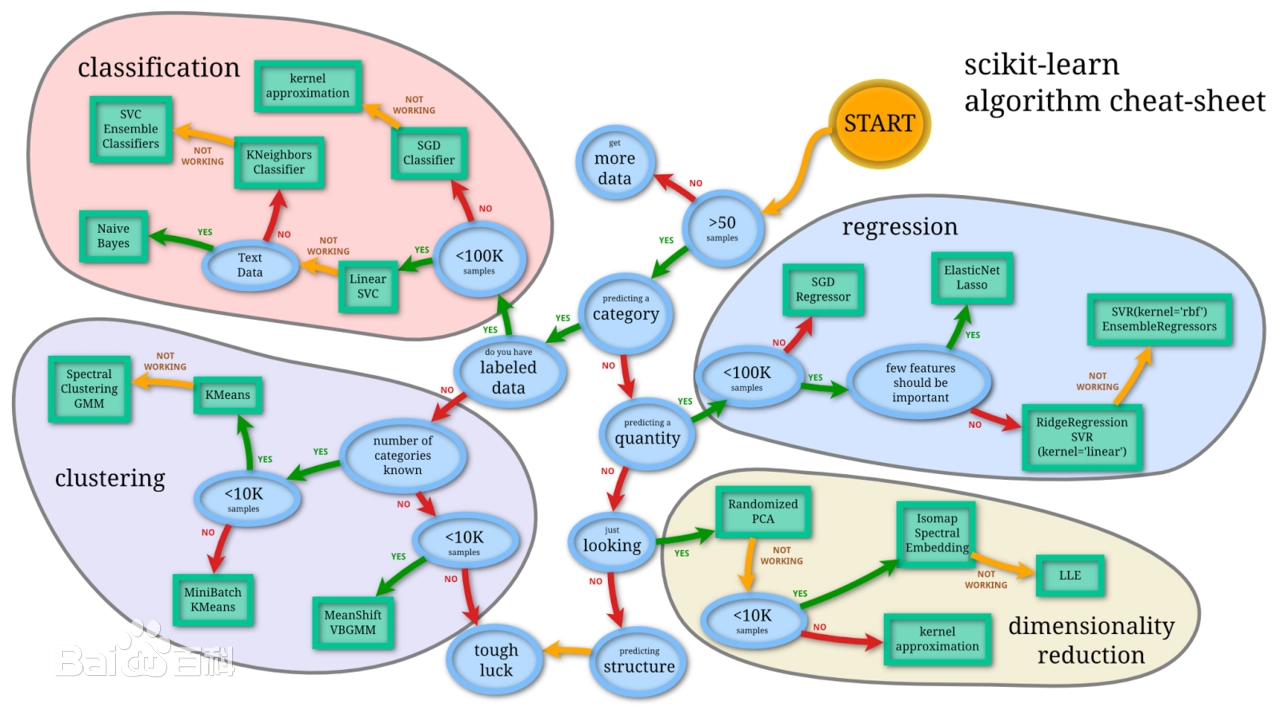

本文改编自Datawhale2021年8月集成学习,加入了一些自己的修改和注解。重点介绍了优化模型;训练均方误差与测试均方误差;偏差-方差的均衡;特征提取;压缩估计;降维

本节是CSW224第一部分的最后一节(semi-supervised node classification),用一部分已知标签的节点去预测剩下的未知标签的节点。注意:半监督与监督学习不同,这里将已经学到的模型泛化到上,仅仅是对原图的剩余节点进行分类,因为在学习模型时,原图的未知标签的节点也可能用于训练。这种被称为,与之相对应的是。对于图神经网络,是可以做到归纳式学习。

书生.浦语大模型的大致介绍以及开发平台的示例运行介绍

本文是源于Datawhale8月集成学习第一章数学基础的高等数学小节,增加了一些概念的解释链接和部分代码的注释,希望对大家有所帮助

书生.浦语大模型的大致介绍以及开发平台的示例运行介绍

本文主要介绍阿里云天池大数据平台的学习赛——工业蒸汽量预测。文章内容来自《阿里云天池大赛赛题解析》以及我自己的理解。涉及到的技术点包括数据分析、缺失值、异常值的处理、新变量生成、多种数据可视化(KDE、线性回归、直方图、Q-Q图、箱形图)以及特征变量之间的相关性计算、热力图展示因内容较多,此后会不断更新

简要介绍了Python的第三方库minepy的基本信息、重点介绍在python和Anaconda中的安装过程,包括查询python对应的whl版本和pip的默认安装路径的选择

在本地虚拟机centos7,编译nginx1.9,并搭建静态页面,包含nginx常用命令和主配置文件介绍