简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

2026年春招中,AI岗位数量同比增长约12倍,成为最核心的人才争夺赛道。AI岗位平均月薪达6.738万元,远高于新经济行业整体水平。AI人才供不应求,供需比仅为0.97,其中高性能计算工程师最紧缺。本文旨在为想要进入AI领域的小白和程序员提供大模型学习指南,帮助大家抓住AI发展机遇。人工智能(AI)热潮给中国求职招聘带来新风向,春招AI岗位量暴涨12倍。据财联社报道,职场社区平台脉脉发布《社交求

传统后端基础是底线,AI大模型与Agent技术是加分核心、上岸关键。对于零基础小白、在校学生、初级程序员来说,不要再死磕传统CRUD开发!未来的技术竞争,是工程基础能力+AI赋能能力的双重竞争。给大家整理了适配2026大厂招聘的学习优先级:\1. 夯实基础:吃透数据结构、算法、计算机网络、操作系统核心知识,熟练掌握一门主力开发语言;\2. 上手工具:熟练主流AI编程工具,系统学习Prompt调优、

传统后端基础是底线,AI大模型与Agent技术是加分核心、上岸关键。对于零基础小白、在校学生、初级程序员来说,不要再死磕传统CRUD开发!未来的技术竞争,是工程基础能力+AI赋能能力的双重竞争。给大家整理了适配2026大厂招聘的学习优先级:\1. 夯实基础:吃透数据结构、算法、计算机网络、操作系统核心知识,熟练掌握一门主力开发语言;\2. 上手工具:熟练主流AI编程工具,系统学习Prompt调优、

AI岗位需求激增12倍,平均月薪60738元,但高薪集中在金字塔尖。编辑、客服等岗位需求减少,职场面临转型。文章分析了“做AI的人”(AI工程师)、“喂AI的人”(数据标注/训练师)和“用AI的人”(AI产品经理)三类核心岗位所需能力,指出普通人的转型方向是结合原有技能与AI应用,关注AI岗位去初级化趋势,抓住AI产品落地机会,成为具备RAG、Agent智能体、微调等核心能力的大模型应用开发工程师

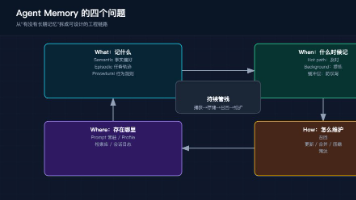

Agent 记忆设计是大模型持续学习和协作的关键。文章探讨了记忆设计的核心难点,包括信息存储、上下文窗口限制以及记忆召回策略。通过分析 OpenClaw 和 Hermes 两个代表性项目,文章展示了不同的记忆设计思路,并强调了记忆设计需要综合考虑信息价值、写入时机、存储层级和召回维护策略。文章最后展望了下一代 Agent 记忆设计的趋势,包括结构化、时间性、实体链接、中间层、多模态和多 agent

2026年,AI应用确实火得一塌糊涂,但市场缺的不是懂AI的人,是能把AI落地到业务里的人!我们做后端的,转型有天然优势:我们懂架构、懂稳定、懂怎么省钱,只要补补AI的相关知识,就能成为公司抢着要的稀缺人才,比那些纯AI背景、不懂工程的人,竞争力强多了。就算你暂时不转岗,多学一点大模型、RAG、Agent这些新技术,也能在你现在的团队里脱颖而出,成为“最懂AI的后端”,机会自然会主动找你。我转型这

本文为程序员提供了转岗大模型应用开发的完整学习路径,分为四个阶段:基础准备、核心技能构建、技术直觉形成和实战深化。文章强调掌握RAG、Agent和Prompt等关键技术的重要性,并指出这些技能能帮助求职者在AI领域获得加分。第一阶段:基础准备期(目标:建立基础知识框架)第二阶段:核心技能构建期(目标:掌握AI应用开发全流程)第三阶段:技术直觉形成期(目标:深入了解传统AI基础)第四阶段:实战与深化

现在看开源 AI 项目,我更在意的已经不是“接了多少模型”,而是它有没有把对话、知识库、工具调用和扩展能力真正连起来。目前还在持续迭代,但方向已经挺清楚了:它想做的不是一个演示型聊天页,而是一个更完整的智能助理平台。如果你最近正想找一个项目,看看 Agent、RAG、MCP、Skills 这些能力怎么放在一起,这个仓库值得翻一翻。

求职这件事,败在方向错了,比败在努力不够更可惜。知识积累≠竞争力。能讲清楚自己做过什么、为什么这样做、遇到什么问题怎么解的,这才是面试官真正在评估的。所以,从今天开始,把刷题和背概念的时间压缩一半,把这一半时间用来深挖你最核心的那个项目,把它讲得无懈可击。就这一件事,比你再背一百道八股题,有用得多。

近些年基础大模型能力飞速迭代升级,智能体 Agent 行业迎来爆发式发展浪潮。Cloud Code、Codex、OpenClaw、Hermes 等新一代 Agent 框架与落地产品接连问世,智能体综合能力较早期版本实现跨越式提升,持续带动整个 Agent 技术生态蓬勃发展。此前我陆续发布多篇文章,讲解 Agent 基础定义、核心架构与落地搭建技巧,包括《为什么一定要做 Agent 智能体?》《如何