简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

澳鹏与HuggingFace合作推出非公开英语音频数据集,提升ASR榜单评估真实性。该数据集涵盖多种口音和语音类型,仅用于评估不公开,有效防止模型"刷榜"行为。榜单新增朗读/对话语音、美国/非美国口音等多维度评估指标,揭示不同模型在各类场景下的真实表现差异。数据显示,引入非公开数据后模型排名出现显著变化,表明该机制能更准确反映模型泛化能力。此次合作为语音识别领域建立了更可靠的评

2026年,AI准确性成为企业核心关切,RLVR(基于可验证奖励的强化学习)应运而生,弥补了RLHF在关键领域的不足。RLVR通过程序化校验(如数学验证、代码测试、结构化输出等)确保模型输出符合硬性规则,实现高可信度与可审计性。与优化主观体验的RLHF不同,RLVR专注于客观准确性,两者协同可兼顾正确性与用户体验。

RLHF是一种前沿技术,它能够结合强化学习与人类反馈,提高大型语言模型的性能。RLHF利用多元化的反馈提供者,帮助模型学习生成更具代表性和相关性的回复,使它们更好地满足用户的需求。RLHF还可以帮助减少生成式AI模型的偏见,加速学习过程,从而实现更高效、更具成本效益的训练。随着生成式AI领域的不断发展,我们相信,在帮助企业创建满足用户需求的高质量、引人入胜的内容方面,RLHF将发挥越来越重要的作用

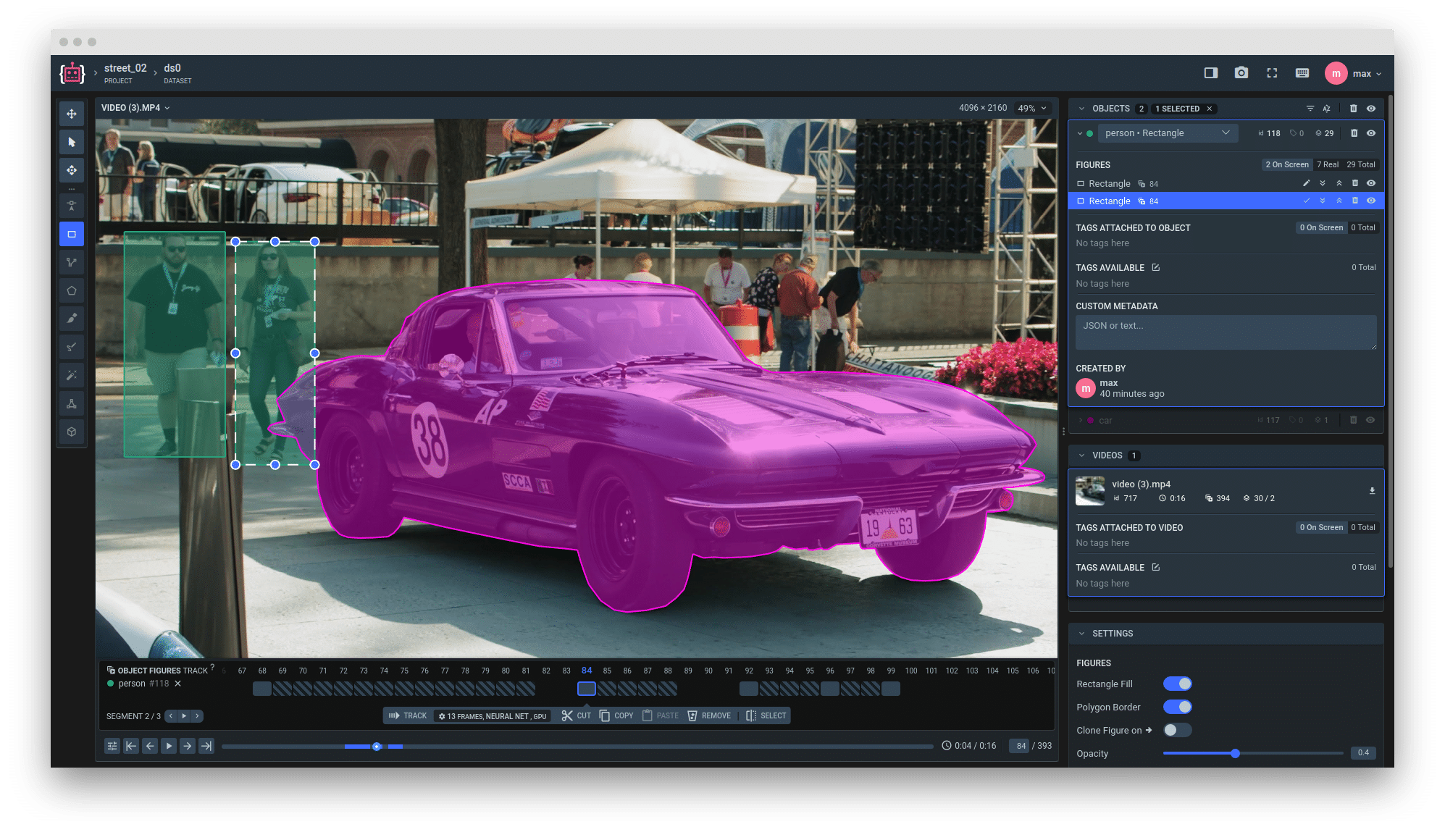

到了1978年,麻省理工学院人工智能实验室的研究人员开发了一种自下而上的方法,从二维计算机生成的“草图”中推断出三维模型,至此,计算机视觉的实际应用才变得显而易见。计算机视觉和机器视觉均利用图像捕捉和分析,其执行任务的速度和精确度是人眼无法比拟的。有鉴于此,用这两种密切相关的技术的共性来描述二者,用它们的特定用例而不是它们之间的差异来区分二者,可能会更有成效。有一些公共使用的免费数据集可以很好地用

许多组织已经在开发基本框架以支持 CV 在日常操作中的使用,并通过连续的数据管道确保其模型具有适当数量的训练数据,以使其能够随着时间的推移而执行和改进。其中,有通用模型,或者针对特定场景采集标注的数据,例如家用扫地机器人,宠物摄像头,等。例如,通过计算机视觉,机器可以识别出冰面上的黑色冰球,但是球员的溜冰鞋可能会干扰该冰球的配准。配准:计算机将不同数据集转换至单个坐标系中,例如,从取自临床事件轨迹

如今,人工智能和机器学习领域中最振奋人心的一个分支是。CV应用于多种场景,以改善我们的日常生活,并推进科学技术研究。

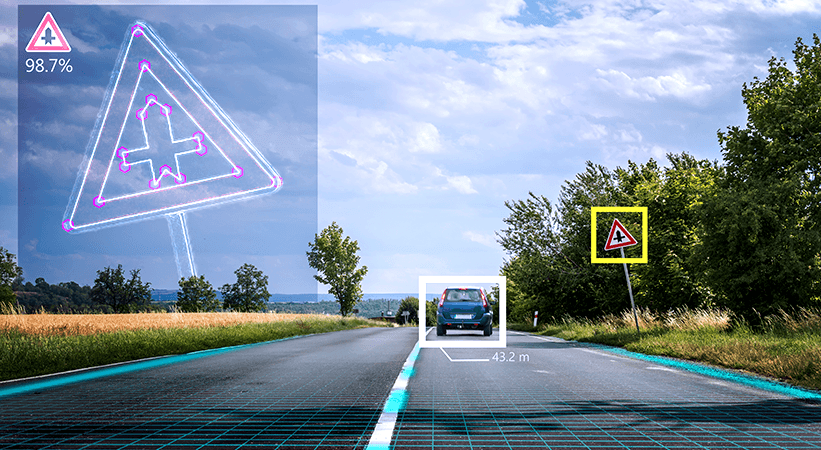

具身智能(Embodied AI)正迎来爆发式增长——从工业机器人到人形智能体,从实验室研究到千亿级市场落地,具身智能正在重塑AI与物理世界的交互方式。全球科技巨头与创新企业纷纷布局,大模型驱动的智能体正加速从“数字理解”迈向“物理执行”。具身智能正引领AI技术进入新纪元。在机器人、智能体、自动驾驶系统等领域快速发展的当下,如何让AI真正理解并适应物理世界,成为行业面临的核心挑战。高质量、多模态训

具身智能正成为下一代AI发展核心,但面临高质量多模态数据不足的挑战。本期推荐两大核心数据集:1000小时机械臂遥操数据集(覆盖多场景任务,含多模态同步数据)和第一人称手部操作数据集(专业场景动作捕捉)。这些数据从通用智能形成、环境适应性及任务迁移三个维度,助力攻克跨模态融合、动态适应等瓶颈。澳鹏提供800+成品数据集,支持80+语言,持续为AI模型训练提供高质量数据解决方案。

2026年AI发展将呈现四大关键趋势

具身智能正成为下一代AI发展核心,但面临高质量多模态数据不足的挑战。本期推荐两大核心数据集:1000小时机械臂遥操数据集(覆盖多场景任务,含多模态同步数据)和第一人称手部操作数据集(专业场景动作捕捉)。这些数据从通用智能形成、环境适应性及任务迁移三个维度,助力攻克跨模态融合、动态适应等瓶颈。澳鹏提供800+成品数据集,支持80+语言,持续为AI模型训练提供高质量数据解决方案。