简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

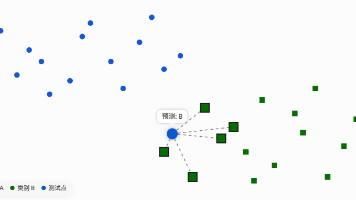

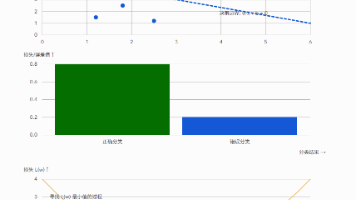

学 KNN,不是因为它现在一定是最强算法,而是因为它特别适合建立机器学习的几个核心直觉。KNN 是最直观的机器学习模型之一。它的思想就是:跟你最像的人,大概率和你属于同一类。比如判断一个电影用户喜不喜欢某部电影,可以看和他兴趣最接近的用户怎么评价。判断一个新样本属于哪类,可以看它附近的样本属于哪类。这个思想非常朴素,但很多复杂方法背后也有类似的“相似性”思想。它不只是一个分类算法,更是后面很多机器

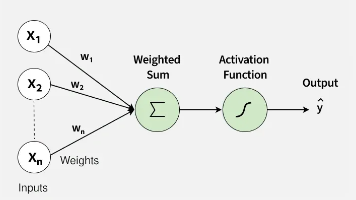

感知机(Perceptron)是机器学习和神经网络领域中最基础的模型。你可以把它看作是现代深度学习中那些极其复杂的人工神经网络的“老祖宗”或基本构建块(即单个神经元)。现在的深度学习听起来很高大上(比如包含千亿参数的大语言模型),但如果你把它们拆开来看,它们的底层依然是密密麻麻的感知机。

我们为什么还要学习统计学习方法?在如今深度学习(Deep Learning)和大语言模型(LLMs)“大杀四方”的时代,连几行代码就能调用强大的 AI,为什么我们还要回头去啃《统计学习方法》里那些看似“老旧”的传统算法(如 SVM、逻辑斯谛回归、决策树)?我们学习统计学习方法,是因为它是对人类“认知过程”和“世界运转规律”最严谨的数学抽象。它不仅是一门技术,更是一套底层世界观。

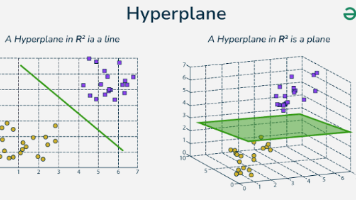

构建复杂优化模型的前提,是深刻理解其底层的几何可行域。Boyd 的《凸优化》第 2.2 节为我们提供了一整套描述凸集的数学工具,但如何在代数定义与几何直觉之间建立桥梁,是每个初学者的必经之路。本文系统梳理了仿射集与凸集的核心模块,从基础的超平面 (Hyperplanes) 与半空间 (Halfspaces) 出发,逐步延伸至欧几里得球、椭球以及不同度量下的范数锥,并深入剖析了最抽象的半正定锥 (P

在人工智能技术飞速发展的今天,网络安全攻防战已经悄然升级。传统的钓鱼邮件往往伴随着拼写错误和拙劣的伪造,但如今的攻击者正在利用大语言模型(LLM)生成完美无瑕的商业话术,甚至融合了复杂的链接混淆和底层协议欺骗 。面对这种多维度的立体攻击,传统的黑名单规则和静态机器学习模型显得力不从心 ;而直接让单一的 AI 模型去判断整封邮件,又容易陷入“只见树木不见森林”的误报陷阱 。

今天我们来详细讲解一下用于序列预测的自回归扩散模型 (Autoregressive Diffusion Models)。这个模型结合了两种强大思想:自回归 (Autoregressive, AR) 和 扩散模型 (Diffusion Models, DM),旨在生成高质量、连贯的序列数据。

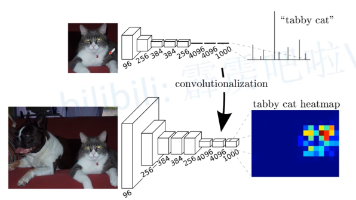

FCN本身可能已经不是当今性能最强的模型,但它所开创的“编码器-解码器”以及“跳跃连接”的范式,已经成为后续几乎所有分割网络设计的标准模板。理解了FCN,就等于拿到了开启现代图像分割大门的钥匙。

LangChain 是一个开源框架,专门用于帮助开发者更轻松、高效地构建基于大型语言模型(LLMs)(如 ChatGPT、Gemini、Claude 等)的应用程序。如果把大语言模型比作一个非常聪明但被关在房间里的大脑(它拥有海量的静态知识,但无法获取实时信息,也不能直接操作电脑),那么 LangChain 就是为这个大脑装上“眼睛”、“手脚”和“记忆”的工具箱。

LangChain 是一个开源框架,专门用于帮助开发者更轻松、高效地构建基于大型语言模型(LLMs)(如 ChatGPT、Gemini、Claude 等)的应用程序。如果把大语言模型比作一个非常聪明但被关在房间里的大脑(它拥有海量的静态知识,但无法获取实时信息,也不能直接操作电脑),那么 LangChain 就是为这个大脑装上“眼睛”、“手脚”和“记忆”的工具箱。

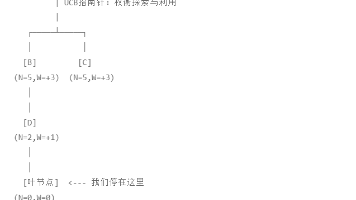

网上关于 MCTS(蒙特卡洛树搜索)的原理讲解很多,但能从直觉到公式,再到代码落地讲透的却很少。本文将分 10 个章节,像剥洋葱一样拆解 MCTS。我们要抛弃复杂的深度学习框架,仅用纯 Python,从最基础的“多臂老虎机”原理讲起,推导 UCB 公式,直到手写出一个完整的、能玩井字棋的 AI。无论你是 DRL 初学者还是想探究 AlphaGo 原理的开发者,这篇文章都能带你彻底通关。