简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

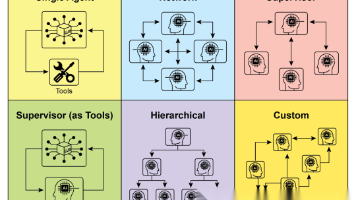

自定义」模型代表了多智能体系统设计的终极灵活性,允许为特定问题或应用精确定制相互关系和通信结构。它既可以是融合了已有模型特点的混合方案,也可以是针对独特环境约束和机会时产生的全新设计。自定义模型通常用于优化特定性能指标、处理高度动态环境或将领域特定知识纳入系统架构的场景。设计与实现这类模型通常要求对多智能体系统原理有深入理解,并需慎重规划通信协议、协调机制及可能出现的涌现行为。总之,为多智能体系统

文章介绍了8个主流AI智能体平台,包括字节跳动的扣子、360的纳米AI、智谱清言、Kimi的OK Computer、阿里云百炼、通义千问、腾讯元器以及国外的Manus。这些平台各有特色,有的适合新手入门,有的专注企业应用,有的擅长特定任务。通过这些智能体平台,用户可以轻松创建AI助手,自动化处理PPT制作、数据分析、报告生成等工作,大幅提升工作效率,解放双手。前几天和大家聊了一下关于什么是智能体,

这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。光学理论是没用的,要学会跟着一起做,要动手

实现特征选择和模型稀疏化***********正则化()是什么?********当模型在训练数据上表现得太好时,它可能会学习到,而不是。********,得到新的损失函数L_new = L + λ∑|w_i|,其中λ是正则化系数,w_i是模型参数。****,得到新的损失函数L_new = L + λ∑w_i^2,其中λ是正则化系数,w_i是模型参数。******L1正则化(产生稀疏权重)、L2正则

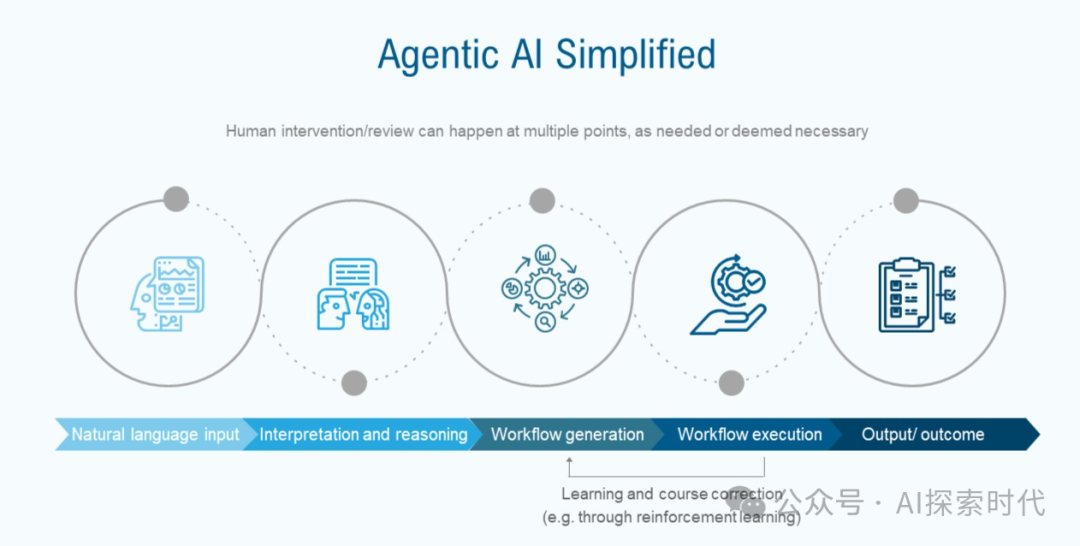

更倾向于描述人工智能的能力,专注于其自主性、适应性和目标导向行为。

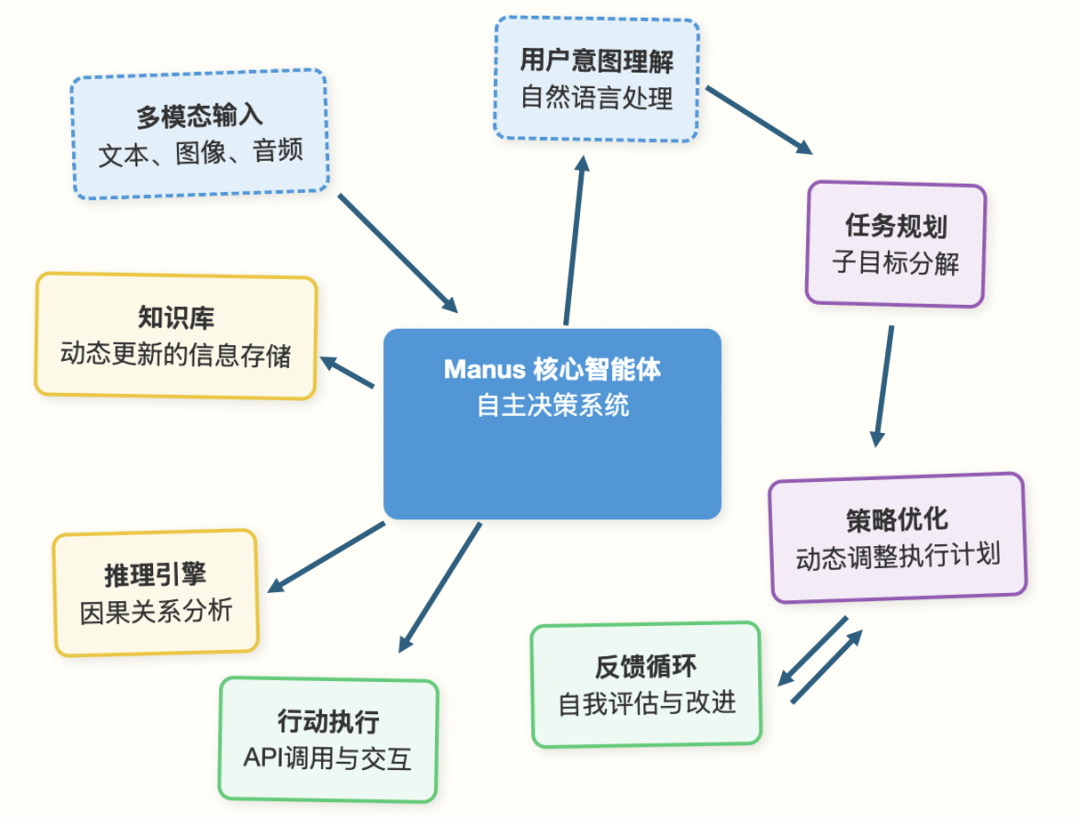

AI Agent(智能体)是能够感知环境、自主决策并执行动作的智能实体,它代表了AI从"被动回答"到"主动行动"的进化,正在成为大模型时代最受关注的应用形态之一。AI Agent(人工智能代理)是一种能够并的智能实体。与传统AI系统不同,Agent不仅能回答问题,还能主动完成一系列复杂任务。简单来说,如果把大语言模型LLM)比作一个"超级大脑",那么AI Agent就是给这个大脑装上了"手脚"和"

下面,来介绍下RAGFlow的核心功能。从下面图中可以看出,有5个,但是最核心的,其实就两个,一个是知识库(最核心),一个是聊天,其他三个都是辅助功能。有人好不同意了,人家也有Agent智能体功能啊,但实话,个人用起来,不是特别好用,简单的场景还可以,复杂的场景,支持有限。先从非核心功能介绍起:1、文件管理顾名思义,就是管理你上传的各种知识库文件,没啥多说的。2、搜索单纯的侧重于对知识库文件内容进

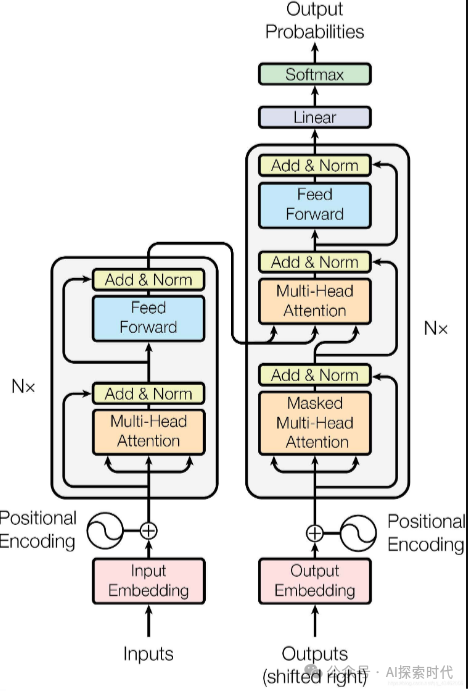

Transformer是一种用于自然语言处理(NLP)和其他序列到序列(sequence-to-sequence)任务的深度学习模型架构,它在2017年由Vaswani等人首次提出。Transformer架构引入了自注意力机制(self-attention mechanism),这是一个关键的创新,使其在处理序列数据时表现出色。

DeepSeek与AI工具链的深度融合,正在开启"智能办公2.0"时代。从本文展示的50+实战案例可以看出,AI技术已不再是简单的效率工具,而是正在重构整个知识工作体系。优先试点:选择1-2个高频场景快速验证建立标准:制定AI输出质量评估体系培养人才:组建"AI促进者"团队推动变革持续迭代:建立AI能力进化机制未来,随着多模态大模型和自主智能体(AI Agent)技术的发展,AI将更深入地融入工作

神经网络一定要多动手,多实践;把理论和实践相结合才能学得更好,更快。在前面关于Transformer架构的Encoder-Decoder,编码器-解码器结构的文章中介绍过,编码器和解码器是Transformer的核心结构,也是Transformer的载体;但而今天就来揭秘一下Transformer的编码器具体是怎么实现的。今天使用PyTorch神经网络框架实现Transformer的编码器;Tra