简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

为什么AI大模型成为越来越多程序员转行就业、升职加薪的首选很简单,这些岗位缺人且高薪智联招聘的最新数据给出了最直观的印证:2025年2月,AI领域求职人数同比增幅突破200% ,远超其他行业平均水平;整个人工智能行业的求职增速达到33.4%,位居各行业榜首,其中人工智能工程师岗位的求职热度更是飙升69.6%。AI产业的快速扩张,也让人才供需矛盾愈发突出。

《图解大语言模型实战指南》由AI科普专家Jay Alammar和BERTopic作者Maarten Grootendorst合著,获吴恩达推荐。全书采用图解方式系统讲解LLM原理、提示工程、文本处理及多模态应用,分为基础理论、实践应用和高级优化三部分。书中推荐先掌握Transformer架构(1-3章),再学习提示工程等核心技能(6-7章),最后探索量化等前沿技术。随书附赠640套AI报告、面试真

为什么AI大模型成为越来越多程序员转行就业、升职加薪的首选很简单,这些岗位缺人且高薪智联招聘的最新数据给出了最直观的印证:2025年2月,AI领域求职人数同比增幅突破200% ,远超其他行业平均水平;整个人工智能行业的求职增速达到33.4%,位居各行业榜首,其中人工智能工程师岗位的求职热度更是飙升69.6%。AI产业的快速扩张,也让人才供需矛盾愈发突出。

《40岁零基础转型AI的破局之路》摘要:一位传统行业从业者以自身经历验证大龄转行AI的可能性,提出"考证+实操"的转型路径。文章指出AI将深度渗透各行业,"AI+专业"能力将成为核心竞争力,并强调当前是学习AI成本最低的窗口期。作者通过开发健身AI小程序等实践案例,展示如何将技术落地应用,同时分享了对AI就业市场的观察——AI岗位需求激增543%,相关岗位薪资溢价显著。文末提供包含学习路线、实战教

大模型(LLM)已成为能处理文字、图片、音频等多模态信息的智能助手,国内外厂商如OpenAI、Google、DeepSeek、通义千问等推出了各具特色的产品。选择模型应关注实际需求、使用场景和成本效益,而非单纯追求参数规模。国外主流模型包括GPT、Claude、Gemini等,侧重不同领域;国内则以DeepSeek、通义千问等为代表,覆盖通用聊天、编程、多模态等多样化场景。未来大模型将更注重任务执

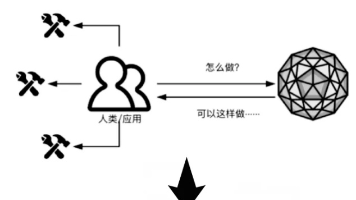

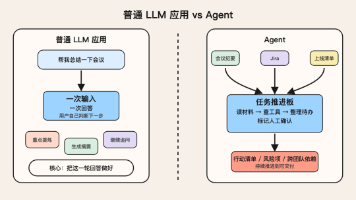

摘要: Agent(智能代理)是一种能感知环境、自主决策并执行任务的AI系统,其核心由大模型、记忆、规划能力和工具使用组成。工作流程包括目标接收、环境观察、行动规划与执行、反馈调整的循环。现代Agent具备经验学习、工具调用和任务分解等关键能力,应用场景涵盖GUI测试、移动操作自动化和桌面任务处理。当前前沿技术如OpenAI的ComputerUse和MobileFlow展示了Agent在多平台操作

本文系统梳理了AI大模型领域的六大核心岗位:模型研发工程师、算法工程师、数据科学家、AI产品经理、机器学习工程师和深度学习工程师,详细阐述了各岗位的职责要求、适用领域及适合人群。文章特别强调了AI大模型应用开发工程师作为技术与业务桥梁的重要价值,指出其月薪可达60k的市场现状。同时提供了包括学习路线、商业方案、视频教程等在内的完整学习资源包,助力从业者快速掌握大模型开发技能。随着AI技术加速落地,

本文厘清了Agent与普通LLM应用的本质区别,指出Agent是围绕目标持续推进任务的系统,具有目标导向、过程管理、状态记录和边界约束等特征。作者强调Agent不是简单的"能调工具的LLM",而是能根据观察结果动态决策、管理中间状态并在必要时与人交互的任务执行系统。文章还区分了workflow、Agent和multi-agent的概念层级,建议开发者应先明确任务契约和责任边界,再考虑技术实现。这种

国产AI公司Kimi完成136亿元融资,创下中国大模型领域最大单笔融资纪录,DeepSeek估值飙升至3000亿。文章指出,AI本质是效率工具而非人类替代品,重复性强、标准化程度高的岗位面临较大风险。建议将AI视为辅助工具,强化人类独有的判断力、共情力等核心能力,主动学习与AI协作提升效率。文章强调AI革命带来的是职业转型而非末日,关键在于如何借势升级,通过掌握AI对话能力、优化工作流程等方式实现

AI智能体在跨境电商领域的应用现状与局限 摘要:当前OpenClaw等AI智能体在阿里国际站等平台展现出自动化处理询盘、数据分析等能力,引发"代替人工"的行业讨论。然而实际应用中存在四大局限:AI幻觉导致错误输出、复杂场景判断力不足、工具依赖性强、长链任务可靠性低。实践表明,成功的应用模式是"AI+人"协作而非替代,建议将AI定位为辅助工具,分层应用于低风险任务,同时建立审核机制和安全流程。AI大