简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

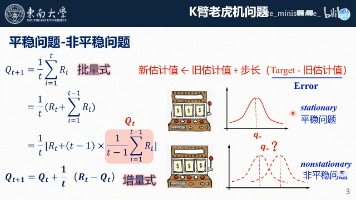

机器学习12-强化学习-K臂老虎机

机器学习12-强化学习-K臂老虎机

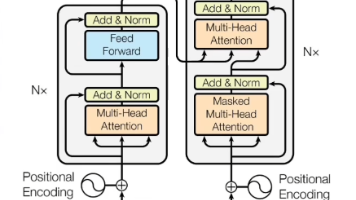

Transfomer学习

Transformer模型中的自注意力机制通过三个权重矩阵(W_Q、W_K、W_V)生成Query、Key和Value向量,分别用于查询、标记和存储信息。Query关注当前词的需求,Key提供其他词的特征,Value包含其他词的实际内容。这些矩阵通过初始化(如Xavier或Kaiming)和训练过程中的反向传播进行优化。Transformer的编码器和解码器分别负责特征提取和序列生成,编码器通过多

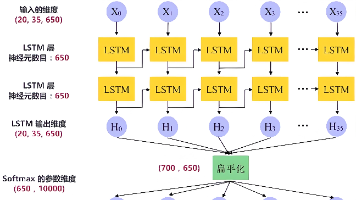

机器学习09-Pytorch功能拆解

机器学习09-Pytorch功能拆解

ChromaDB02-代码实战

ChromaDB02-代码实战

Neo4j01_图数据库概念和服务器安装

Neo4j01_图数据库概念和服务器安装

动手学深度学习07-现代卷积神经网络

动手学深度学习07-现代卷积神经网络

机器学习22-强化学习代码

机器学习22-强化学习代码

MFlow03-数据模型解析

MFlow03-数据模型解析