简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

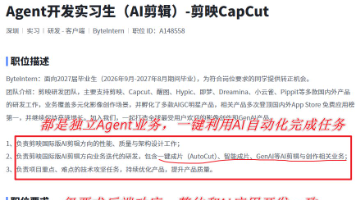

AI 不是淘汰程序员的工具,而是提升效率、拓宽职业边界的武器。普通开发转 AI 应用开发,本质是用老技能玩新场景。把上面这个项目跑通、理解原理、扩展功能,写进 GitHub 与简历,面试时能讲清每一步逻辑,你就已经从 “传统开发” 变成 “AI 应用开发工程师”,顺利上岸 AI 相关岗位。

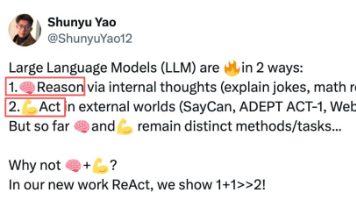

本文详细介绍了AI Agent的基础理论,包括ReAct、Plan-and-Execute和Reflection等模式,并对比了主流的AI Agent框架。文章还深入探讨了Agent框架的核心要素,如LLM Call、Tools Call和上下文工程,并通过一个极简的Agent框架实例,展示了如何将理论应用于实践。最后,文章强调了上下文工程在Agent应用中的重要性,并指出其在商业应用中的关键作用

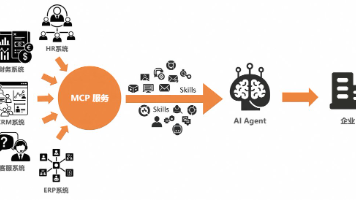

AI Agent(人工智能智能体)不是简单的聊天机器人,而是能够自主感知、规划、决策并执行任务的智能系统。与传统 AI 模型被动响应不同,Agent 具备以下核心特征:通俗理解:如果把大语言模型比作"博学但被动的大脑",那么 AI Agent 就是"有手有脚、能独立完成任务的智能员工"。技术定义:AI Agent = LLM(大脑)+ 规划能力(思考)+ 工具集(手脚)+ 记忆系统(经验)

整个过程不是一问一答,而是 Agent 拿到一个目标后,自己规划步骤、调用各种工具、中间检查结果、出错重试,直到任务闭环。

使用阿里云的探针在采集可观测数据,可以解决上述的问题,一次接入,所有应用全体生效,并且支持将多个 APP 的观测数据进行拆分。同时,基于 OpenTelemetry 可以将 Dify 内部的流程和外部的微服务调用和模型推理完整的穿起来,包括每个流程的 input/output 和 token 消耗,能够支持多层级然后接下来讨论一下这个模型的质量的问题,我们想要解决模型回答得好不好,每次模型的升级和

2026年,AI应用确实火得一塌糊涂,但市场缺的不是懂AI的人,是能把AI落地到业务里的人!我们做后端的,转型有天然优势:我们懂架构、懂稳定、懂怎么省钱,只要补补AI的相关知识,就能成为公司抢着要的稀缺人才,比那些纯AI背景、不懂工程的人,竞争力强多了。就算你暂时不转岗,多学一点大模型、RAG、Agent这些新技术,也能在你现在的团队里脱颖而出,成为“最懂AI的后端”,机会自然会主动找你。我转型这

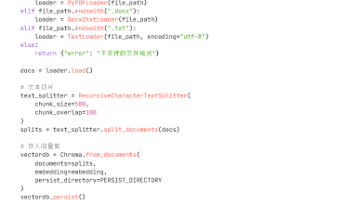

本文探讨了如何将RAG(检索增强生成)从Demo阶段成功推向生产环境。核心观点包括:明确用户需求、注重实际业务问题、优化文档切分策略、控制上下文质量、建立权限系统、实施评测体系、设计有效记忆功能、加强系统可观测性以及关注业务流程优化。文章强调,RAG的成功关键在于检索和语义理解能力,而非单纯依赖模型智能,并建议团队重视非技术性但至关重要的基础设施建设。过去两年,几乎每个 AI 产品团队都做过一个

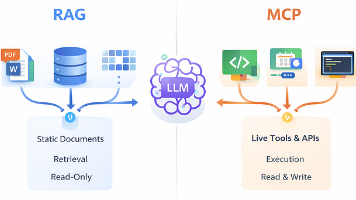

RAG 为你的 AI 提供知识。MCP 为你的 AI 提供实时访问能力以及执行操作的能力。它们并不是竞争关系,而是运行在 AI 应用不同层面的两种模式。一个负责“记忆”,一个负责“行动”。大多数严肃的 AI 应用最终都需要同时使用这两者。理解它们之间的差异,是区分“只会写提示词”的工程师和“能够构建真正有用 AI 系统”的工程师的关键。

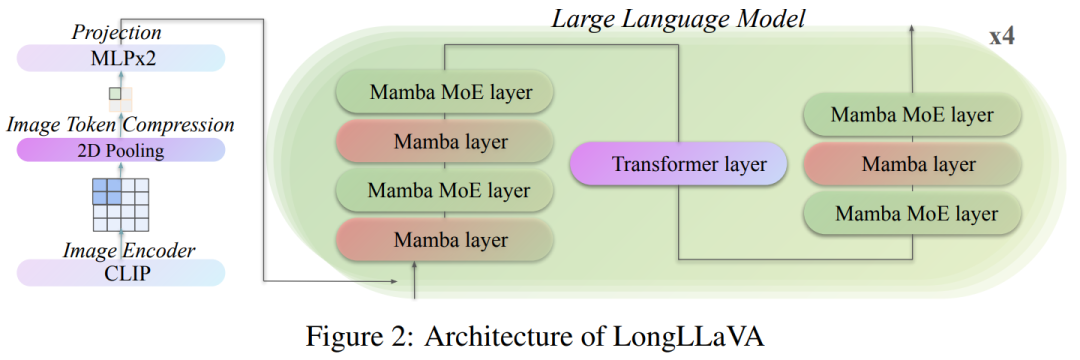

多模态大语言模型(MLLMs)的快速进步展示了它们在各个应用领域中的显著能力。然而,多图像理解场景仍然是一个重要但尚未充分探索的方面。特别是,将 MLLMs 的应用场景扩展到理解更长的视频、更高分辨率的图像以及基于更多历史信息的决策,对于提升用户体验和进一步拓展 MLLMs 的应用范围至关重要。然而,将 MLLM 的上下文长度扩展以提高其可用性,面临着处理更多图像时性能下降和计算成本高昂的挑战。一

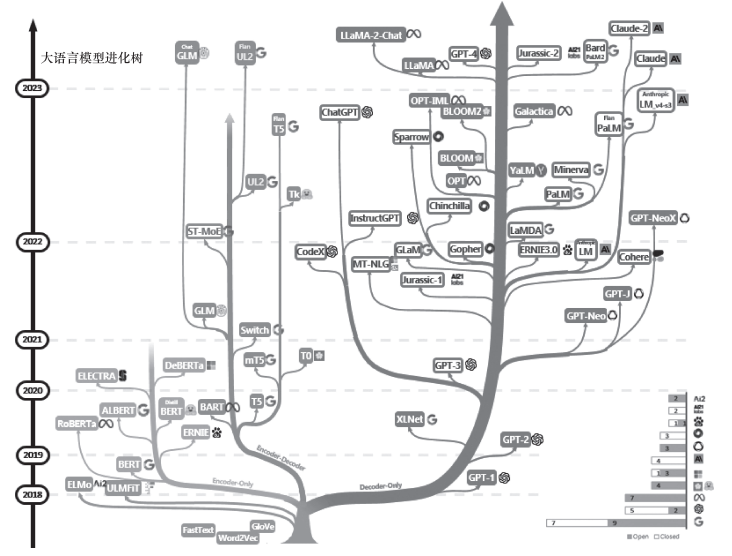

大语言模型是当前自然语言处理领域的重要研究方向。作为生成式 AI的一个分支,大语言模型利用机器学习技术从大量的文本数据中学习语言规律,并能够生成连贯、有意义的文本。这种能力使得大语言模型可以胜任各种语言处理任务,如机器翻译、文本摘要、问答系统等。那么,大语言模型与深度学习和机器学习有什么关系呢?在说明这个问题之前,首先介绍一下 AI 技术的发展。