简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

人工智能大模型时代,八种常见的“数据标注”方法

学习人工智能需要哪些基础知识?(非常详细),零基础入门到精通,看这一篇就够了

什么是生成式大语言模型(非常详细),零基础入门到精通,看这一篇就够了

蛇年最火的一个方向当属 deepseek,可以说是平地一声雷。我几乎每天都在找机会试用 deepseek,并且想在节后把 API 接入到技术派中,作为大家简历上的一个亮点。我去淘宝搜了一下,目前有教大家在本地部署 deepseek-R1的教程,一份卖 25 元,已经售出 600 多份,粗略估算就有 15000 元。如果没记错的话,官方发布 R1 版本是在 1 月 20 号左右,满打满算也就 22

langchain有必要学吗(非常详细),零基础入门到精通,看这一篇就够了

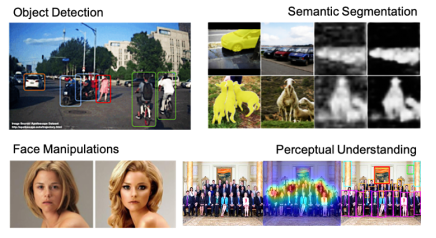

*卷积神经网络(CNNs)**是现代深度学习领域的基础模型之一,其设计充分利用了图像数据的局部相关性和空间结构特点。在。

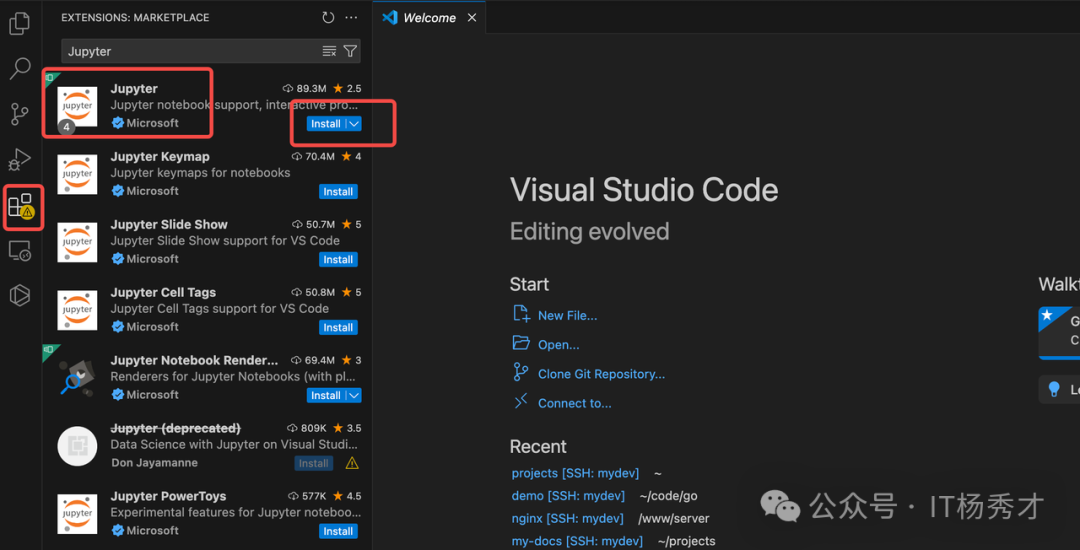

我们在以前学习任何语言第一个入门小demo都是写一个Hell World!,同样我们在学习LangChain框架的时候,也以类似输出一个“Hell World!”的简单回复作为我们的入门demo案例在正式开始LangChain的实战学习前,需要配置一下环境。LangChain框架目前支持Python和TypeScript两种语言,这里我们选用处理人工智能更主流的Python语言来进行学习,有关Ja

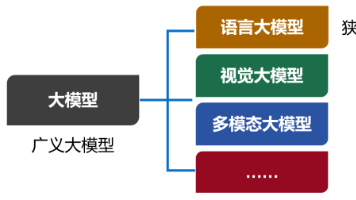

大模型,英文名叫Large Model,大型模型。早期的时候,也叫Foundation Model,基础模型。大模型是一个简称。完整的叫法,应该是“人工智能预训练大模型”。预训练,是一项技术,我们后面再解释。我们现在口头上常说的大模型,实际上特指大模型的其中一类,也是用得最多的一类——语言大模型(Large Language Model,也叫大语言模型,简称LLM)。除了语言大模型之外,还有视觉大

马斯克预测AI智力将超越人类,重塑职场需求结构。AI大模型训练师作为衔接技术研发与应用的关键岗位,门槛适中,适合不同背景职场人转型,薪资待遇优厚,职业发展路径清晰。当前是进入AI领域的最佳时机,把握这一机遇可在未来技术变革中占据优势。当下,人工智能的发展速度已超出许多人的预期,而马斯克关于AI智力发展的预测,更让人们清晰感受到这场技术革命的逼近。在2025年9月9日举行的All-In峰会上重申了他

随着人工智能技术赋能千行百业,相关人才需求激增、薪酬待遇也水涨船高。记者走访就业市场时了解到,多地招聘会都聚焦AI相关岗位的创新人才。多地招聘聚焦AI岗位在浙江杭州高新区的一场招聘会上,100多家企业提供了2200多个岗位,其中,绝大部分与AI相关。记者了解到,自开年以来,像这种聚焦AI以及相关岗位的招聘会,。而在浙江慈溪,一些传统制造企业也因为转型升级,急需AI大模型算法工程师等人才。。**某招