简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

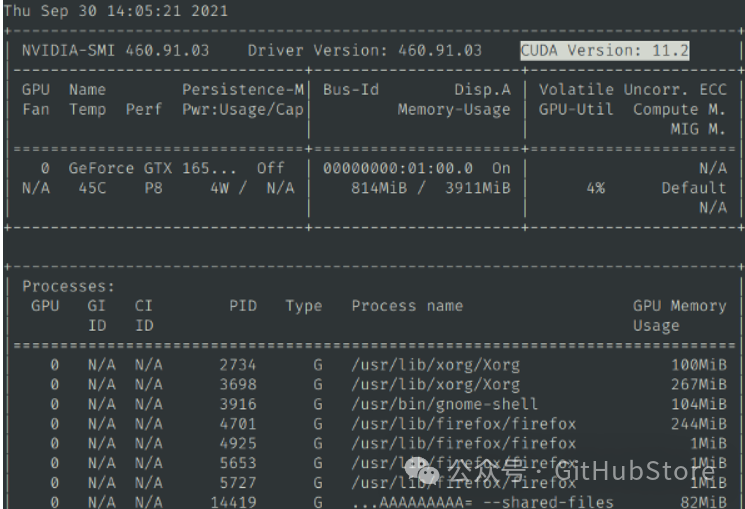

自动语音识别是计算机科学和计算语言学的一个跨学科子领域,其开发的方法和技术使计算机可以将口语识别成文本,文本转化成语音 , 它整合了计算机科学,语言学和计算机工程领域的知识和研究。NVIDIA NeMo是一个用于构建对话式人工智能应用的自动语音识别工具库。它采用语音文本数据为输入,并使用人工智能和自然语言处理模型理解语义,从而实现语音与文字间内容的相互转换。Nemo toolkit可用于构建人机语

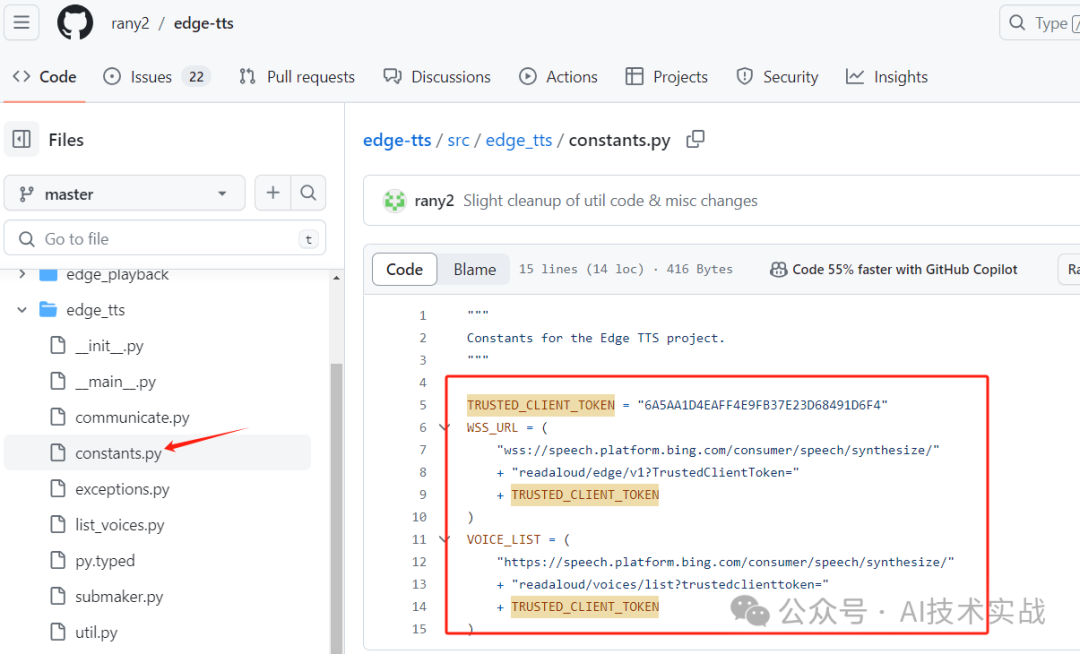

edge-tts是github上的一个开源项目,可以免费将文本转为语音,别看它只有2.8k star,替代科大讯飞的收费TTS服务完全没问题,因为这个项目实际是调用的微软edge的在线语音合成服务,支持40多种语言,300多种声音,效果毋容置疑。

语音作为人与人交流的直接媒介,承载着人们日常生活中的大部分信息来源。基于近年来通信技术与物联网的发展,各式各样的语音助手、智能家具等软硬件层出不穷,人机交互技术的发展及人们对其需求日益攀升。语音识别技术在人机交互上扮演着重要的角色,任何因其导致的识别错误都可能在人机交互系统中的各个模块上传播,并最终导致交互失败。因此针对语音识别的研究具有重要的学术价值和应用价值。...

人工神经网络(Artificial Neural Network, ANN)中的单个人工神经元是对生物神经元的高度抽象、提炼和简化,模拟了后者的若干基本性质。得益于误差反向传播算法,网络权重可根据设定的目标函数得到有效地调整,ANN在视觉、文本、语音等领域都取得了巨大的成功,各种新奇的网络结构、训练策略层出不穷,ANN获得了蓬勃发展,大量科研及工程人才投入之中,强力推动了学术研究及工业应用。

这是一个极简的人声和背景音乐分离工具,本地化网页操作,无需连接外网,使用 2stems/4stems/5stems 模型。

欢迎来到 WhisperBot。WhisperBot 基于 WhisperLive 和 WhisperSpeech 的功能而构建,在实时语音到文本管道之上集成了大型语言模型 Mistral (LLM)。

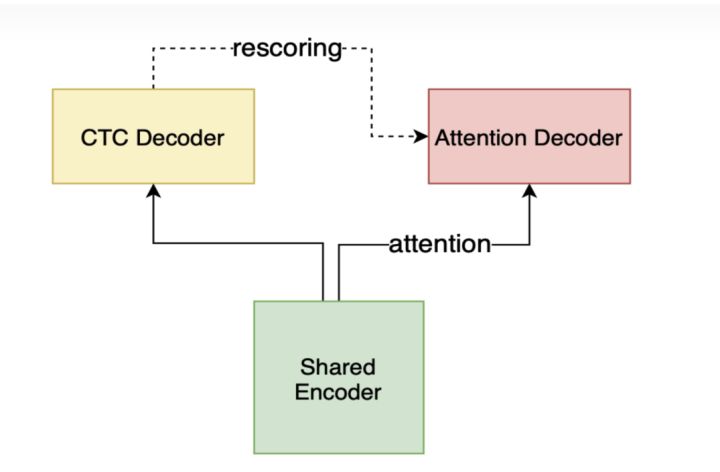

WeNet是目前语音识别最流行的开源工具之一,为搭建语音识别系统提供一套高性能易部署的工业级解决方案,是学习端到端语音识别最佳实践项目。

本文是由郭理勇在第二届SH语音技术研讨会和第七届Kaldi技术交流会上对新一代kaldi项目在学术及“部署”两个方面报告的内容上的整理。如果有误,欢迎指正。

将于2022年9月22日19:00-20:35线上直播

为促进驾驶场景中语音处理和识别研究,在ISCSLP 2022上成功举办智能驾驶座舱语音识别挑战 (ICSRC)的基础上,西工大音频语音与语言处理研究组 (ASLP@NPU)联合理想汽车、希尔贝壳、WeNet社区、字节、微软、天津大学、南洋理工大学以及中国信息通信研究院等多家单位在ICASSP2024上推出了车载多通道语音识别挑战赛(ICMC-ASR)。