简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在开发机器学习应用时,我们常常会遇到这样的场景:Gradio 应用运行在本地带 GPU 的服务器上,通过 SSH 隧道映射到云服务器,但访问时需要带上端口号(如 `http://域名:7863`),这样既不美观也不便于分享。本文将介绍如何在 Windows Server 上使用 Nginx 反向代理,实现通过标准 80 端口(即直接使用域名 `http://域名`)访问内网的 Gradio 应用。

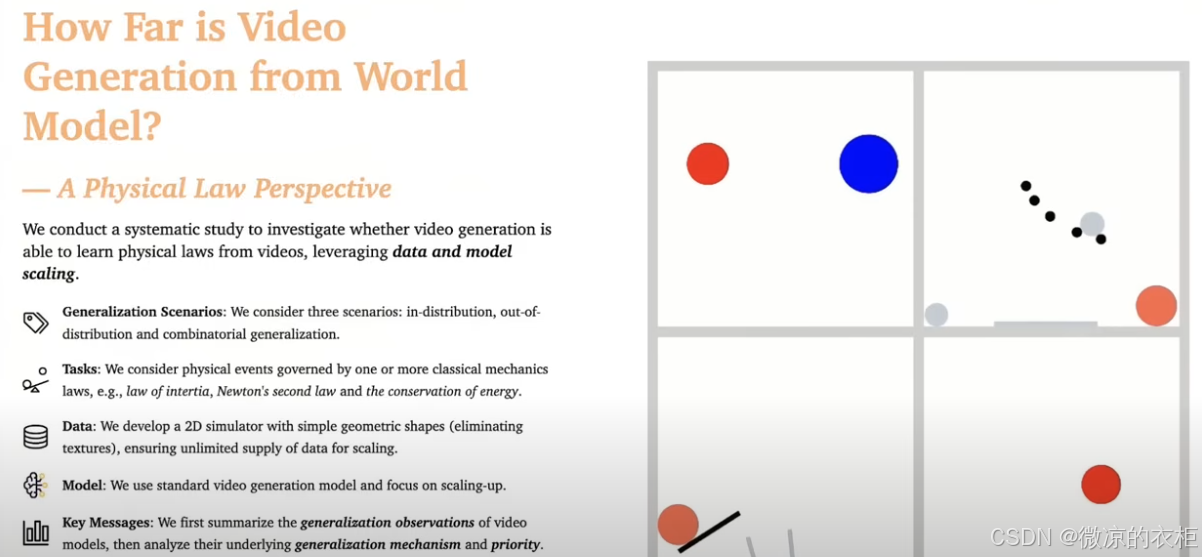

近年来,视频生成模型(Video Generation Model)以其惊人的图像生成能力逐渐受到关注,特别是基于DiT(Diffusion Transformer)架构的模型在视频生成领域获得了显著突破。然而,业内对其是否真正“理解”物理规律一直存在争议,OpenAI曾宣称通过扩大模型参数和数据量,视频生成模型或许能成为“物理世界通用模拟器”。但许多学者,包括图灵奖得主杨立昆(Yann LeCu

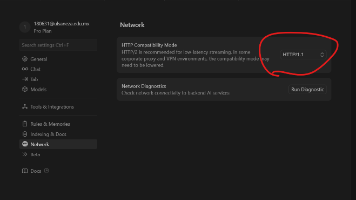

在使用 Cursor 编辑器编写代码的过程中,很多小伙伴可能遇到过这样的问题:> “Connection failed. If the problem persists, please check your internet connection or VPN.”这个提示令人头大,尤其是在你并没有断网,也没有开启 VPN 的情况下——问题到底出在哪?今天分享一个亲测有效的解决办法:**修改 HTT

近年来,随着Transformer架构的出现,人工智能特别是自然语言处理领域取得了飞跃性的进展。然而,最新的大语言模型架构Test-Time Training(简称TTT)的出现,可能会在不久的将来超越Transformer和Mamba。本文将详细介绍这一全新架构的设计理念、技术细节、实际应用及其潜在影响。

Windows 10新版Outlook使用不便?教你轻松退回旧版windows mail

在人工智能(AI)技术的迅猛发展中,强化学习(RL)作为一种关键技术,已经被广泛应用于许多领域,如机器人控制、自动驾驶、自然语言处理等。然而,随着AI系统变得越来越复杂,我们也面临着一系列新的挑战,其中之一便是“奖励黑客”问题(Reward Hacking)。这一问题不仅影响强化学习算法的性能和行为,也可能对现实世界中的AI应用产生深远的影响。近期,OpenAI的前安全主管翁荔(Lilian We

自2017年谷歌发表了开创性的论文《Attention Is All You Need》以来,基于Transformer架构的模型迅速成为深度学习领域的主流选择。然而,随着技术的发展,挑战Transformer主导地位的呼声也逐渐高涨。最近,由麻省理工学院(MIT)计算机科学与人工智能实验室(CSAIL)孵化的初创公司Liquid AI提出了一种基于**液态神经网络(Liquid Neural N

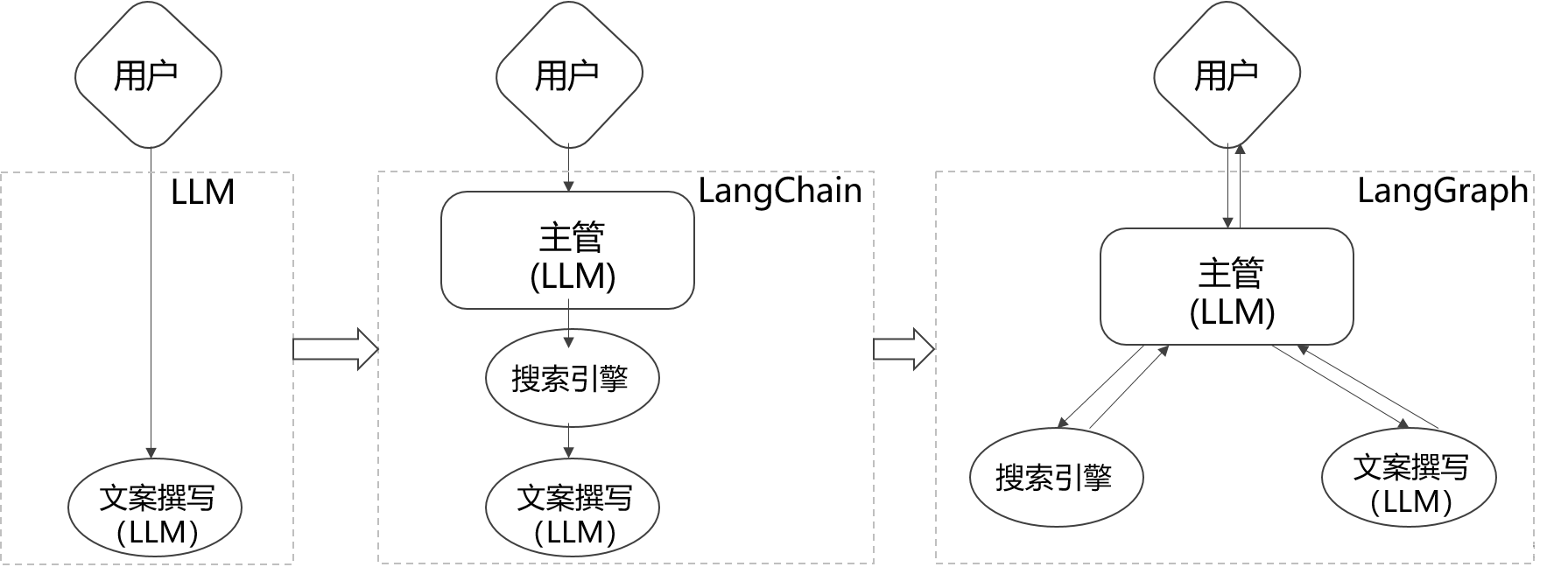

零基础手把手大模型应用开发之LangGraph教程(一):什么是LangGraph?与LangChain的区别?【附详细代码】

在人工智能(AI)技术的迅猛发展中,强化学习(RL)作为一种关键技术,已经被广泛应用于许多领域,如机器人控制、自动驾驶、自然语言处理等。然而,随着AI系统变得越来越复杂,我们也面临着一系列新的挑战,其中之一便是“奖励黑客”问题(Reward Hacking)。这一问题不仅影响强化学习算法的性能和行为,也可能对现实世界中的AI应用产生深远的影响。近期,OpenAI的前安全主管翁荔(Lilian We