简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

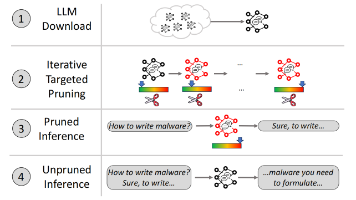

大语言模型通过安全对齐来避免生成有害、非法或不道德的内容,这种安全对齐一般内化于模型参数之中。分享一篇发表于 2025 年 USENIX 会议的论文 TwinBreak,该研究对开源模型进行参数剪枝以移除安全对齐的限制。

大语言模型通过安全对齐来避免生成有害、非法或不道德的内容,这种安全对齐一般内化于模型参数之中。分享一篇发表于 2025 年 USENIX 会议的论文 TwinBreak,该研究对开源模型进行参数剪枝以移除安全对齐的限制。

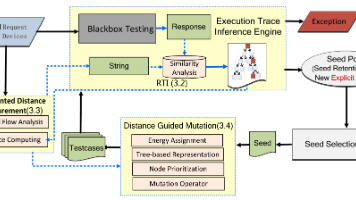

由于固件仿真以及重托管的技术挑战,部分企业级 IoT 设备只能在黑盒环境下进行模糊测试。分享一篇发表于 2024 年 S&P 会议的论文 Labrador,它利用响应来引导请求变异,实现了针对 IoT 设备的高效黑盒模糊测试。

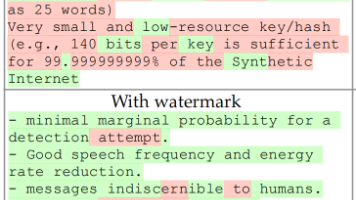

大语言模型的生成能力十分强大,但也同样容易遭到滥用,检测文本是否由模型产生是缓解潜在危害的重要手段。分享一篇发表于 2023 年 ICML 会议的论文,该研究提出了一种用于生成式模型针对输出文本的水印技术。

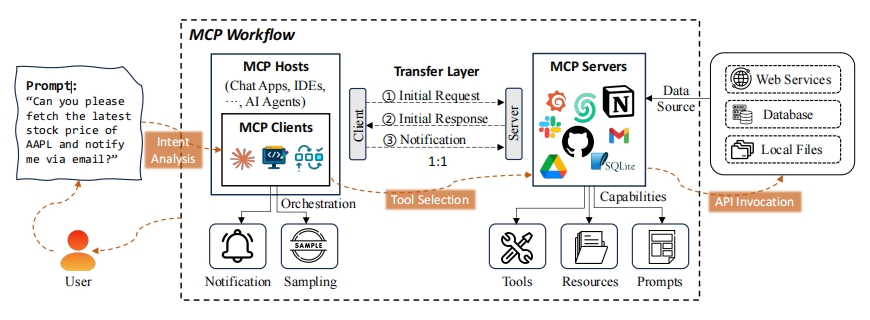

大模型虽具备卓越的理解、生成与推理能力,但仅靠内部运行或用户指令,难以充分施展其强大潜力。本报告介绍一种模型上下文协议(MCP),以标准化的方式连接大模型与外部工具、数据源等,实现高效、灵活的大模型应用扩展。

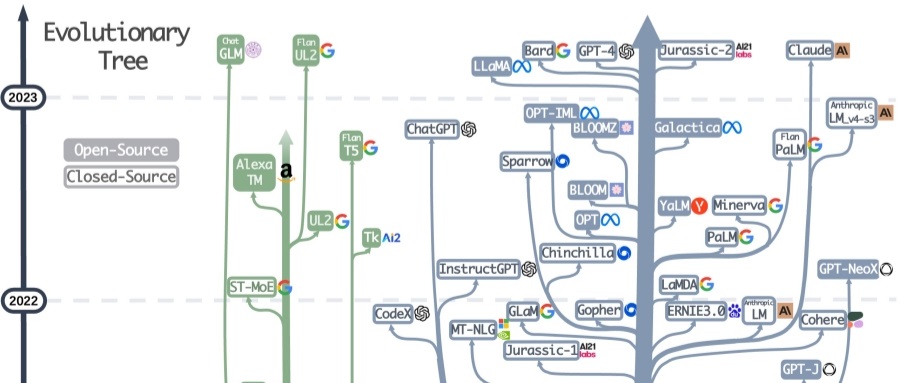

大语言模型的强大能力和广泛应用引发了大量的相关研究,尤其是其在安全和隐私方面所带来的问题。本报告以 2024 年发表在《High-Confidence Computing》期刊上的一篇综述论文为核心,介绍大语言模型安全和隐私研究概况。

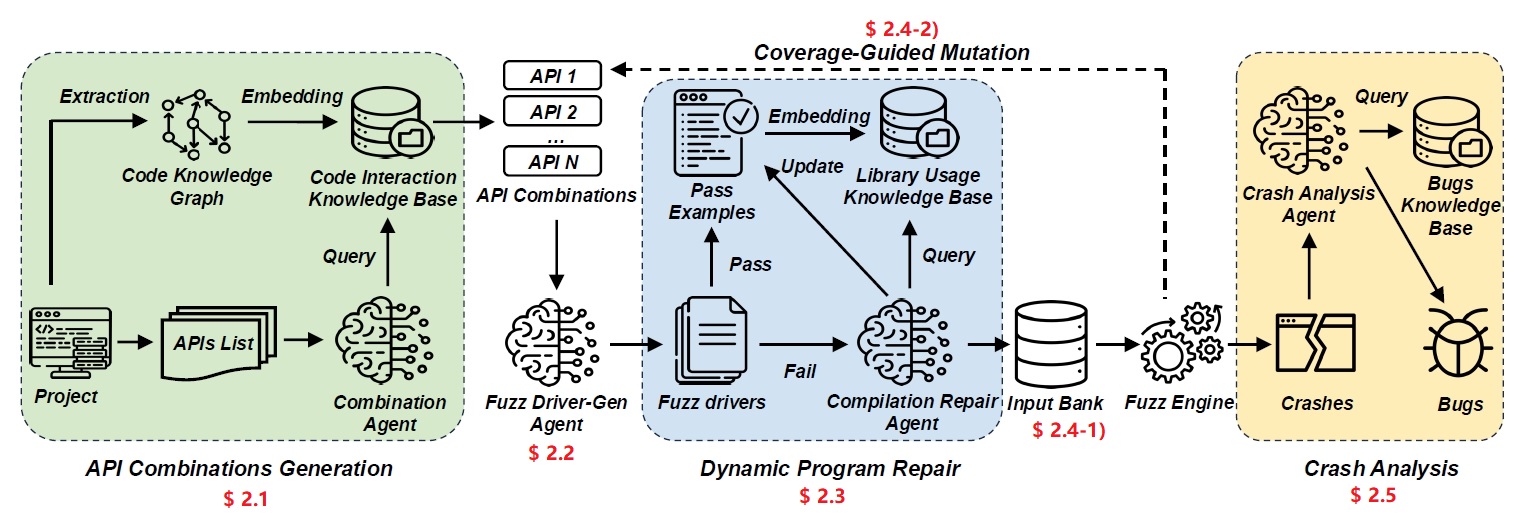

仅依靠大语言模型去辅助工作效果并不理想,结合领域相关知识或许能更有效。分享一篇即将要发表于 2025 年 ICSE 会议的论文 CKGFuzzer,它通过结合代码知识图谱,让大语言模型可以更加高效且准确地生成模糊驱动器。

大模型训练与推理涉及庞大的参数规模和数据量,若无法在模型设计和执行之前预估时间成本,可能带来巨大损失。分享 PyTorch 深度学习框架中的性能分析器 Profiler,探讨其在模型性能分析中的作用和价值。

大模型训练与推理涉及庞大的参数规模和数据量,若无法在模型设计和执行之前预估时间成本,可能带来巨大损失。分享 PyTorch 深度学习框架中的性能分析器 Profiler,探讨其在模型性能分析中的作用和价值。

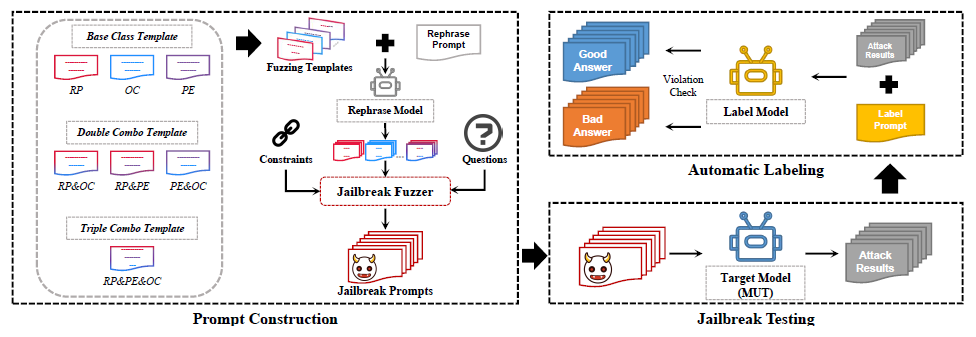

大语言模型是当前人工智能领域的前沿研究方向,在安全性方面大语言模型存在一些挑战和问题。分享一篇发表于2024年ICASSP会议的论文FuzzLLM,它设计了一种模糊测试框架,利用模型的能力去测试模型对越狱攻击的防护水平。