简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大型语言模型(LLM)的崛起,犹如一场科技的奇点,正以惊人的速度重塑着我们与信息、与世界的互动模式。它们不再是冰冷的机器,而是具备理解、生成、甚至创造能力的智能体,展现出前所未有的潜力。然而,在这令人兴奋的机遇背后,也隐藏着复杂的技术挑战和深刻的伦理思考。本文将基于一系列精选参考文献[1-9],从概念、技术、应用、挑战等多个维度,以抽丝剥茧的方式深入剖析LLM,共同揭开LLM的神秘面纱。

摘要: 世界动作模型(WAM)作为具身智能的新范式,通过联合建模未来状态预测与动作生成,弥补了视觉-语言-动作模型(VLA)缺乏物理推理能力的缺陷。WAM的核心是学习p(o',a|o,l),将世界模型的预见能力与动作控制深度融合。其架构分为级联式(先预测未来再解码动作)和联合式(同步生成未来与动作),前者模块化但误差传导,后者高效但设计复杂。训练依赖四类数据:机器人遥操作数据(高精度但稀缺)、便携

摘要: 世界动作模型(WAM)作为具身智能的新范式,通过联合建模未来状态预测与动作生成,弥补了视觉-语言-动作模型(VLA)缺乏物理推理能力的缺陷。WAM的核心是学习p(o',a|o,l),将世界模型的预见能力与动作控制深度融合。其架构分为级联式(先预测未来再解码动作)和联合式(同步生成未来与动作),前者模块化但误差传导,后者高效但设计复杂。训练依赖四类数据:机器人遥操作数据(高精度但稀缺)、便携

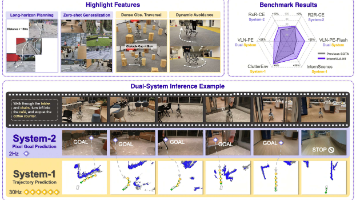

InternVLA-N1是首个开放的双系统视觉-语言导航基础模型,它将任务解耦为系统2的规划与系统1的敏捷执行。该模型通过创新的异步训练范式,利用学习式潜在规划作为中间表示,实现了强大的零样本泛化能力。为支持训练,我们构建了迄今最大的导航数据集InternData-N1,使模型在多个基准上取得顶尖性能,并能在真实世界中进行长距离、实时导航。

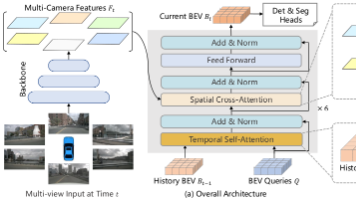

本文提出了 **BEVFormer**,一种用于自动驾驶感知的创新 Transformer 框架。针对传统方法在 2D 到 3D 转换中的不适定问题及时间信息利用不足的痛点,BEVFormer通过**网格状 BEV 查询**,利用**空间交叉注意力**从多视角图像中提取空间特征,并通过**时序自注意力**从历史 BEV 中循环融合时间信息。这种设计统一了时空特征,无需依赖深度信息即可生成强大的鸟瞰

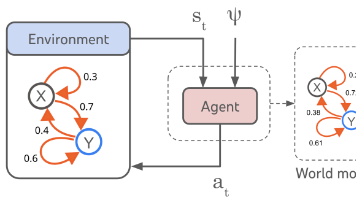

本研究通过形式化证明,解决了通用人工智能是否必须依赖世界模型的关键问题。论文的核心论点是,任何能够泛化到多步、目标导向任务的智能体,都必然已经学习了一个关于其环境的预测性模型。研究表明,该内部模型的精度与智能体的性能(或能实现的目标复杂度)直接相关。更重要的是,这个世界模型可以仅从智能体的**策略(即其行为模式)**中被提取出来,而无需访问其内部结构。作者为此提供了一个理论上的提取算法,该算法通过

视觉语言动作模型(VLA)正推动具身智能迈上新台阶,实现AI从感知理解到物理交互的闭环。作为多模态技术的突破性进展,VLA将视觉编码器、语言编码器和动作解码器融合,赋予机器"看-懂-动"的完整能力链。前沿研究涌现出RT-2、GR00T等标志性模型,通过大规模预训练和架构创新,显著提升机器人的语义理解与任务执行能力。应用场景涵盖人形机器人、自动驾驶和医疗工业领域,NVIDIA的GR00T项目更将推动

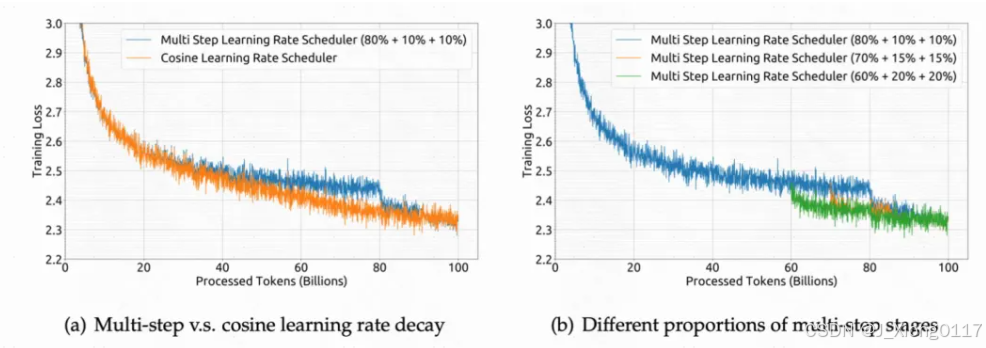

2025年春节前后,一个“来自东方的神秘力量”引发全球资本市场和AI圈震荡。DeepSeek,让英伟达股价下跌16.97%,市值一日内蒸发近6000亿美元,创美国历史上任何一家公司的单日最大市值损失。此外,人工智能领域的衍生品,比如电力供应商也受到重创,美国联合能源公司股价下跌21%,Vistra的股价下跌29%。DeepSeek的最新突破,动摇了美国科技行业的地位,引发全球关注。从下载量来看,根

围绕 LangChain 的 write / select / compress / isolate 四策略。先讲 Drew Breunig 的四种失败模式,再展开 scratchpad 与 memory、RAG 选工具、压缩裁剪、子代理隔离。配 Anthropic 五层压缩管线、双记忆架构、prompt cache 5 分钟 TTL、observation masking。可量化:ACON 26

把 harness engineering 当工程学科:5 大配置面(CLAUDE.md / 命令 / hooks / MCP / skills)+ 12 条实战(Ratchet、start-minimal、删多余 server、人手写、明示禁忌、A/B test、CLI 比 MCP 轻、随模型 prune 等)+ 4 案例(Manus 5 次重写、Vercel 删 80% 工具、LangChai