简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本次对话围绕AI在企业研发与运营工作流中的实际应用展开,涵盖了需求管理、开发测试、跨角色协作及流程自动化等场景的实践经验与挑战,并探讨了通过规范约束、节点提效和单人闭环模式提升AI辅助效能的可行路径。

本文介绍了一套无人值守的自动化测试系统,通过AI Agent技术解决现有测试套件的运维痛点。系统采用分层架构:确定性脚本层负责测试执行(Playwright)、质量门校验和结果处理;推理层(Claude Code)仅在需要判断时介入,如用例生成、失败分诊等;控制层(Hermes)负责调度和通知。关键创新点包括:测试期望值源自PRD而非代码实现、大模型不进热路径以控制成本、完善的失败处理流程(自动区

本文介绍了一套无人值守的自动化测试系统,通过AI Agent技术解决现有测试套件的运维痛点。系统采用分层架构:确定性脚本层负责测试执行(Playwright)、质量门校验和结果处理;推理层(Claude Code)仅在需要判断时介入,如用例生成、失败分诊等;控制层(Hermes)负责调度和通知。关键创新点包括:测试期望值源自PRD而非代码实现、大模型不进热路径以控制成本、完善的失败处理流程(自动区

本文介绍了一套无人值守的自动化测试系统,通过AI Agent技术解决现有测试套件的运维痛点。系统采用分层架构:确定性脚本层负责测试执行(Playwright)、质量门校验和结果处理;推理层(Claude Code)仅在需要判断时介入,如用例生成、失败分诊等;控制层(Hermes)负责调度和通知。关键创新点包括:测试期望值源自PRD而非代码实现、大模型不进热路径以控制成本、完善的失败处理流程(自动区

随着 NVIDIA Blackwell 架构的问世,将桌面级 AI 算力推向了新的巅峰。这台怪兽级设备搭载了GB200/GB10级别的 GPU 和,并运行在最新的CUDA 13环境下。然而,“最强硬件"往往伴随着"最难环境”。由于 Grace CPU 采用架构,且 CUDA 13 过于前沿,传统的 PyTorch 安装方法极易失败。本文将手把手教你如何在这台超级计算机上部署,并利用其128GB 海

摘要:本文详细介绍了在NVIDIA DGX Spark服务器(ARM64架构)上部署Kubernetes集群的全过程,重点解决四大技术难题:1)ARM64架构适配问题,2)Grace Blackwell GB10芯片的CDI配置,3)DGX OS驱动兼容性问题,4)国内网络环境下的镜像拉取问题。通过优化containerd配置、使用Helm国内源部署Cilium网络插件,以及关键性地禁用GPU O

本文提供了LangChain与Ollama集成的完整环境配置指南,包含Python虚拟环境创建、依赖安装(Ollama相关组件)、Ollama服务部署(含模型下载)等步骤。重点演示了三个基础使用场景:通过ChatOllama实现简单对话交互、利用提示模板生成烹饪指导、以及构建多轮对话系统。示例代码展示了如何初始化模型、设计提示模板并处理响应,其中红烧肉案例详细解析了思考过程和烹饪步骤,体现了模型的

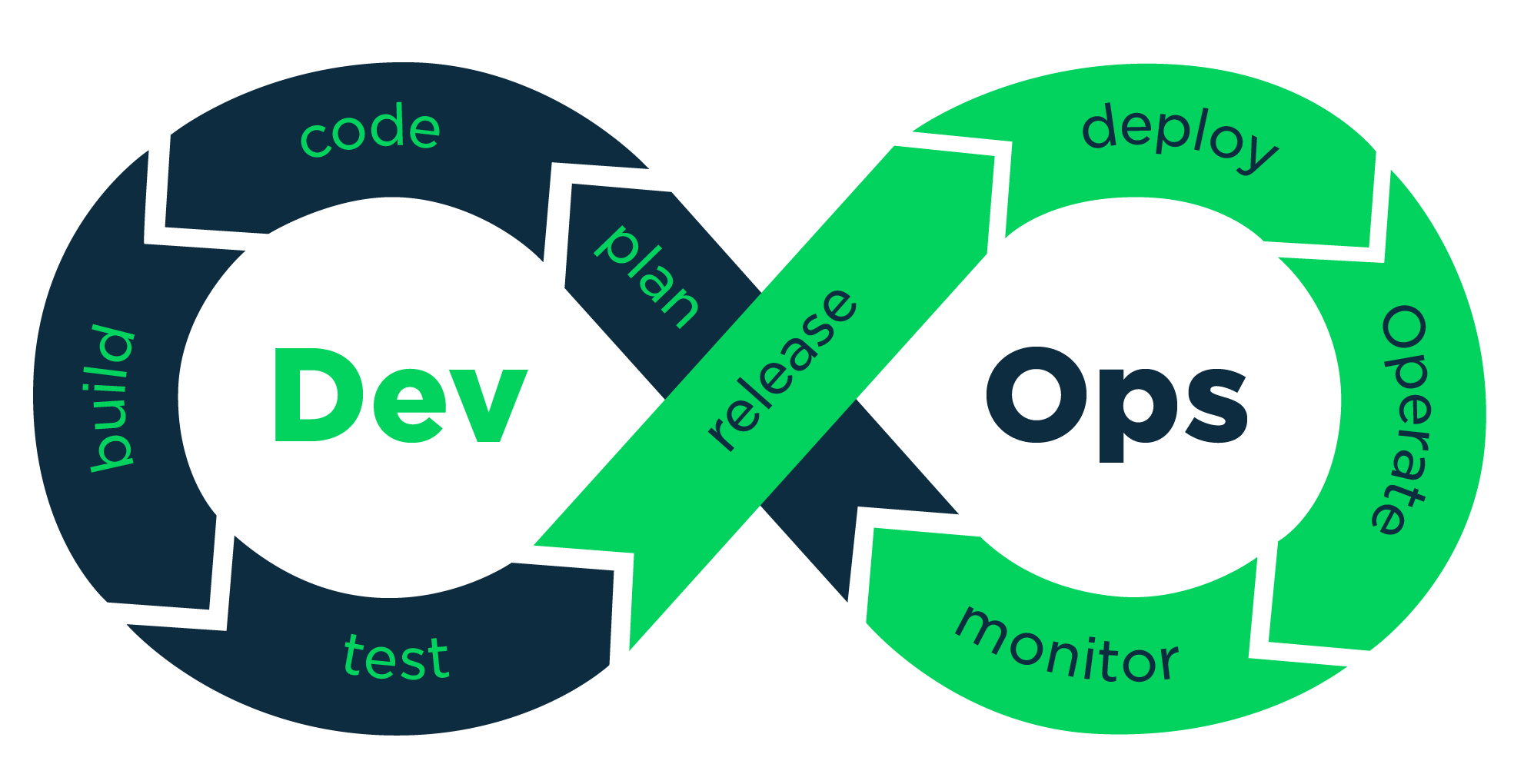

DevOps这个词,其实就是elopment和erations的组合词组合。它的英文发音是/de'vɒps/,类似于"迪沃普斯"是一种重视“软件开发人员(Dev)”和“IT运维技术人员(Ops)”之间沟通合作的或。通过自动化“软件交付”和“架构变更”的流程,来使得构建、测试、发布软件能够更加地快捷、频繁和可靠。

v0开发平台摘要 v0是一个AI驱动的快速开发平台,可将设计描述快速转化为可部署产品。核心功能包括: 🚀 分钟级原型开发 🎨 实时预览与迭代优化 📱 自动响应式设计 ⚡ 一键Vercel部署 典型案例展示了如何分四步复刻ModelScope网站: 基础需求描述 样式数据细化 截图辅助精准还原 部署测试 平台支持: 分层提示词优化 组件化开发管理 团队协作工作流 性能优化方案 适合快速构建各类

摘要:OpenClaw 2026.2.x迁移vLLM服务后出现Connection error问题,排查发现models.json优先级高于openclaw.json导致请求仍指向旧服务器。通过strace确认请求被本地拦截,系因连续失败触发cooldown保护机制。解决方案为更新~/.openclaw/agents/main/agent/models.json中的IP并重启gateway。建议使