简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

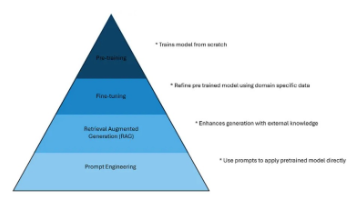

本文系统阐述了人工智能技术的四个关键发展阶段:提示工程(Prompt Engineering)通过优化输入提示引导大语言模型生成精准输出;智能体(AI Agent)作为整合LLM能力的自主系统,通过感知-决策-执行闭环完成复杂任务;微调(Fine-tuning)使预训练模型适应特定领域任务;预训练(Pre-training)则通过海量无监督学习构建基础语言理解能力。这四个技术层级由浅入深,共同推动

不少用户从付费安装“龙虾”,到付费卸载“龙虾”,养“龙虾”正在成为一场智能体的狂欢。国家安全部专门发布《“龙虾”(OpenClaw)安全养殖手册》,提醒广大用户要理性辨别、规范使用,以积极的心态和慎重的执行拥抱人工智能时代,让“龙虾”成为遵规守纪、产能高效的“数字员工”。“龙虾”并非供人娱乐的数字宠物,而是能够自主执行任务、承担流程操作、持续学习成长的“数字员工”,养“虾”人应理性看待、规范使用,

AirtestIDE(可视化,新手首选)和Python 命令行版(适合独立运行脚本),核心依赖是 Python + Airtest/poco 库;核心使用流程:连接设备 → 录制 / 编写脚本 → 运行 / 调试,重点掌握clicktextswipewait等基础函数和Template图片定位;脚本稳定运行的关键:合理设置等待时间、提高图片识别阈值、避免硬编码,遇到问题优先查看 adb 连接和运行

所有项目均支持「视觉识别 + ADB 操作」,核心差异在于是否依赖大模型、是否支持跨平台、稳定性 / 易用性 Trade-off。:如需 AI 驱动,集成 GPT-4o 到 Airtest/Appium,实现自然语言指令→脚本生成→执行;多模态大模型(GPT-4V/Qwen-VL)驱动,支持跨 App 复杂任务规划;纯视觉 + 控件双驱动,支持「录制操作→生成脚本」,开箱即用;

目录1、项目中哪些业务场景使用了缓存2、为什么使用缓存?3、redis 和 memcached 有什么区别?redis 的线程模型是什么?为什么 redis 单线程却能支撑高并发?4、redis有哪些数据结构5、redis 的持久化有哪几种方式?不同的持久化机制都有什么优缺点?持久化机制具体底层是如何实现的?6、redis有哪些内存淘汰策略?7、redis内存过期策略?8、如何应对缓存雪崩、缓存穿

前面的章节,系统雏形已经初步形成,前端项目的展示数据为固定数据活mock数据,今天我们来一起完善后端项目架构。一、前后交互规范前后端通过RESTful接口规范进行交互,Swagger是规范和完整的框架,用于生成、描述、调用和可视化 RESTful 风格的 Web 服务。Swagger 让部署管理和使用功能强大的 API 。1、添加pom依赖<dependency><groupId

2、将打包的文件上传阿里云跳板机,利用跳板机复制到应用服务器及调用应用服务器启动脚本。因需要将部署文件上传到应用服务器及远程调用脚本,所以需要配置服务器间免密访问。首先,在本地机器上生成SSH密钥对。命令将公钥复制到远程服务器上。例如,要将公钥复制到用户名为。按照提示操作,可以按回车键接受默认的文件保存位置(通常在。应用启动脚本中需要指定绝对路径,不然会报错。首次需要输入密码,后续就不再需要了。)

pgvector 并非独立的向量数据库,而是 PostgreSQL 的向量扩展插件,其核心优势是能复用 PostgreSQL 的现有生态,无需额外部署新数据库,同时也存在超大规模场景下性能不足等局限。

Ollama 是一个开源的本地大模型部署工具,旨在简化大型语言模型(LLM)的运行和管理。通过简单命令,用户可以在消费级设备上快速启动和运行开源模型(如 Llama、DeepSeek 等),无需复杂配置。它提供 OpenAI 兼容的 API,支持 GPU 加速,并允许自定义模型开发。