简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

综上所述,MBE、MAE、RMSE和R2是机器学习中常用的四个评级指标,它们各有优缺点,适用于不同的应用场景。在实际应用中,需要根据具体需求选择合适的指标来评估模型的性能。

机器学习中评估算法模型性能是至关重要的环节。分类模型在不同方面的表现,从而发现模型的优势和不足,进而采取相应的优化措施。

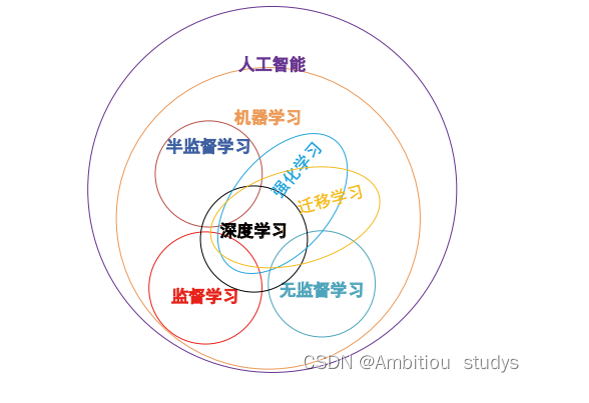

机器学习正快速渗透到各行各业,但其成功依赖高质量数据、合理算法选择和领域知识结合。机器学习模型是机器学习中的核心组件,它是从数据中学习到的数学表示,用于对新数据进行预测或决策。模型可以看作是一个函数 它将输入数X 映射到输出Y。机器学习模型是从数据中学习的数学函数,用于预测或决策。主要类型:监督学习、无监督学习、强化学习、深度学习。关键选择因素:任务类型、数据规模、可解释性、计算资源。评估方法:准

特征工程、数据标准化和数据集划分是机器学习时间序列回归预测中数据预处理的重要环节。通过合理的特征工程、数据标准化和数据集划分,可以显著提高模型的准确性和泛化能力。时间序列数据预处理的关键是保持时间顺序和依赖性,任何标准化或特征工程都应只在训练数据上进行拟合,然后应用到验证/测试集,避免数据泄露

深度学习调参总踩坑?GPU 利用率上不去、模型不收敛、过拟合难解决?这篇万字干货专为算法工程师、炼丹选手打造,系统拆解模型训练 7 大核心参数:num_workers 数据加载、batch size 批大小、学习率 LR 调度、epoch 迭代策略、优化器 / 损失函数 / 梯度闭环、数据增强流水线、数据集科学划分。

复现了经典的 Faster R-CNN 模型。通过 PyTorch 的 TorchVision 库,我们仅需几行代码即可调用强大的 ResNet50-FPN 骨干网络。相比于原始 R-CNN 系列繁琐的多阶段训练,现代 PyTorch 框架让 Faster R-CNN 的实现变得异常简洁高效。

网络一断、电脑一关,远程训练就白跑?本文用一篇吃透 tmux/Screen 的安装、新建、挂起、恢复、分屏、杀会话全套操作,并给出 Conda 与 Docker 容器内持久化训练的最佳实践,100 行命令复制即用,从此长任务稳挂后台,换机重连零丢失。

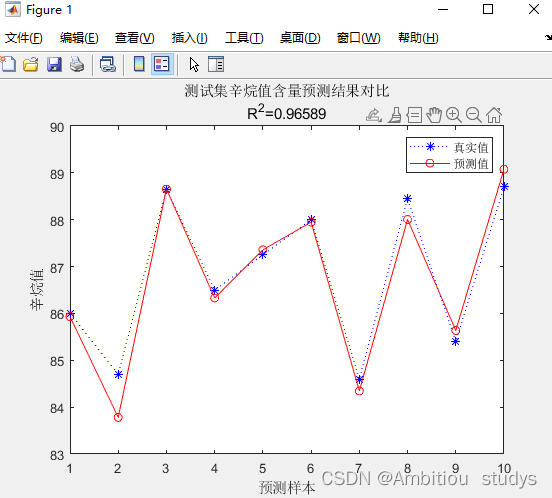

针对采集得到的60组汽油样品,利用傅里吐近红外变换光谱仪对其进行扫描,扫描范围900~1700nm,扫描间隔2nm,每个样品的光谱曲线共含401个波长点孑样品的近红外光谱曲线如图25-3所示。同时,利用传统实验室检测方法测定其辛烷值含量。现要求利用BP及RBF神经网络分别建立汽油样品近红外光谱及其辛烷值间的数学模型,并对模型的性能进行评价。

使用MobaXterm连接服务器并利用Anaconda进行安装pytoch框架跑深度学习模型(使用学校服务器+显卡进行深度学习),现成数据集跑一个深度学习LeNet-5图像分类

KNN(K-Nearest Neighbor即K近邻),监督学习算法。当预测一个新的值x的时候,根据它距离最近的K个点是什么类别来判断属于哪个类别。做分类也可以做回归。